RNN(循环神经网络)和LSTM(长短时记忆网络)都是处理序列数据(如时间序列或文本)的神经网络类型,但它们在结构和功能上有一些关键区别:

1. 基本结构:

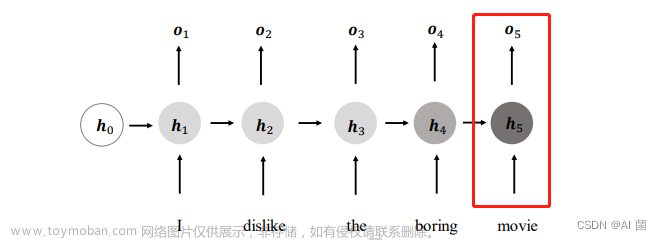

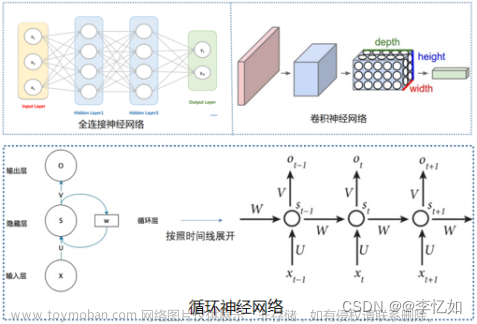

RNN: RNN的核心是一个循环单元,它在序列的每个时间步上执行相同的任务,同时保留一些关于之前步骤的信息。RNN的这个结构使其理论上能够处理任意长度的序列。

LSTM: LSTM是RNN的一个变种,它包含特殊的结构称为“门”(Gates)。这些门(遗忘门、输入门和输出门)帮助网络决定信息的添加或移除,这使得LSTM能够更有效地学习长期依赖性。

2. 解决长期依赖问题:

RNN: RNN在处理长序列时面临“梯度消失”或“梯度爆炸”的问题,这使得它难以学习和保持长期的依赖关系。

LSTM: LSTM通过其门控机制可以较好地解决长期依赖问题。遗忘门帮助网络遗忘不相关的信息,而输入和输出门帮助网络保持有用的长期依赖。

3. 复杂性和计算成本:

RNN: RNN的结构比LSTM简单,因此计算成本通常较低。但这种简单性也限制了它处理复杂问题的能力。

LSTM: LSTM的结构更复杂,需要更多的计算资源。但这种复杂性提供了更好的性能,特别是在处理需要理解长期依赖的任务时。

4. 应用场景:

RNN: 对于一些不需要长期记忆的简单序列处理任务,标准的RNN可能足够有效。

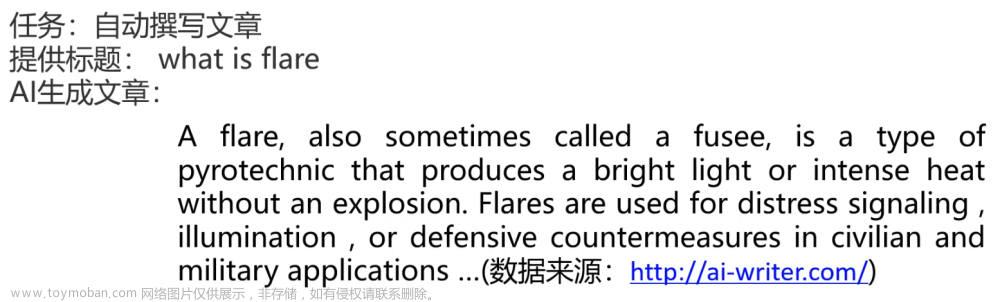

LSTM: 对于需要处理复杂模式和长期依赖的任务(如机器翻译、语音识别等),LSTM通常是更好的选择。文章来源:https://www.toymoban.com/news/detail-811365.html

总的来说,LSTM在很多方面是对标准RNN的一个改进,特别是在处理长期依赖性方面。但这种改进是以增加计算复杂性为代价的。文章来源地址https://www.toymoban.com/news/detail-811365.html

到了这里,关于RNN和LSTM的区别是什么?的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!