unsetunset前言unsetunset

看见老扎说Meta要弄llama3了,用35w张H100来搞,然后开源。

因为工作中一直用OpenAI,所以没弄过llama2,想着试一下llama2跑本地的效果,llama2官方下载地址:https://ai.meta.com/llama/

官方是需要填表的,我们直接使用社区的方案,不需要填任何东西,直接下载。

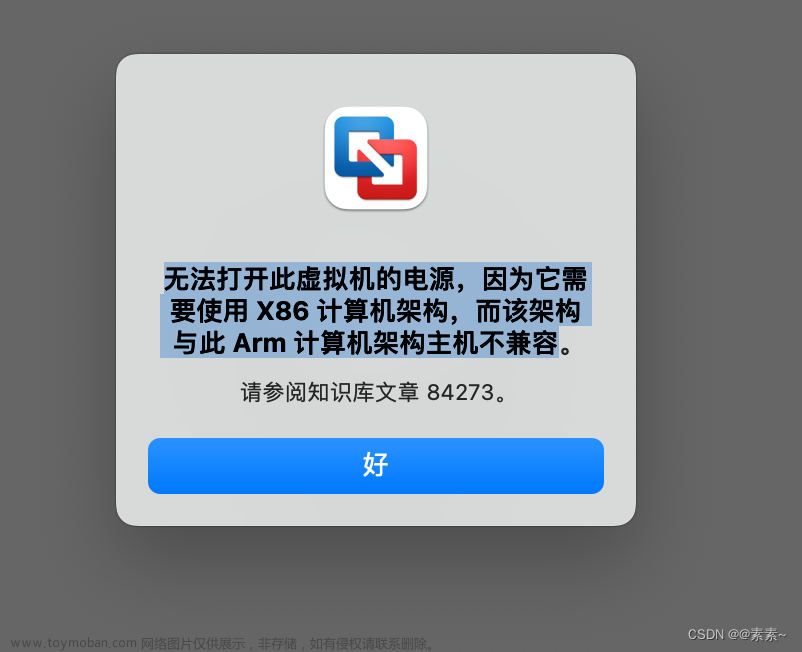

对了,我的环境是MacOS M2,windows或Linux请找其他文章了解。

unsetunset安装环境unsetunset

首先,弄一下环境,创建一个Python 3.10.9的python虚拟环境,建议使用跟我一样的python环境,如果是python 3.11,安装环境的方式会有问题。

在python 3.10.9虚拟环境中安装一下llm库:

pip install llm然后使用llm安装llm-llama-cpp和llama-cpp-python就好了,llm库帮我们处理好所有的细节。

llm install llm-llama-cpp

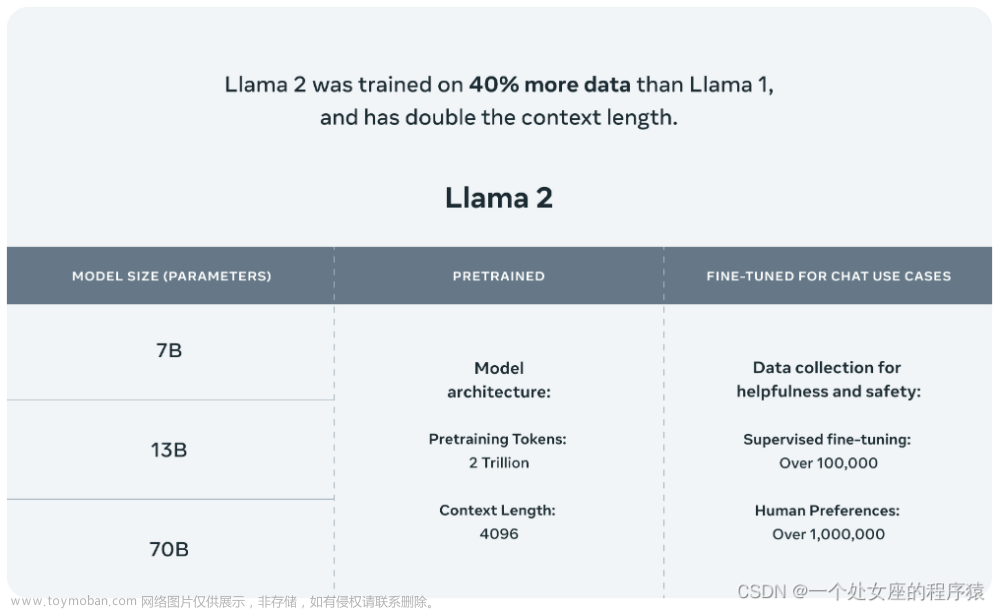

llm install llama-cpp-python使用llm下载llama-2-7b-chat模型,这个模型只有7b的参数,还有13b等更大的模型。

llm llama-cpp download-model \

https://huggingface.co/TheBloke/Llama-2-7B-Chat-GGML/resolve/main/llama-2-7b-chat.ggmlv3.q8_0.bin \

--alias llama2-chat --alias l2c --llama2-chat因为我们这里下载的是ggmlv3,是旧的model format,新的modle format已经改成了gguf,为了使用ggmlv3,我们需要安装旧版本的llama-cpp-python。(https://stackoverflow.com/questions/76986412/assertionerror-when-using-llama-cpp-python-in-google-colab)

pip install llama-cpp-python==0.1.78unsetunset使用unsetunset

命令行方式使用:

llm -m l2c '你好,使用python写一段生成斐波那契数列的代码'

python代码里使用.

结论:测了一些我这边工作上的业务问题,效果一般,可能升到更多参数的模型效果会好一些。文章来源:https://www.toymoban.com/news/detail-816527.html

如果效果差不多,我其实是偏向于使用llama的,比较本地llama不需要考虑openai api的ratelimit(当然你可以用Azure的gpt api来缓解)。文章来源地址https://www.toymoban.com/news/detail-816527.html

到了这里,关于MacOS M2使用llama2的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[NLP]LLM--使用LLama2进行离线推理](https://imgs.yssmx.com/Uploads/2024/02/701865-1.png)