IDCNN(迭代扩张卷积神经网络)在NLP-NER任务中的应用

IDCNN(Iterated Dilated Convolutional Neural Network)是一种特别设计的卷积神经网络(CNN),用于处理自然语言处理(NLP)中的序列标注问题,例如命名实体识别(NER)。IDCNN的关键特点是使用了扩张卷积(Dilated Convolution),这是一种可以增加感受野(即网络可以观察到的输入序列的部分)而不增加参数数量的卷积类型。

主要特点:

-

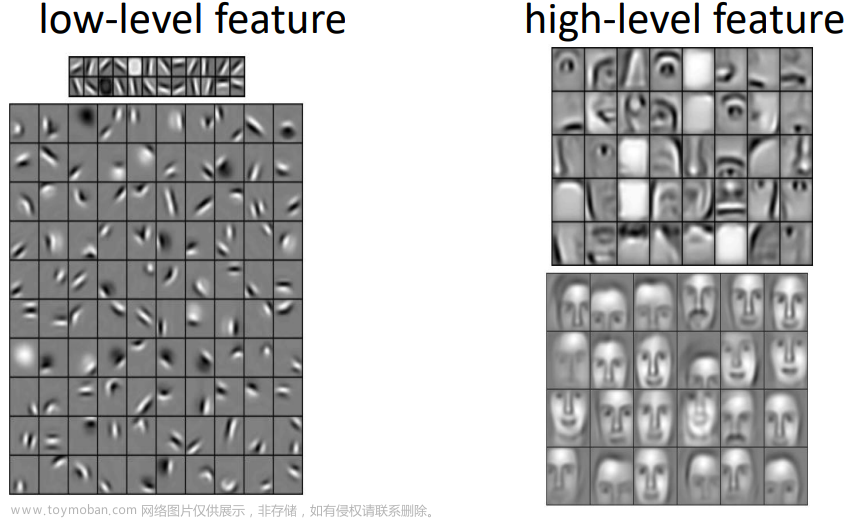

扩张卷积:IDCNN通过扩张卷积来增加每层的感受野。在扩张卷积中,卷积核的元素之间会间隔一定数量的点,这样就能覆盖更长的输入序列,而不增加卷积核的大小或参数的数量。

-

迭代结构:IDCNN通过重复使用同一组卷积层来进一步增加感受野。这种迭代结构意味着网络可以在保持较小模型尺寸的同时,捕捉到长距离的依赖关系。

与其他模型的关系和区别

-

与BERT的关系和区别:

- BERT(Bidirectional Encoder Representations from Transformers)是基于Transformer的模型,主要通过自注意力机制来捕捉长距离依赖关系。BERT在预训练阶段就学习了大量的语言知识,适合于各种下游NLP任务。

- IDCNN则通过卷积结构来捕捉这些依赖关系,通常需要更少的资源进行训练,但可能不如BERT那样能够有效地处理非常复杂的语言结构。

-

与BiLSTM/BiGRU的关系和区别:

- BiLSTM(双向长短时记忆网络) 和 BiGRU(双向门控循环单元) 都是循环神经网络(RNN)的变体,主要用于处理序列数据,尤其擅长捕获序列中的时间依赖关系。

- 相比之下,IDCNN侧重于通过卷积层来捕获局部依赖关系,并通过扩张卷积来扩大其感受野。IDCNN在处理长序列时通常比标准的RNN更加高效,但可能不如RNN变体那样擅长捕获复杂的时间依赖关系。

-

与CRF的关系:

- CRF(条件随机场) 是一种常用于序列标注任务的模型,它在模型的最后一层用于优化标签序列,使整个标注序列更加合理。

- IDCNN可以与CRF结合使用,其中IDCNN用于提取特征,CRF用于序列标注。这种组合可以结合IDCNN在特征提取方面的效率和CRF在序列标注上的准确性。

总体来说,IDCNN在NLP-NER任务中提供了一种相对高效的方法来处理长距离的依赖关系,尤其适用于资源有限的情况。文章来源:https://www.toymoban.com/news/detail-818130.html

然而,在处理非常复杂的语言结构时,它可能不如基于Transformer的模型(如BERT)或RNN变体(如BiLSTM/BiGRU)那样有效。文章来源地址https://www.toymoban.com/news/detail-818130.html

到了这里,关于IDCNN(迭代扩张卷积神经网络)在NLP-NER任务中的应用的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!