在中文自然语言处理(NLP)中的命名实体识别(NER)任务中,加入注意力(attention)机制可以极大地提升模型的性能。注意力机制可以帮助模型更好地捕捉序列中的关键信息和上下文依赖关系,从而提高对命名实体的识别准确度。下面是一些关于注意力机制的具体作用和不同类型的概述:

-

注意力机制的作用:

- 捕捉长距离依赖:注意力机制可以帮助模型更好地处理长距离的依赖关系,这在处理长句子时尤为重要。

- 关注关键信息:通过分配不同的权重,模型可以更加关注与当前任务更相关的词汇或句子部分。

- 动态上下文表示:不同于传统的静态表示,注意力机制允许模型根据当前处理的内容动态调整上下文表示。

-

注意力机制的类型:

- 自注意力(Self-Attention)/ 内部注意力:每个序列元素都会对序列中的所有元素(包括自己)进行注意力计算,这在Transformer模型中得到了广泛应用。

- 外部注意力(External Attention):将序列元素与外部记忆或信息进行关联,例如利用知识图谱增强语义理解。

- 多头注意力(Multi-Head Attention):将注意力分割成多个头,每个头关注序列的不同部分,这样可以让模型同时从多个角度学习序列。

-

注意力机制的加入位置:

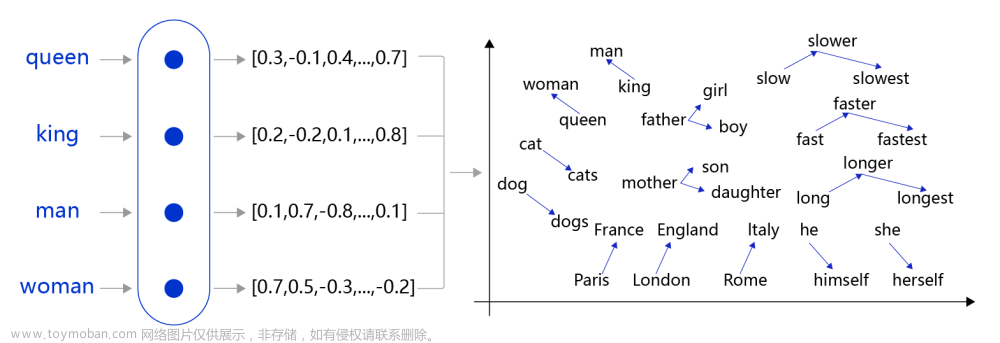

- 在嵌入层(Embedding Layer)之后:用于增强对输入序列的理解。

- 在循环神经网络(RNN)层之后:用于捕捉长距离依赖,提升序列建模能力。

- 在解码器(Decoder)中:如果模型包含解码器,注意力机制可以帮助更好地结合上下文信息。

在实际应用中,选择哪种类型的注意力机制以及在模型中的具体位置取决于具体任务的需求和数据特性。例如,在处理非常长的文本时,自注意力机制可能更加有效;而在需要理解上下文信息时,在循环神经网络层后加入注意力可能更合适。文章来源:https://www.toymoban.com/news/detail-822153.html

总之,通过实验和调整来确定最适合特定任务的配置是非常重要的。文章来源地址https://www.toymoban.com/news/detail-822153.html

到了这里,关于中文自然语言处理(NLP)中的命名实体识别(NER)任务中,加入注意力(attention)机制的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!