一、引言

在之前的博客中,我们成功构建了一个基于LibriSpeech数据集的英文语音识别系统。现在,我们将对系统进行扩展,增加一些增强功能,并尝试支持多语言识别。

二、增加增强功能

| 语音合成 | |

| --除了语音识别,我们还可以增加语音合成(Text-to-Speech, TTS)功能,将文本转换为语音输出。这可以使得我们的系统不仅仅是一个转录工具,还能够进行语音交互。 | |

| 情感分析 | |

| --通过结合情感分析模型,我们可以识别出语音中的情感倾向,如喜悦、悲伤、愤怒等。这可以帮助我们更好地理解用户的情绪和意图。 |

三、多语言支持

-

为了使我们的系统支持多语言识别,我们需要准备不同语言的训练数据集,并调整模型以适应不同语言的特性。

- 数据准备

对于每种语言,我们需要收集相应的语音数据集,并进行标注和预处理。这些数据集可以来自开源项目,如Common Voice,或者我们自己收集的数据。

- 模型调整

- 针对不同语言的音频数据,我们可能需要调整模型的输入维度、网络结构或超参数。

- 此外,我们还可以考虑使用多语言共享的预训练模型,如:

Multilingual Speech Recognition(MSR)模型。

四、代码实现

-

以下是一个简化的示例代码,展示了如何扩展我们的语音识别系统以支持多语言。

import tensorflow as tf

from tensorflow.keras.models import load_model

from tensorflow.keras.preprocessing.sequence import pad_sequences

# 加载预训练的语音识别模型

model = load_model('librispeech_model.h5')

# 定义多语言支持的函数

def recognize_speech_multilingual(audio_data, language):

# 根据语言选择相应的模型和参数

if language == 'english':

model = load_model('english_model.h5')

input_shape = (mel_specs_english.shape[1], mel_specs_english.shape[2])

texts = texts_english

elif language == 'spanish':

model = load_model('spanish_model.h5')

input_shape = (mel_specs_spanish.shape[1], mel_specs_spanish.shape[2])

texts = texts_spanish

# ... 添加其他语言的支持

else:

raise ValueError("Unsupported language: {}".format(language))

# 预处理音频数据

mel_specs = preprocess_audio(audio_data)

# 对输入进行填充以匹配模型输入维度

mel_specs = pad_sequences(mel_specs, dtype='float32', padding='post', maxlen=input_shape[0])

# 进行语音识别

predictions = model.predict(mel_specs)

# 将预测结果转换为文本

recognized_text = decode_predictions(predictions, texts)

return recognized_text

# 示例用法

audio_data = load_audio_data('example_audio.wav')

recognized_text = recognize_speech_multilingual(audio_data, 'english')

print("Recognized text:", recognized_text) 在上面的代码中,我们定义了一个recognize_speech_multilingual函数,它接受音频数据和语言作为输入,并返回识别出的文本。根据输入的语言,我们加载相应的模型和参数,并进行音频数据的预处理和识别。最后,我们将预测结果解码为文本并返回。

6个最佳开源语音识别引擎

Athena 源码地址: --点击进入

- Athena用途广泛,从转录服务到语音合成。

- 它不依赖于Kaldi,因为它有自己的Python特征提取器。

ESPnet 源码地址: --点击进入

- 它可以实时处理音频,使其适合现场语音转录。

- 它是提供各种语音处理任务的最通用工具之一。

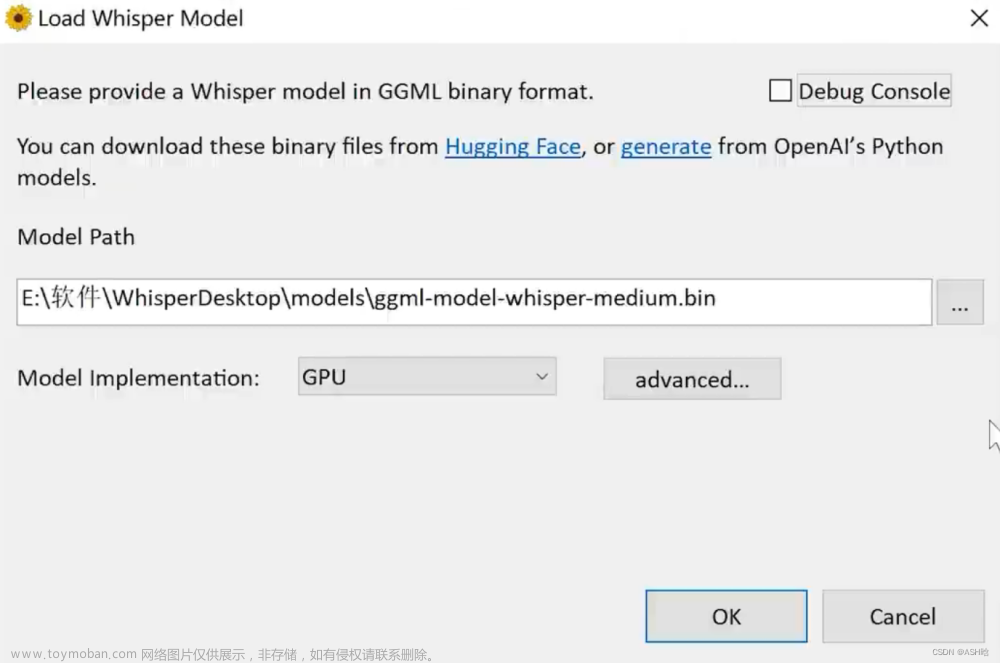

Whisperyua 源码地址:--点击进入 --官网

- Whisper是Open AI的创意工具,提供了转录和翻译服务。

- 它支持的内容格式,如MP3,MP4,M4A,Mpeg,MPGA,WEBM和WAV。

- 它可以转录99种语言,并将它们全部翻译成英语。

- 该工具是

免费使用的。

Tensorflow ASR 源码地址:--点击进入

- 在处理语音转文本时,语言模型具备较高准确性和效率。

- 可以将模型转换为TFlite格式,使其轻量且易于部署。

Vosk 源码地址:--点击进入 --官网

- 响应迅速,支持各种编程语言开发,如Java、Python、C++、Kotlyn和Shell等等。

- 它有各种各样的用例,从传输到开发聊天机器人和虚拟助手。

文章来源:https://www.toymoban.com/news/detail-825565.html

Kaldi 源码地址: --点击进入文章来源地址https://www.toymoban.com/news/detail-825565.html

- Kaldi非常可靠。它的代码经过彻底验证。

- 虽然它的重点不是深度学习,但它有一些模型可以实现转录服务。

- 它非常适合学术和行业相关的研究,允许用户测试他们的模型和技术。

- 它有一个活跃的论坛,提供适量的支持。

到了这里,关于扩展语音识别系统:增强功能与多语言支持的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!