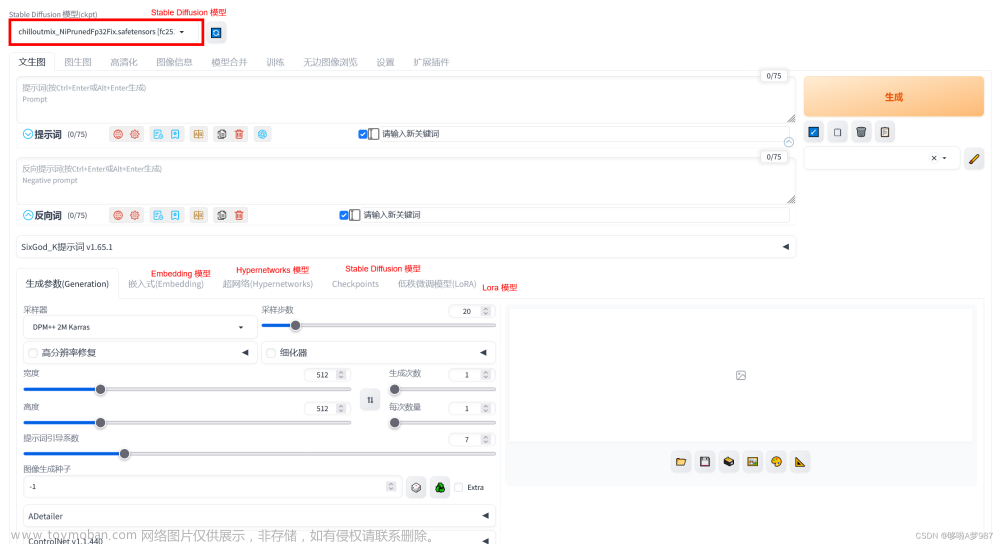

下载好相关模型文件后,直接放入Stable Diffusion相关目录即可使用,Stable Diffusion 模型就是我们日常所说的大模型,下载后放入**\webui\models\Stable-diffusion**目录,界面上就会展示相应的模型选项,如下图所示。作者用夸克网盘分享了「大模型」

链接:https://pan.quark.cn/s/bd3491e51998

提取码:f5c2

chilloutmix_NiPrunedFp32Fix.safetensors 亚太真人风格

majicmixRealistic_v7.safetensors 麦橘写实风格模型

Stable Diffusion 模型:

类型:生成模型,用于从随机噪声中生成逼真的图像。

功能:主要用于生成高质量的图像,可应用于艺术创作、图像编辑、视觉效果等领域。

结构:通常由生成器和判别器组成,通过学习图像数据的概率分布来生成新的图像。

Lora 模型:

类型:图像生成模型,特定于 Stable Diffusion 的一个子模型。

功能:Lora 模型是 Stable Diffusion 模型的一种变体,用于生成图像。

结构:具体结构可能因实现而异,但通常与 Stable Diffusion 模型类似,通过学习图像数据的概率分布来生成新的图像。

Lora 模型可能使用了 Stable Diffusion 中特定的训练方法或技巧,以提高模型的性能和稳定性。这些方法可能包括对训练过程中的损失函数、优化器和学习率的调整,以及对训练数据和噪声分布的处理。Lora 模型是 Stable Diffusion 的一个变体,它在图像生成方面可能具有一些特定的优化或改进。

Embedding 模型:

类型:自然语言处理模型,用于将文本转换为低维向量表示。

功能:主要用于文本处理任务,如语义分析、情感分析、命名实体识别等。

结构:通常由神经网络组成,将单词或标记映射到连续的低维向量空间中。

在 Stable Diffusion 中,Embedding 模型可能被用于将文本描述或提示转换为向量表示,以便与图像生成模型进行输入嵌入。这些文本描述可以指导模型生成特定主题、风格或内容的图像。通过将文本与图像关联起来,Embedding 模型可以帮助 Stable Diffusion 模型更好地理解文本提示并生成相关的图像

Hypernetworks 模型:

类型:神经网络结构,用于动态生成其他神经网络的参数。

功能:主要用于动态生成神经网络的参数,可用于模型个性化、迁移学习等任务。

结构:通常包含一个主网络和一个或多个次要网络,主网络用于生成参数,次要网络用于执行任务。

通过引入 Hypernetworks,Stable Diffusion 可能可以更灵活地调整模型的结构和参数,从而适应不同的数据集或任务。Hypernetworks 可能还可以用于个性化模型,使其更好地适应特定用户或应用场景

文生图示例

使用chilloutmix_NiPrunedFp32Fix.safetensors模型生成示例,在左上下拉框选择相应的大模型,输入正面提示词和负面提示词,点击生成文章来源:https://www.toymoban.com/news/detail-828617.html

quality,masterpiece,realistic,ballerina,female,yoga_pants,black_choker,Hands on waist,smile,mansion,simple_background,

Steps: 20, Sampler: DPM++ 2M Karras, CFG scale: 7, Seed: 2022028845, Size: 512x768, Model hash: fc2511737a, Model: chilloutmix_NiPrunedFp32Fix, ADetailer model: face_yolov8n.pt, ADetailer confidence: 0.3, ADetailer dilate erode: 4, ADetailer mask blur: 4, ADetailer denoising strength: 0.4, ADetailer inpaint only masked: True, ADetailer inpaint padding: 32, ADetailer version: 24.1.2, Version: v1.7.0

文章来源地址https://www.toymoban.com/news/detail-828617.html

到了这里,关于【AIGC】Stable Diffusion的模型入门的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!