一、实现目标

第一篇文章就有交代,想要打造一个AIGC,既然都是AI了,那么当然希望人工干预的成分越低越好,所以初步想法就是

1)我输入一些关键字;

2)ChatGLM可以自主识别出我意图;

3)ChatGLM可以自主判断出为了满足我的意图,它需要执行哪些动作;

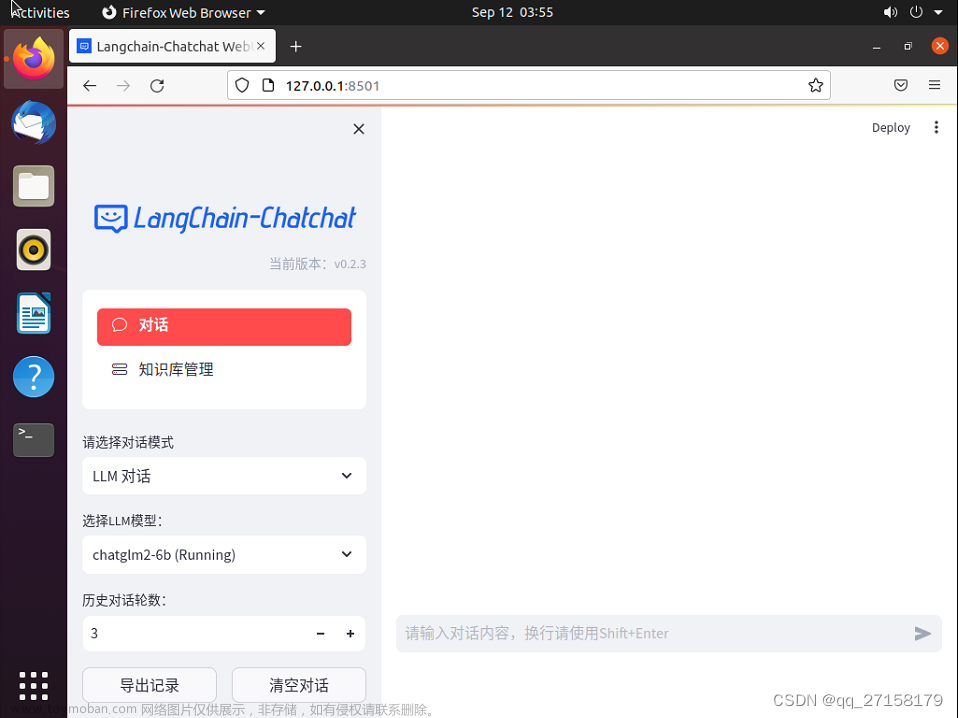

但是ChatGLM只是一个预训练的大语言模型,在执行动作上这个层面上来讲,可行性不大,那么就只有基于ChatGLM做业务层的开发,将单一业务封装成一个一个的工具,通过Prompt预先告诉ChatGLM这些工具的作用,然后让它去判断要使用哪些工具,以及这些工具调用的顺序情况

langchain在这一方面为我们做了很好的封装,但是经过测试,并不完全适合于ChatGLM,网上针对这一块到处的说法都千篇一律,也搞得好像很深奥的样子,其实就是提示词工程

二、Agent概述

2.1 基本概念

Agent主要分为两种:

执行代理:在每一步骤需要执行前,使用所有先前执行的输出来决定下一个执行

计划和执行代理:预先决定完整的操作顺序,然后执行所有操作而不更新计划

Agent里面涉及的其他类包括:

工具:代理可以采取的操作。说直接一点就是具体干活的

这些概念不清楚其实也没关系,主要是明白自己想做什么,明白代理和工具的关系。用户把关键信息告诉Agent,Agent决定使用哪些工具,可能有的朋友会疑惑,不是说ChatGLM决定使用哪些工具的吗?文章来源:https://www.toymoban.com/news/detail-829509.html

解惑:Agent里面有一个对象llm,最终决定使用哪些工具是Agent里面的llm(ChatGLM)决定的文章来源地址https://www.toymoban.com/news/detail-829509.html

2.2 执行流程及重点类&方法&属性

到了这里,关于chatglm2-2b+sdxl1.0+langchain打造私有AIGC(四)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!