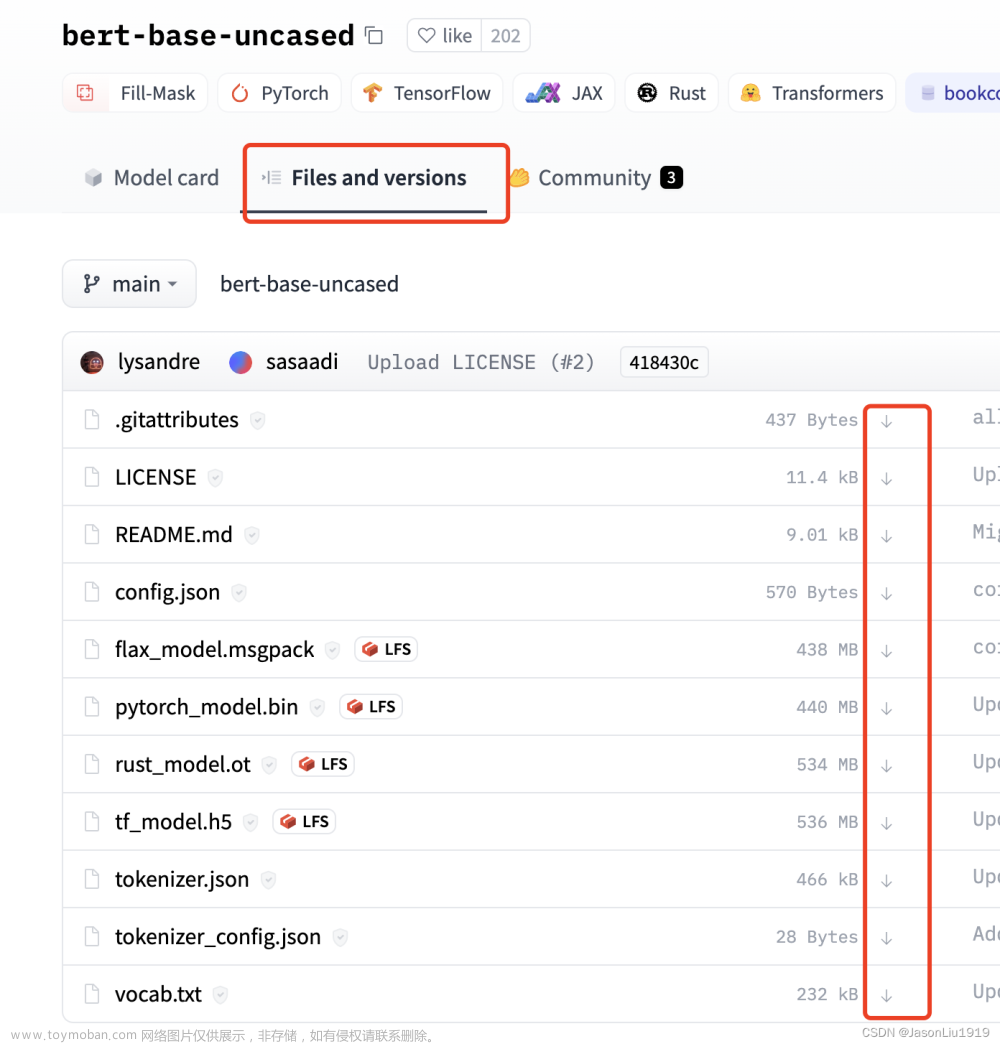

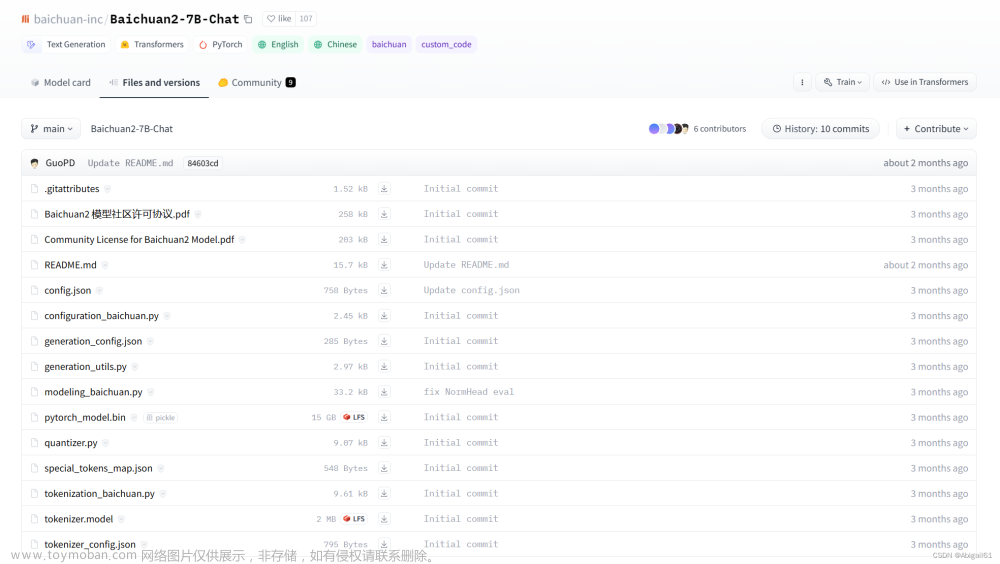

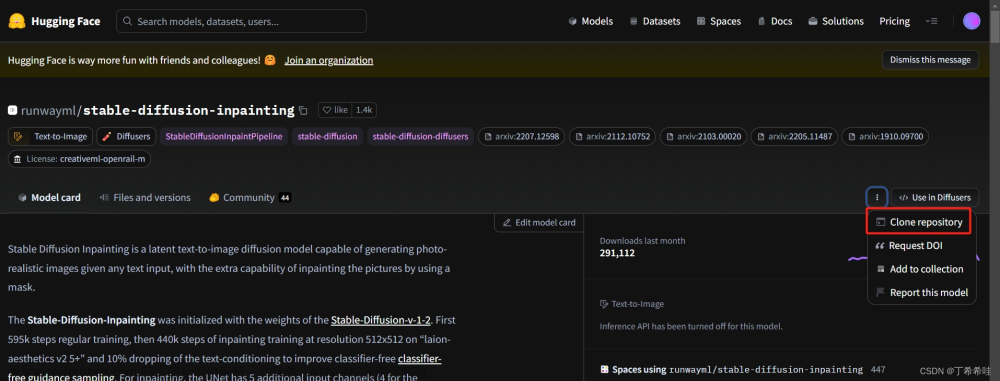

通常通过镜像网站下载https://hf-mirror.com/。

在链接页面有介绍方法,对于不大的模型可以直接下载。这里介绍比较常用且方便的下载方法。

使用huggingface 官方提供的 huggingface-cli 命令行工具

安装(huggingface_hub、hf_transfer安装可以使用-i命令从镜像网站下载)

pip install -U huggingface_hub hf_transfer

基本命令(每次打开远程链接都要输入)

export HF_HUB_ENABLE_HF_TRANSFER=1

export HF_ENDPOINT=https://hf-mirror.com

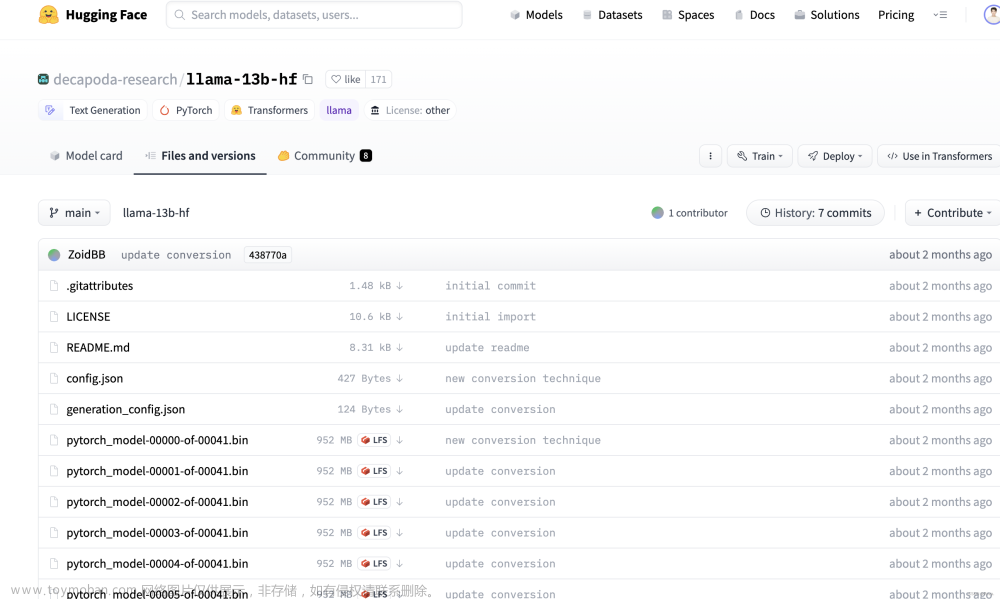

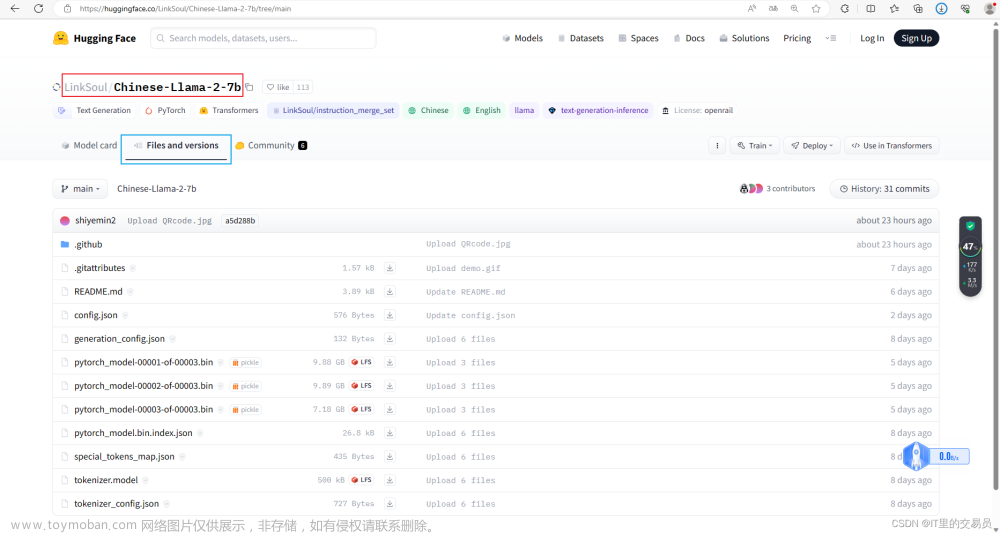

下载模型(下载NousResearch/Llama-2-13b-chat-hf,放在当前目录文件夹Llama-2-13b-chat-hf下)文章来源:https://www.toymoban.com/news/detail-832303.html

huggingface-cli download --resume-download NousResearch/Llama-2-13b-chat-hf --local-dir Llama-2-13b-chat-hf --local-dir-use-symlinks False

携带参数下载文章来源地址https://www.toymoban.com/news/detail-832303.html

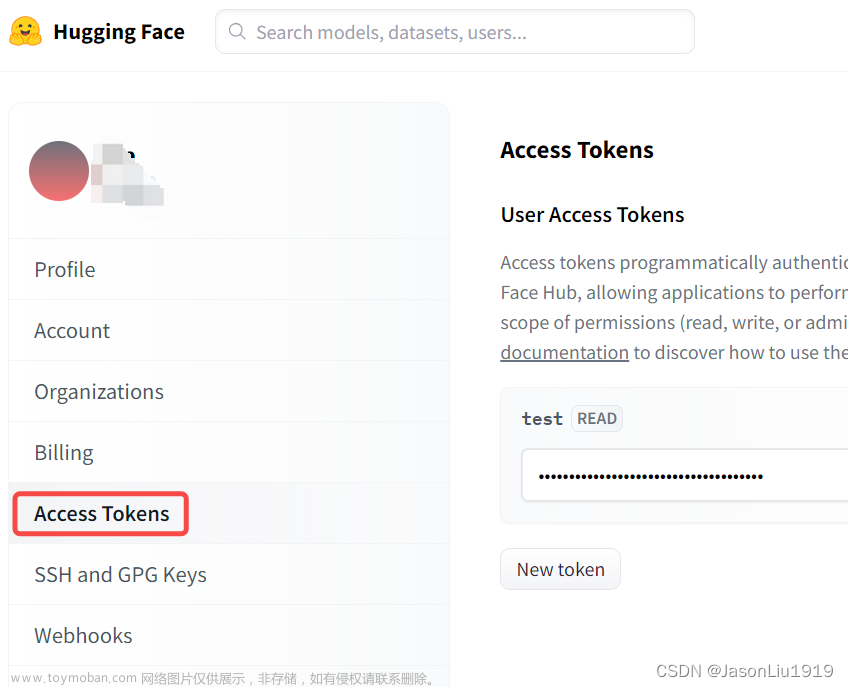

huggingface-cli download --token hf_*** --resume-download meta-llama/Llama-2-7b-hf --local-dir Llama-2-7b-hf --local-dir-use-symlinks False

到了这里,关于Huggingface镜像网站下载语言模型方法的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!