深度学习的基本原理、算法和神经网络的基本概念是人工智能领域中非常重要的部分,下面我将分别深入解释这些内容。

深度学习的基本原理

深度学习的基本原理在于使用深层神经网络来模拟人脑神经元的连接方式,从而实现对复杂数据的分析和处理。它依赖于大量的数据,通过训练多层神经网络,让模型自动提取数据的特征并进行分类或预测。深度学习的核心是特征学习,即模型能够自动从原始数据中学习有用的特征,而不需要人为进行特征工程。

深度学习的算法

深度学习的算法主要包括前向传播和反向传播。文章来源:https://www.toymoban.com/news/detail-834125.html

- 前向传播:在前向传播过程中,输入数据从输入层开始,逐层向前传播,经过每一层的神经元计算,最终到达输出层。这一过程中,每一层神经元都会根据上一层的输出和本层的权重、偏置等参数进行计算,得到本层的输出。

- 反向传播:反向传播是深度学习中用于训练模型的关键算法。在模型预测结果与实际结果存在误差时,反向传播算法会根据误差计算每一层神经元的梯度,然后将梯度从输出层逐层反向传播到输入层,并根据梯度更新每一层的权重和偏置参数。通过多次迭代训练,模型会逐渐减小误差,提高预测准确性。

神经网络的基本概念

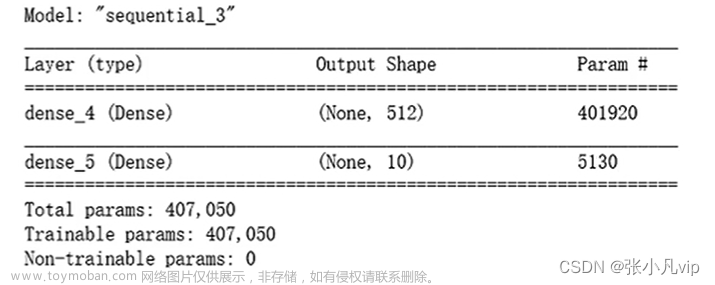

- 神经网络:神经网络是由大量神经元相互连接而成的网络结构。每个神经元接收来自其他神经元的输入信号,根据自身的权重和偏置进行计算,并输出到下一层神经元。神经网络可以分为全连接神经网络、卷积神经网络、循环神经网络等多种类型。

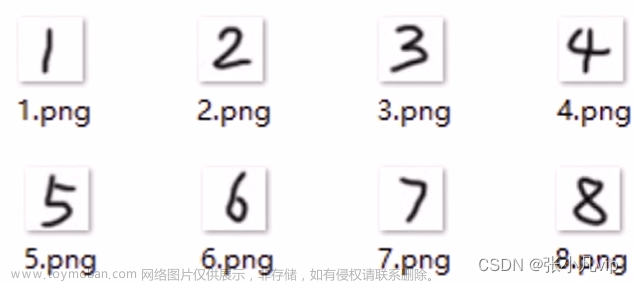

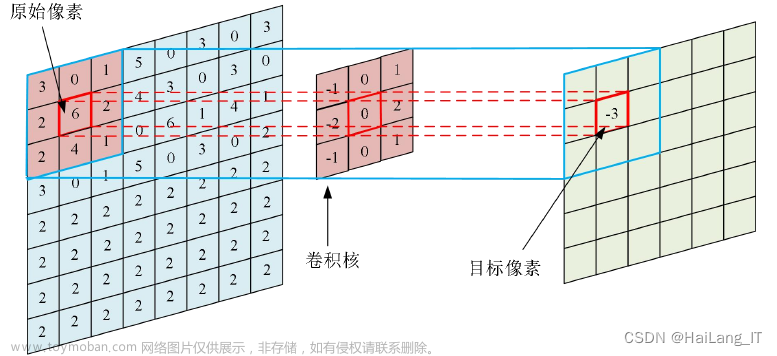

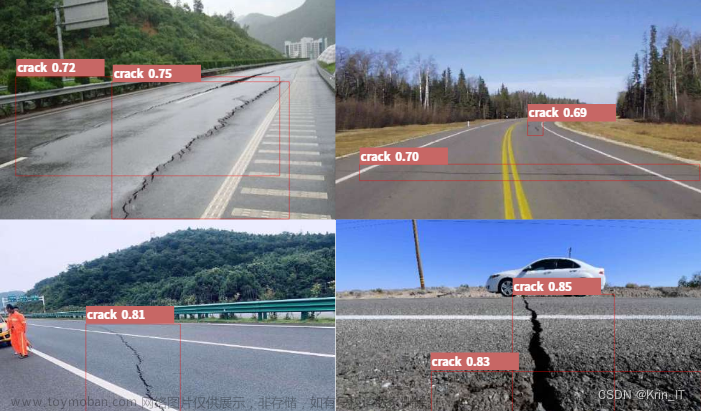

- 卷积神经网络(CNN):卷积神经网络是一种专门用于处理图像数据的神经网络。它通过卷积层、池化层等结构提取图像的特征,从而实现对图像的分类、识别等任务。卷积神经网络在图像处理、计算机视觉等领域取得了显著的成果。

- 循环神经网络(RNN):循环神经网络是一种用于处理序列数据的神经网络。它通过引入循环结构,使得网络可以记住之前的输入信息,从而实现对序列数据的建模。循环神经网络在自然语言处理、语音识别等领域有着广泛的应用。

总结来说,深度学习通过构建深层神经网络来模拟人脑神经元的连接方式,利用前向传播和反向传播算法进行模型训练,从而实现对复杂数据的分析和处理。神经网络作为深度学习的基础,包括全连接神经网络、卷积神经网络和循环神经网络等多种类型,它们分别适用于不同的任务和数据类型。文章来源地址https://www.toymoban.com/news/detail-834125.html

到了这里,关于深度学习的基本原理和算法的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!