1.背景介绍

计算机视觉和机器人技术是人工智能领域的重要研究方向之一,它们在各个领域的应用都非常广泛。计算机视觉技术可以让计算机理解和处理人类世界中的图像和视频,从而实现对环境的理解和交互。机器人技术则可以让机器具有行动和感知的能力,从而实现与人类相互作用和协作。

在过去的几十年里,计算机视觉和机器人技术取得了显著的进展。早期的计算机视觉系统主要关注图像处理和特征提取,而后来的研究逐渐向量量化、分类和识别方向发展。随着深度学习技术的兴起,计算机视觉技术取得了巨大的突破,如Facebook的DeepFace、Google的Inception等。同时,机器人技术也取得了显著的进展,如Boston Dynamics的大型机器人、苹果的HomePod等。

本文将从计算机视觉和机器人技术的发展历程、核心概念、算法原理、应用案例和未来趋势等方面进行全面的介绍。

2.核心概念与联系

2.1计算机视觉

计算机视觉是计算机科学领域的一个分支,研究如何让计算机理解和处理人类世界中的图像和视频。计算机视觉技术可以应用于各种领域,如医疗诊断、安全监控、自动驾驶、人工智能等。

计算机视觉的主要任务包括:图像获取、预处理、特征提取、分类和识别等。图像获取是指从物理世界中获取图像数据,如摄像头、雷达等。预处理是指对图像数据进行预处理,如去噪、增强、分割等。特征提取是指从图像中提取有意义的特征,如边缘、纹理、颜色等。分类和识别是指根据特征信息将图像分为不同的类别,如人脸识别、车辆识别等。

2.2机器人

机器人是一种自主行动的设备,可以通过感知、理解、决策和执行来完成一定的任务。机器人可以分为两类:无人机和无人车。无人机是一种具有飞行能力的机器人,可以用于拍照、监控、传输等任务。无人车是一种具有移动能力的机器人,可以用于物流、运输、救援等任务。

机器人的主要组成部分包括:感知系统、运动控制系统、计算系统等。感知系统负责获取环境信息,如摄像头、雷达、激光雷达等。运动控制系统负责控制机器人的运动,如电机、舵机、泵等。计算系统负责处理机器人的数据,如计算机、控制器、传感器等。

2.3计算机视觉与机器人的联系

计算机视觉和机器人技术在很多方面是相互关联的。计算机视觉技术可以为机器人提供视觉感知能力,从而实现与人类相互作用和协作。机器人技术可以为计算机视觉技术提供运动和感知能力,从而实现对环境的理解和交互。

3.核心算法原理和具体操作步骤以及数学模型公式详细讲解

3.1图像处理

图像处理是计算机视觉系统对图像数据进行处理的过程,主要包括:滤波、边缘检测、形状识别等。

滤波是指对图像数据进行噪声除去的过程,主要包括:平均滤波、中值滤波、高斯滤波等。平均滤波是指将图像数据与周围的邻域数据进行平均运算,以消除噪声。中值滤波是指将图像数据与周围的邻域数据进行中值运算,以消除噪声。高斯滤波是指将图像数据与高斯分布的邻域数据进行加权平均运算,以消除噪声。

边缘检测是指对图像数据进行边缘提取的过程,主要包括:拉普拉斯算子、斯坦蒂亚克算子、赫夫曼算子等。拉普拉斯算子是指对图像数据进行二阶差分运算,以提取边缘信息。斯坦蒂亚克算子是指对图像数据进行梯度运算,以提取边缘信息。赫夫曼算子是指对图像数据进行稀疏表示,以提取边缘信息。

形状识别是指对图像数据进行形状特征提取的过程,主要包括:轮廓检测、轮廓描述、形状匹配等。轮廓检测是指对图像数据进行边缘检测后,对边缘信息进行分割和提取的过程。轮廓描述是指对轮廓信息进行特征提取的过程,如面积、周长、形状因子等。形状匹配是指对轮廓信息进行比较和匹配的过程,以实现对象识别。

3.2特征提取

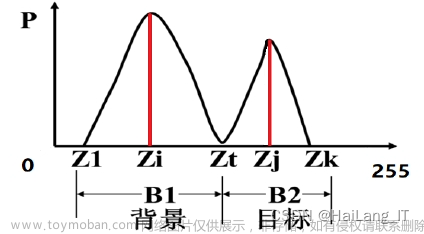

特征提取是指对图像数据进行有意义特征提取的过程,主要包括:边缘检测、颜色分割、纹理分割等。边缘检测是指对图像数据进行边缘提取的过程,如拉普拉斯算子、斯坦蒂亚克算子、赫夫曼算子等。颜色分割是指对图像数据进行颜色信息分割和提取的过程,如K-均值聚类、色彩历史图等。纹理分割是指对图像数据进行纹理信息分割和提取的过程,如Gabor滤波、拉普拉斯纹理等。

3.3分类和识别

分类和识别是指根据特征信息将图像分为不同的类别的过程,主要包括:训练和测试、特征提取、分类器设计、性能评估等。训练和测试是指将训练集和测试集分别用于训练和测试模型的过程。特征提取是指对图像数据进行特征提取的过程,如边缘检测、颜色分割、纹理分割等。分类器设计是指根据特征信息设计分类器的过程,如支持向量机、决策树、随机森林等。性能评估是指对模型性能进行评估的过程,如准确率、召回率、F1分数等。

3.4数学模型公式详细讲解

3.4.1平均滤波

平均滤波公式为: $$ f(x,y) = \frac{1}{w \times h} \sum{i=-w/2}^{w/2-1} \sum{j=-h/2}^{h/2-1} f(x+i,y+j) $$ 其中,$f(x,y)$ 表示过滤后的像素值,$w$ 和 $h$ 分别表示滤波核的宽度和高度。

3.4.2高斯滤波

高斯滤波公式为: $$ g(x,y) = \frac{1}{2\pi\sigma^2}e^{-\frac{x^2+y^2}{2\sigma^2}} $$ $$ F(u,v) = \iint g(x,y)e^{-j2\pi(ux+vy)}dxdy $$ 其中,$g(x,y)$ 表示高斯滤波核的值,$\sigma$ 表示标准差,$F(u,v)$ 表示频域的高斯滤波核。

3.4.3拉普拉斯算子

拉普拉斯算子公式为: $$ L(x,y) = \Delta f(x,y) = f(x+1,y) + f(x-1,y) + f(x,y+1) + f(x,y-1) - 4f(x,y) $$ 其中,$L(x,y)$ 表示拉普拉斯算子的值,$f(x,y)$ 表示原始图像的像素值。

3.4.4K-均值聚类

K-均值聚类公式为: $$ \min{C} \sum{i=1}^{n} \sum{j=1}^{k} u{ij}d{ij}^2 $$ 其中,$C$ 表示簇中心,$u{ij}$ 表示数据点$i$属于簇$j$的概率,$d_{ij}$ 表示数据点$i$与簇$j$中心之间的欧氏距离。

4.具体代码实例和详细解释说明

4.1图像处理

```python import cv2 import numpy as np

读取图像

滤波

blur = cv2.blur(img,(5,5))

边缘检测

edges = cv2.Laplacian(img,cv2.CV_64F)

形状识别

contours, hierarchy = cv2.findContours(edges,cv2.RETRTREE,cv2.CHAINAPPROX_SIMPLE)

显示图像

cv2.imshow('原图',img) cv2.imshow('滤波',blur) cv2.imshow('边缘',edges) cv2.waitKey(0) cv2.destroyAllWindows() ```

4.2特征提取

```python import cv2 import numpy as np

读取图像

颜色分割

kmeans = cv2.kmeans(img.reshape(img.shape[0] * img.shape[1], 3), 3) labels = kmeans.cluster.reshape(img.shape[0], img.shape[1], 1)

纹理分割

gabor = cv2.Gabor_US(img, 10, np.pi/4, 1, 50, 3, 10, 100, 10, 1.5, 3)

显示图像

cv2.imshow('原图',img) cv2.imshow('颜色分割',labels) cv2.imshow('纹理分割',gabor) cv2.waitKey(0) cv2.destroyAllWindows() ```

4.3分类和识别

```python from sklearn.datasets import loadiris from sklearn.modelselection import traintestsplit from sklearn.preprocessing import StandardScaler from sklearn.svm import SVC from sklearn.metrics import accuracy_score

加载数据集

iris = load_iris() X = iris.data y = iris.target

数据预处理

scaler = StandardScaler() X = scaler.fit_transform(X)

训练测试分割

Xtrain, Xtest, ytrain, ytest = traintestsplit(X, y, testsize=0.2, randomstate=42)

模型训练

clf = SVC(kernel='linear') clf.fit(Xtrain, ytrain)

模型评估

ypred = clf.predict(Xtest) print('准确率:', accuracyscore(ytest, y_pred)) ```

5.未来发展趋势与挑战

未来的计算机视觉和机器人技术趋势主要有以下几个方面:

深度学习技术的不断发展,如卷积神经网络、递归神经网络、变压器等,将会继续推动计算机视觉和机器人技术的发展。

数据集的不断扩充,如ImageNet、COCO、Cityscapes等,将会提高计算机视觉和机器人技术的性能和准确率。

硬件技术的不断发展,如GPU、TPU、ASIC等,将会提高计算机视觉和机器人技术的运行速度和效率。

人工智能技术的不断融合,如自然语言处理、知识图谱、推理推测等,将会使计算机视觉和机器人技术具有更强的理解和交互能力。

安全和隐私问题的不断关注,如数据泄露、隐私侵犯等,将会引发计算机视觉和机器人技术的安全和隐私技术的发展。

未来的计算机视觉和机器人技术面临的挑战主要有以下几个方面:

数据不均衡问题,如图像数据集中的类别不均衡、样本不均衡等,将会影响计算机视觉和机器人技术的性能和准确率。

模型解释性问题,如深度学习模型的黑盒性,将会影响计算机视觉和机器人技术的可解释性和可靠性。

算法效率问题,如深度学习模型的计算开销,将会影响计算机视觉和机器人技术的运行速度和效率。文章来源:https://www.toymoban.com/news/detail-834765.html

多模态数据融合问题,如计算机视觉和语音等多种感知模态的数据融合,将会引发计算机视觉和机器人技术的新的研究方向和挑战。文章来源地址https://www.toymoban.com/news/detail-834765.html

6.附录常见问题与解答

- 问:计算机视觉和机器人技术的区别是什么? 答:计算机视觉技术主要关注如何让计算机理解和处理人类世界中的图像和视频,而机器人技术主要关注如何让机器具有行动和感知的能力。

- 问:深度学习与传统机器学习的区别是什么? 答:深度学习是一种基于神经网络的机器学习方法,它可以自动学习特征和模式,而传统机器学习是一种基于手工提取特征和模式的机器学习方法。

- 问:机器人的运动控制系统和计算系统有什么区别? 答:运动控制系统负责控制机器人的运动,如电机、舵机、泵等,而计算系统负责处理机器人的数据,如计算机、控制器、传感器等。

- 问:计算机视觉和机器人技术的未来发展趋势是什么? 答:未来的计算机视觉和机器人技术趋势主要有以下几个方面:深度学习技术的不断发展、数据集的不断扩充、硬件技术的不断发展、人工智能技术的不断融合等。

- 问:计算机视觉和机器人技术面临的挑战是什么? 答:未来的计算机视觉和机器人技术面临的挑战主要有以下几个方面:数据不均衡问题、模型解释性问题、算法效率问题、多模态数据融合问题等。

到了这里,关于计算机视觉与机器人:智能机器人的发展与应用的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!