叶梓,上海交通大学计算机专业博士毕业,高级工程师。主研方向:数据挖掘、机器学习、人工智能。历任国内知名上市IT企业的AI技术总监、资深技术专家,市级行业大数据平台技术负责人。

长期负责城市信息化智能平台的建设工作,开展行业数据的智能化应用研发工作,牵头多个省级、市级行业智能化信息系统的建设,主持设计并搭建多个省级、市级行业大数据平台。参与国家级人工智能课题,牵头上海市级人工智能示范应用课题研究。

带领团队在相关行业领域研发多款人工智能创新产品,成功落地多项大数据、人工智能前沿项目,其中信息化智能平台项目曾荣获:“上海市信息技术优秀应用成果奖”。带领团队在参加国际NLP算法大赛,获得Top1%的成绩。参与国家级、省级大数据技术标准的制定,曾获省部级以上的科技创新一等奖。

大语言模型技术原理与实践

【课程简介】

本课程旨在通过实际案例展示ChatGPT、ChatGLM、Langchain等相关大语言模型的具体应用场景及实践技巧,从而帮助学习者深入了解和掌握大语言模型的概念和更广泛的应用,深入理解其工作方式,包括其基础知识、核心算法和实现方式,掌握其在各行业领域中的应用情况等。

该课程适合于对大语言模型技术感兴趣的学习者,从初学者到进阶者均可受益。经过本课程的学习,获得相关技术实战经验,通过一系列的实践案例提高利用大模型解决实际问题能力。

【课程时长】

3天(6小时/天)

【课程对象】

理工科本科及以上,且至少了解一门编程语言。

【课程大纲】(培训内容可根据客户需求调整)

| Day1下午 |

强化学习基础

chatGPT的原理介绍 1、指示学习与InstructGPT 2、相关数据集 3、有监督微调(SFT) 4、从人类反馈中RL的思路 5、奖励建模(RM) 6、运用PPO改进 |

| Day2上午 |

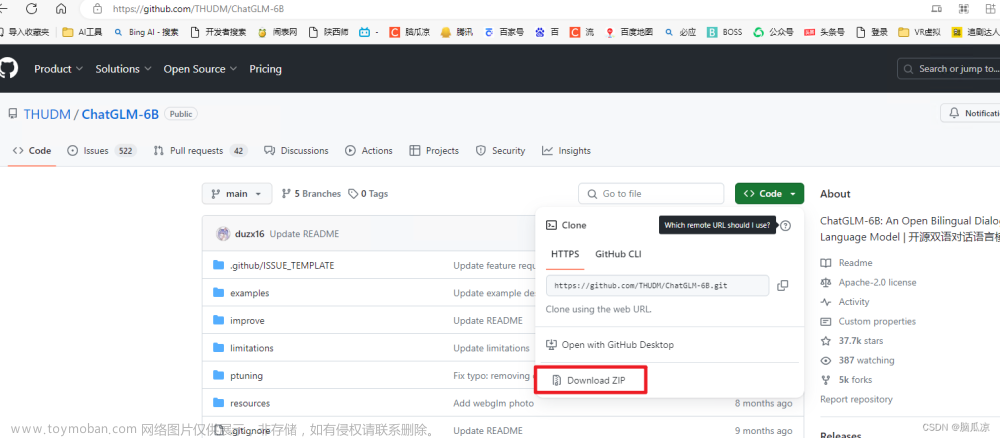

ChatGLM部署 1、ChatGLM3-6B介绍 2、ChatGLM3搭建流程 3、应用场景(工具调用、代码执行) 4、权重量化 ChatGLM3原理 1、Code Interpreter 2、多模态CogVLM 3、WebGLM搜索增强 微调大模型 1、基于chatGLM的微调 2、LoRA 3、Prefix Tuning 4、P-Tuning 5、Prompt Tuning 6、freeze 7、构建训练数据集 |

| Day2下午 |

其他开源大模型 1、LLaMA系列 2、通义千问(qwen) 3、零一万物(Yi) llama-factory微调大模型 1、工具的主要功能 2、支持的模型 3、数据集准备 4、微调策略(LoRA, QLoRA, PEFT) |

| Day3上午 |

学习LangChain所需的知识储备 1、词嵌入与语义空间 2、高维向量的快速模糊匹配 3、局部敏感哈希(LSH) 4、向量数据库 LangChain的原理 1、大模型利用的难点与痛点 2、Langchain的基本思路 3、关键组件 |

| Day3下午 |

LangChain的实操 1、环境搭建 2、知识库向量化与存储 3、问句向量化与初步匹配 4、合成prompt(提示词) 5、提交给LLM生成答案 大语言模型的其他应用 1、kimi chat 2、coze文章来源:https://www.toymoban.com/news/detail-835959.html 3、文心一格与通义万相文章来源地址https://www.toymoban.com/news/detail-835959.html |

到了这里,关于人工智能讲师AI讲师大模型讲师叶梓介绍及大语言模型技术原理与实践提纲的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!