目录

1、K-近邻算法

1.1 K-近邻算法原理

1.2 K - 近邻算法API

1.3 案例1:鸢尾花种类预测

1.3.1 数据集介绍

1.3.2 步骤

1.4 KNN 算法总结

- sklearn转换器和估算器

- KNN算法

- 模型选择和调优

- 朴素贝叶斯算法

- 决策树

- 随机森林

1、K-近邻算法

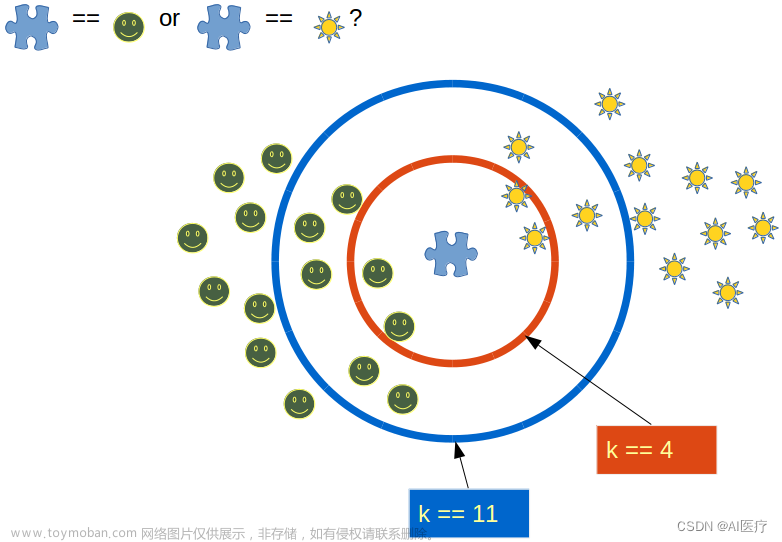

1.1 K-近邻算法原理

1.2 K - 近邻算法API

1.3 案例1:鸢尾花种类预测

1.3.1 数据集介绍

文章来源:https://www.toymoban.com/news/detail-836043.html

文章来源:https://www.toymoban.com/news/detail-836043.html

1.3.2 步骤

- 获取数据

- 数据集划分

- 特征工程 - 标准化

- KNN预估器流程

- 模型评估

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.neighbors import KNeighborsClassifier

from sklearn.preprocessing import StandardScaler

def knn_iris():

# 用KNN 算法对鸢尾花进行分类

# 1、获取数据

iris = load_iris()

# 2、划分数据集

x_train,x_test,y_train,y_test = train_test_split(iris.data,iris.target,random_state=6)

# 3、特征工程 - 标准化

transfer = StandardScaler()

x_train = transfer.fit_transform(x_train)

x_test = transfer.transform(x_test)

# 4、KNN 算法预估器

estimator = KNeighborsClassifier(n_neighbors=3)

estimator.fit(x_train,y_train)

# 5、模型评估

# 方法1 :直接比对真实值和预测值

y_predict = estimator.predict(x_test)

print("y_predict:\n",y_predict)

print("直接比对真实值和预测值:\n",y_test == y_predict)

# 方法2:计算准确率

score = estimator.score(x_test,y_test)

print("准确率为:\n",score)

return None

if __name__ == "__main__":

# 代码1 :用KNN算法对鸢尾花进行分类

knn_iris()1.4 KNN 算法总结

文章来源地址https://www.toymoban.com/news/detail-836043.html

文章来源地址https://www.toymoban.com/news/detail-836043.html

到了这里,关于四、分类算法 - KNN算法(K-近邻算法)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!