OpenAI的Sora已经引起广泛关注,预计今年AI跳舞视频将在抖音平台上大放异彩。下面将为您详细介绍一款字节跳动发布的AI视频动画框架。

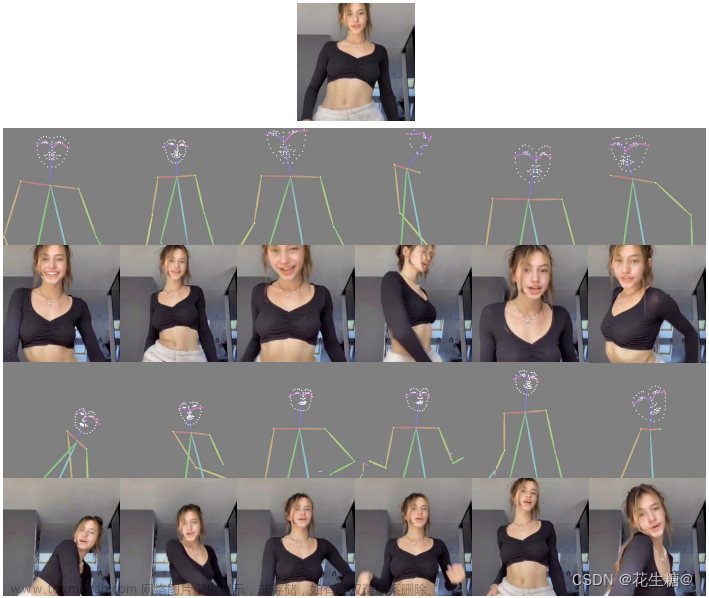

技术定位:这款框架采用先进的diffusion技术,专注于生成人类舞蹈视频。它不仅能够实现人体动作和表情的迁移,还能保持身份信息的准确性。

技术框架:该框架采用两阶段训练策略。第一阶段专注于预训练外观控制模块,而第二阶段则对外观-姿态联合控制模块进行微调。外观控制模型采用了Stable Diffusion结构,确保了生成视频的高质量和逼真度。

核心功能:此框架能够生成流畅、逼真的人类舞蹈视频,同时确保身份信息的一致性。它支持人体动作和表情的迁移,实现了零样本动画生成,为用户提供了更加灵活和多样化的创作空间。

应用场景:这款框架在生成真实人类舞蹈视频方面具有广泛的应用前景,不仅具有商业应用价值,还可扩展至动画生成领域,为创作者提供更多创作灵感。

创业方向:基于这款框架,您可以打造具有人类形态的数字虚拟角色,进行虚拟表演。此外,您还可以将其商业化作为视频生成服务,满足用户个性化定制需求,开启全新的商业模式。

产品化思路:这款框架可与游戏引擎或3D动画软件集成,构建更加丰富的应用场景。同时,也可以独立开发应用,为用户提供更加便捷的舞蹈视频生成体验。需要注意的是,为了支持模型运算,您需要提供稳定的服务支持。

工作流程:使用这款框架生成AI跳舞视频的工作流程包括以下几个步骤:采集训练数据(人类舞蹈视频)、标注关键点、图像处理、两阶段模型训练、部署服务和与APP/网站集成。这些步骤将帮助您快速生成高质量的舞蹈视频。

优势:这款框架具有卓越的算法性能,支持零样本生成,易于集成使用。它为用户提供了更加灵活和多样化的创作方式,让舞蹈视频生成变得更加简单高效。

劣势:虽然这款框架具有诸多优势,但也存在一些劣势。例如,计算量较大,对硬件需求较高。此外,数据采集和处理成本也相对较高,需要投入更多的资源和时间。

总之,这款基于diffusion技术的AI视频动画框架为舞蹈视频生成带来了革命性的变革。它不仅具有广泛的应用前景和商业价值,还为创作者提供了更加灵活和多样化的创作方式。随着技术的不断发展和优化,相信这款框架将在未来为舞蹈视频创作领域带来更多的惊喜和突破。

最后代码分享:https://github.com/Boese0601/MagicDance?tab=readme-ov-filehttps://github.com/Boese0601/MagicDance?tab=readme-ov-file

文章来源:https://www.toymoban.com/news/detail-836673.html

文章来源:https://www.toymoban.com/news/detail-836673.html

文章来源地址https://www.toymoban.com/news/detail-836673.html

文章来源地址https://www.toymoban.com/news/detail-836673.html

到了这里,关于OpenAI Sora引领AI跳舞视频新浪潮:字节跳动发布创新舞蹈视频生成框架的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[ai笔记8] 聊聊openAI最新文生视频产品-Sora](https://imgs.yssmx.com/Uploads/2024/02/828158-1.png)