【论文阅读】DeepLab:语义图像分割与深度卷积网络,自然卷积,和完全连接的crf

DeepLab: Semantic Image Segmentation with Deep Convolutional Nets, Atrous Convolution, and Fully Connected CRFs

深度学习解决了语义图像分割的任务

做出了三个主要贡献,这些贡献在实验中被证明具有实质性的实际价值

-

强调卷积与上采样滤波器,或“空洞卷积”,作为一个强大的工具在密集预测任务

作用:卷积实现不增加参数数量或计算量的情况下有效地扩大过滤器的视野,以纳入更大的上下文**

-

空间金字塔池(ASPP)的多尺度目标鲁棒分割方法

作用:在多个尺度上捕获对象和图像上下文

-

结合DCNNs和概率图模型的方法,改进了目标边界的定位

作用:条件随机场(CRF)相定性和定量地展示了定位性能

提出的DeepLab系统在PASCAL VOC -2012语义图像分割任务

一、介绍

以端到端方式训练的DCNNs比依赖手工制作特征的系统提供了明显更好的结果

DCNNs对局部图像变换的内置不变性,这使得它们能够学习越来越抽象的数据表示

可能会妨碍语义分割等密集的预测任务,因为在这些任务中不需要对空间信息进行抽象

DCNN应用于语义图像分割的三个挑战:

- 特征分辨率降低

- 多个尺度上存在目标

- 由于DCNN的不变性而降低了定位精度

当DCNN以完全卷积的方式使用时,这将导致显著降低空间分辨率的特征图

DCNNs的最后几个最大池化层中去除下采样算子,并在随后的卷积层中对滤波器进行上采样

采用空洞卷积作为上采样滤波器卷积

空洞卷积允许我们在不增加参数数量或计算量的情况下有效地扩大滤波器的视场

相当于用具有互补有效视场的多个滤波器探测原始图像,从而在多个尺度上捕获物体以及有用的图像上下文

我们的工作探索了一种我们认为非常有效的替代方法。

采用完全连接的条件随机场(CRF)来提高模型捕获精细细节的能力

crf已广泛用于语义分割,将多路分类器计算的类分数与像素和边缘的局部相互作用捕获的低级信息相结合

越来越复杂的工作来模拟层次依赖关系

使用了完全连接的成对CRF,它具有高效的计算能力,并且能够捕捉精细的边缘细节,同时还能满足长距离依赖关系

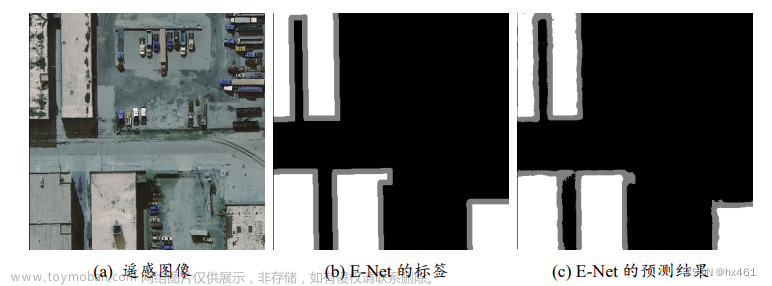

DeepLab模型的高级说明如图

重新用于语义分割任务:

- 将所有全连接层转换为卷积层(即全卷积网络[14])

- 通过亚卷积层增加特征分辨率

- 双线性插值将分数图上采样8倍,以达到原始图像分辨率

- 输入输出到一个完全连接的CRF

双线性插值阶段将特征映射扩大到原始图像分辨率。然后应用全连接的CRF来细化分割

二、联系工作

大多数成功的语义分割系统依赖于手工制作的特征与平面分类器相结合

但这些系统的性能一直受到特征表达能力有限的影响

- 第一类基于dcnn的语义分割系统通常采用自下而上的级联图像分割

- 第二类工作依赖于使用卷积计算的DCNN特征进行密集图像标记

- 第三类作品使用DCNNs直接提供密集的类别级像素标签

本文工作建立在这些工作的基础上,,通过控制特征分辨率、引入多尺度池化技术和在DCNN之上集成密集连接的CRF[22]来扩展它们

DCNN与CRF的结合当然并不新鲜,但之前的研究都是尝试局部连接的CRF模型

我们采用的全连接CRF模型[22]中的高斯CRF电位可以捕获远程依赖关系

大部分方法成功地对DCNN和CRF进行了联合学习

对整个训练集都可以使用像素级语义注释的假设

空洞卷积还允许我们扩大过滤器的视野,以纳入更大的环境

三、方法

3.1 整体结构

DCNNs进行语义分割或其他密集预测任务

被证明可以通过以全卷积方式部署DCNNs来简单而成功地解决

最近的DCNNs中,每个方向的分辨率通常是32倍。部分补救措施是使用“反卷积”层

图中的公式表明卷积的速度和扩展的快慢

速率参数r对应于我们对输入信号进行采样的步幅

在低分辨率输入特征映射上进行标准卷积稀疏特征

在高分辨率的输入特征映射上,使用率为r¼2的亚历斯卷积进行密集特征提取。

操作:

- 分辨率降低2倍

- 使用核进行卷积-这里是垂直高斯导数

- 特征映射植入到原始图像坐标

将全分辨率图像与“带孔”滤波器进行卷积,我们可以计算所有图像位置的响应

因此过滤器参数的数量和每个位置的操作次数都保持不变

相反,我们采用了一种混合方法,在效率和精度之间取得了良好的平衡,使用空洞卷积将计算特征图的密度增加了4倍,然后使用8倍的快速双线性插值来恢复原始图像分辨率的特征图

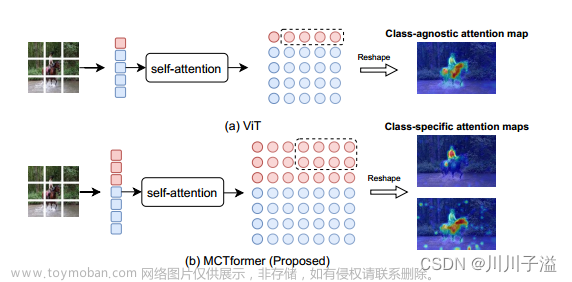

3.2 使用空间金字塔池的多尺度图像表示

cnn已经显示出一种非凡的隐式表示规模的能力

第一种方法相当于标准的多尺度处理。我们使用共享相同参数的并行DCNN分支

多尺度处理显著提高了性能,但代价是计算多尺度输入的所有DCNN层的特征响应

该方案使用多个具有不同采样率的并行空洞卷积层。每个采样率提取的特征在单独的分支中进一步处理并融合以产生最终结果。

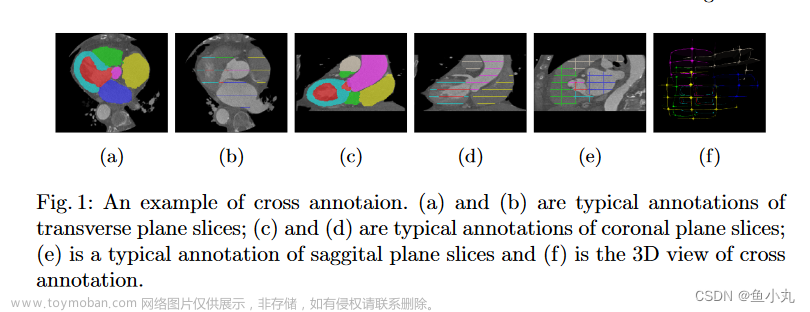

3.3 基于完全连通条件随机场(CRF)的结构预测精确边界恢复

在定位精度和分类性能之间的权衡似乎是DCNNs固有的

具有多个最大池化层的更深模型在分类任务中被证明是最成功的

DCNN得分图可以预测物体的存在和大致位置,但不能真正描绘出它们的边界

工作追求两个方向来解决这个挑战

- 利用卷积网络中的多层信息,以便更好地估计目标边界

- 采用超像素表示

基于耦合DCNNs的识别能力和全连接crf的细粒度定位精度来追求另一个方向,并表明它在解决定位挑战方面非常成功

并在远远超出现有方法范围的细节水平上恢复对象边界

作用:

- CRFs被用于平滑噪声分割映射

- 模型对相邻节点进行耦合,倾向于对空间近端像素进行相同标签分配

- 短期crf的主要功能是清除建立在局部手工设计特征之上的弱分类器的虚假预测

为了克服短程CRF的这些局限性,我们将的全连接CRF模型集成到我们的系统中

表达式在不同的特征空间中使用两个高斯核

- 第一个内核强制具有相似颜色和位置的像素具有相似的标签

- 第二个内核在强制平滑时仅考虑空间接近性

四、实验结果

我们对Imagenet-pretrained VGG-16或ResNet-101网络的模型权值进行微调,使其以一种简单的方式适应语义分割任务

SGD过程

解耦了DCNN和CRF的训练阶段文章来源:https://www.toymoban.com/news/detail-838650.html

文章来源地址https://www.toymoban.com/news/detail-838650.html

文章来源地址https://www.toymoban.com/news/detail-838650.html

到了这里,关于【论文阅读】DeepLab:语义图像分割与深度卷积网络,自然卷积,和完全连接的crf的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!