利用Hadoop进行数据湖构建与管理

一、引言

在大数据的时代,数据的增长速度已经远超过了传统的数据处理和存储能力。为了解决这个问题,数据湖的概念应运而生。数据湖是一个集中式的存储和处理平台,可以存储各种类型的数据,而不需要事先进行结构化的处理。Hadoop,作为一个分布式计算平台,为数据湖的构建和管理提供了强大的支持。

二、Hadoop与数据湖

Hadoop是一个开源的分布式计算平台,它允许用户在大规模的数据集上进行计算。Hadoop的核心组件包括分布式文件系统HDFS和计算框架MapReduce。HDFS为数据提供了高容错、高吞吐量的存储,而MapReduce则为数据提供了并行计算的能力。

数据湖是一个基于廉价存储硬件的集中式数据存储和处理平台。它可以存储各种类型的数据,包括结构化数据、非结构化数据和半结构化数据。数据湖不需要对数据进行预先的结构化处理,这使得它可以快速地存储和查询大量的数据。

Hadoop和数据湖的结合,可以为用户提供一个高效、灵活和可扩展的数据处理平台。用户可以利用Hadoop的计算能力,对数据湖中的数据进行各种复杂的计算和分析。

三、利用Hadoop构建数据湖

利用Hadoop构建数据湖,主要包括以下几个步骤:

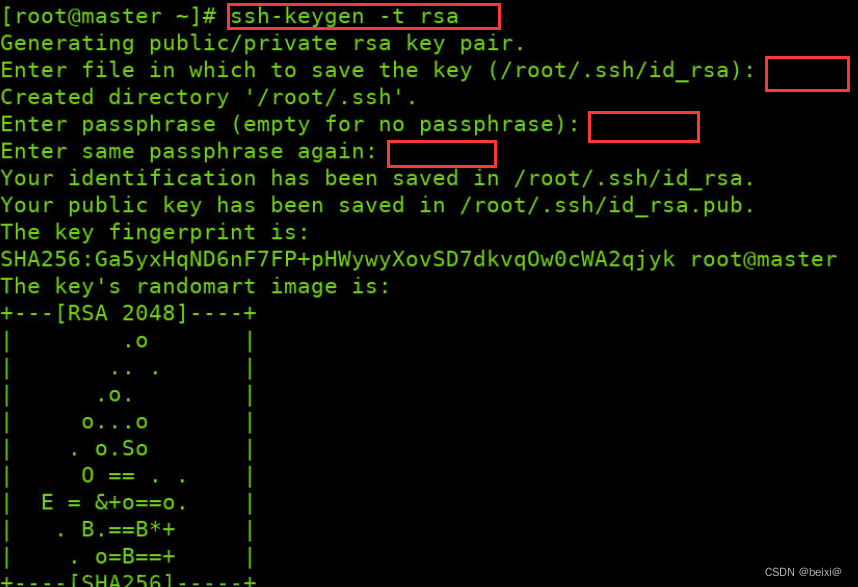

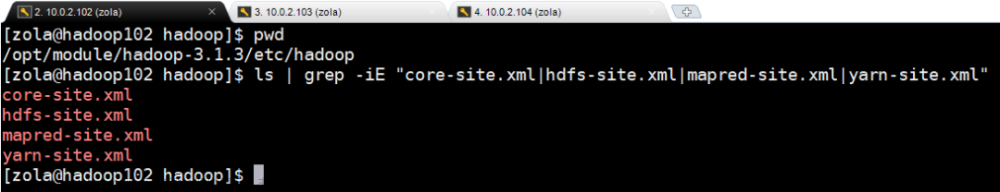

- 环境搭建:首先,需要搭建一个Hadoop集群。这包括安装和配置Hadoop的各个组件,如HDFS、MapReduce、Yarn等。

- 数据存储:然后,需要将数据存储到HDFS中。这可以通过Hadoop提供的各种工具和数据导入工具来完成。例如,可以使用Sqoop工具将数据从关系数据库导入到HDFS中。

- 数据处理:在数据存储到HDFS后,就可以利用MapReduce等工具对数据进行处理了。这包括数据的清洗、转换、聚合等操作。

- 数据查询:最后,需要提供一个方便用户查询数据的接口。这可以通过Hive、HBase等工具来实现。Hive是一个基于Hadoop的数据仓库工具,它提供了一个类SQL的查询接口,使得用户可以方便地对数据进行查询和分析。

四、利用Hadoop管理数据湖

利用Hadoop管理数据湖,主要包括以下几个方面:

- 数据管理:需要对数据进行有效的管理,包括数据的存储、备份、恢复等操作。这可以通过Hadoop提供的一些工具和API来实现。

- 数据安全:需要保证数据的安全,防止数据的丢失、泄露和被篡改。这可以通过Hadoop提供的一些安全机制来实现,如Kerberos认证、ACL访问控制等。

- 性能优化:需要对数据的处理性能进行优化,提高数据的处理速度和查询效率。这可以通过优化MapReduce任务的配置、使用更高效的数据处理算法等方式来实现。

- 监控和运维:需要对Hadoop集群进行监控和运维,保证集群的稳定运行。这可以通过Hadoop提供的一些监控工具和运维工具来实现,如Ganglia监控工具、Ambari运维工具等。

五、示例代码

以下是一个使用Hadoop MapReduce进行数据处理的简单示例代码:文章来源:https://www.toymoban.com/news/detail-839065.html

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

public class WordCount {

public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

public static class IntSumReducer extends Reducer<Text,IntWritable,Text,IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

在这个示例中,我们实现了一个简单的单词计数程序。这个程序读取输入文件中的数据,将每个单词作为键,将单词出现的次数作为值,然后将结果写入输出文件中。这个程序使用了Hadoop MapReduce的计算框架,可以处理大规模的数据集。通过这个示例,我们可以看到Hadoop在数据处理方面的强大能力。文章来源地址https://www.toymoban.com/news/detail-839065.html

到了这里,关于利用Hadoop进行数据湖构建与管理的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!