利用Python进行网络爬虫:Beautiful Soup和Requests的应用

在网络数据变得日益丰富和重要的今天,网络爬虫成为了获取和分析数据的重要工具之一。Python作为一种强大而灵活的编程语言,在网络爬虫领域也拥有广泛的应用。本文将介绍如何使用Python中的两个流行库Beautiful Soup和Requests来创建简单而有效的网络爬虫,以便从网页中提取信息。

什么是Beautiful Soup和Requests?

-

Requests:是一个简单而优雅的HTTP库,用于发送HTTP请求。它使得从网站获取数据变得非常容易,而且可以处理各种类型的HTTP请求和响应。

-

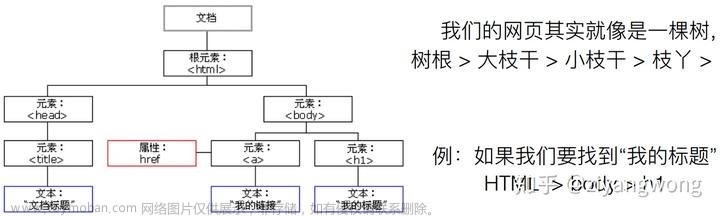

Beautiful Soup:是一个用于解析HTML和XML文档的Python库。它提供了许多方便的方法来浏览、搜索和修改解析树,使得从网页中提取信息变得非常简单。

安装和导入库

首先,确保你已经安装了这两个库。你可以使用pip来安装它们:

pip install requests beautifulsoup4

安装完成后,让我们开始编写我们的网络爬虫!

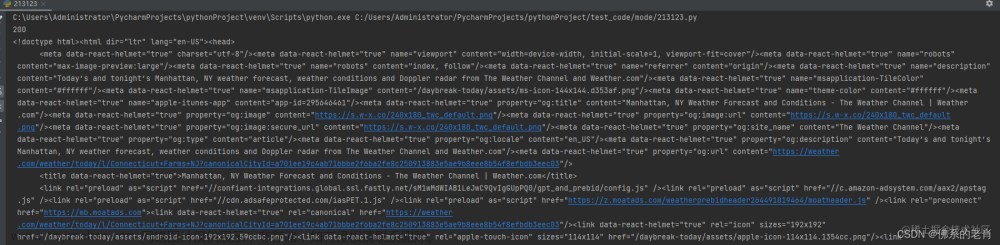

示例:提取网页中的标题和链接

我们将以一个简单的例子开始,从一个网页中提取标题和链接。假设我们要从一个博客页面中提取标题和对应的文章链接。

import requests

from bs4 import BeautifulSoup

# 定义要爬取的网页地址

url = 'https://xxxx/blog'

# 发送HTTP请求获取页面内容

response = requests.get(url)

# 使用Beautiful Soup解析页面内容

soup = BeautifulSoup(response.text, 'html.parser')

# 找到所有的标题和链接

titles = soup.find_all('h2', class_='post-title')

links = [title.a['href'] for title in titles]

# 输出标题和链接

for i in range(len(titles)):

print("标题:", titles[i].text.strip())

print("链接:", links[i])

print()

代码解析

- 我们首先导入了

requests和BeautifulSoup库。 - 定义了要爬取的网页地址。

- 使用

requests.get()方法发送HTTP请求,获取页面的响应内容。 - 通过

BeautifulSoup将页面内容解析成一个HTML文档对象。 - 使用

find_all()方法找到页面中所有的标题,指定了标题的标签为<h2>,并且指定了它们的类名为post-title。 - 通过循环遍历每个标题,提取出标题文本和对应的链接。

- 最后输出标题和链接。

示例:提取网页中的图片链接和保存图片

在这个示例中,我们将学习如何从网页中提取图片链接,并将图片保存到本地文件系统中。

import os

import requests

from bs4 import BeautifulSoup

# 定义要爬取的网页地址

url = 'https://xxxx/gallery'

# 发送HTTP请求获取页面内容

response = requests.get(url)

# 使用Beautiful Soup解析页面内容

soup = BeautifulSoup(response.text, 'html.parser')

# 找到所有的图片链接

image_links = [img['src'] for img in soup.find_all('img')]

# 创建保存图片的文件夹

if not os.path.exists('images'):

os.makedirs('images')

# 下载图片并保存到本地

for i, link in enumerate(image_links):

image_name = f'image_{i}.jpg'

image_path = os.path.join('images', image_name)

with open(image_path, 'wb') as f:

img_data = requests.get(link).content

f.write(img_data)

print(f"图片 '{image_name}' 已保存。")

代码解析

- 我们继续导入

requests和BeautifulSoup库,以及Python的os模块。 - 定义了要爬取的网页地址。

- 发送HTTP请求并获取页面的响应内容。

- 使用

BeautifulSoup解析页面内容。 - 使用

find_all()方法找到页面中所有的图片标签,并提取出它们的src属性,即图片链接。 - 检查本地是否存在用于保存图片的文件夹,如果不存在则创建它。

- 使用循环遍历所有的图片链接,下载图片并保存到本地文件系统中。我们使用了

enumerate()函数来同时获取图片的索引和链接。 - 每次下载完成后,打印出图片的保存信息。

示例:爬取动态加载的内容

有时,网页中的内容可能是通过 JavaScript 动态加载的,这时候我们不能简单地通过静态页面的解析来获取内容。我们需要使用更高级的技术,例如模拟浏览器行为或使用 AJAX 请求来获取动态内容。下面是一个示例,演示如何使用 Selenium 库来爬取动态加载的内容。

首先,确保你已经安装了 Selenium 库。你可以使用下面的命令进行安装:

pip install selenium

然后,下载并安装相应浏览器的 WebDriver。你可以从浏览器官方网站下载,例如 Chrome 的 WebDriver 可以从 Chrome WebDriver 获取。

下面是一个示例代码,演示了如何使用 Selenium 来爬取动态加载的内容:

from selenium import webdriver

from selenium.webdriver.chrome.service import Service

from selenium.webdriver.common.by import By

from selenium.webdriver.common.keys import Keys

from selenium.webdriver.chrome.options import Options

import time

# 设置 Chrome WebDriver 的路径

webdriver_path = '/path/to/chromedriver'

# 创建 Chrome WebDriver

service = Service(webdriver_path)

chrome_options = Options()

chrome_options.add_argument("--headless") # 无头模式,不打开浏览器界面

driver = webdriver.Chrome(service=service, options=chrome_options)

# 加载页面

driver.get("https://xxxx/dynamic-content")

# 模拟滚动浏览器窗口,触发动态加载

for i in range(5):

driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

time.sleep(2) # 等待页面加载

# 提取动态加载的内容

elements = driver.find_elements(By.XPATH, "//div[@class='dynamic-content']")

for element in elements:

print(element.text)

# 关闭 WebDriver

driver.quit()

代码解析

- 我们导入了

webdriver模块以及一些相关的类和方法。 - 设置了 Chrome WebDriver 的路径,创建了 Chrome WebDriver 实例。

- 使用

get()方法加载目标网页。 - 使用

execute_script()方法模拟滚动浏览器窗口,触发动态加载内容的加载。 - 使用

find_elements()方法通过 XPath 查找动态加载的内容元素。 - 遍历找到的元素并输出它们的文本内容。

- 最后关闭 WebDriver。

示例:处理登录认证

有些网站需要用户登录后才能访问某些页面或获取某些内容。下面是一个示例,演示了如何使用 Selenium 模拟登录认证,然后爬取登录后的内容。

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.common.keys import Keys

# 设置 Chrome WebDriver 的路径

webdriver_path = '/path/to/chromedriver'

# 创建 Chrome WebDriver

driver = webdriver.Chrome(webdriver_path)

# 加载登录页面

driver.get("https://xxxx/login")

# 找到用户名和密码输入框,并输入登录信息

username_field = driver.find_element(By.ID, "username")

password_field = driver.find_element(By.ID, "password")

username_field.send_keys("your_username")

password_field.send_keys("your_password")

# 找到登录按钮并点击

login_button = driver.find_element(By.XPATH, "//button[@type='submit']")

login_button.click()

# 登录成功后,等待一段时间,确保页面加载完成

driver.implicitly_wait(10) # 等待时间可以根据实际情况调整。在这里,我们等待了 10 秒钟,以确保页面加载完成。你也可以根据实际情况调整等待时间。

一旦登录成功并且页面加载完成,你就可以开始爬取登录后的内容了。以下是一个简单的示例,演示了如何查找登录后页面中的某些元素并提取它们的文本内容:

# 爬取登录后页面的内容

welcome_message = driver.find_element(By.XPATH, "//h1[contains(text(), 'Welcome')]").text

user_info = driver.find_element(By.XPATH, "//div[@class='user-info']").text

print("欢迎信息:", welcome_message)

print("用户信息:", user_info)

# 关闭 WebDriver

driver.quit()

代码解析

- 使用

find_element()方法查找用户名和密码输入框,并使用send_keys()方法输入登录信息。 - 使用

find_element()方法找到登录按钮,并使用click()方法点击按钮进行登录。 - 使用

implicitly_wait()方法等待一段时间,确保页面加载完成。 - 使用

find_element()方法查找登录后页面中的元素,并提取它们的文本内容。 - 输出提取到的内容。

- 最后关闭 WebDriver。

在前面的示例中,我们使用了硬编码的方式来输入用户名和密码。然而,在实际情况中,我们可能需要更安全和更灵活的方法来处理用户凭据。下面是一个示例,演示了如何使用 getpass 模块来安全地输入密码,并且如何从外部文件中读取凭据信息。

首先,确保你已经安装了 getpass 模块:

pip install getpass

然后,假设我们有一个外部文件 credentials.txt,其中包含用户名和密码,格式如下:

username: your_username

password: your_password

以下是相应的代码示例:

from selenium import webdriver

from selenium.webdriver.common.by import By

from getpass import getpass

# 设置 Chrome WebDriver 的路径

webdriver_path = '/path/to/chromedriver'

# 创建 Chrome WebDriver

driver = webdriver.Chrome(webdriver_path)

# 加载登录页面

driver.get("https://xxx/login")

# 从外部文件读取用户名和密码

with open("credentials.txt", "r") as file:

lines = file.readlines()

username = lines[0].strip().split(": ")[1]

password = lines[1].strip().split(": ")[1]

# 输入用户名

username_field = driver.find_element(By.ID, "username")

username_field.send_keys(username)

# 输入密码(安全方式)

password = getpass("请输入密码:")

password_field = driver.find_element(By.ID, "password")

password_field.send_keys(password)

# 找到登录按钮并点击

login_button = driver.find_element(By.XPATH, "//button[@type='submit']")

login_button.click()

# 登录成功后,等待一段时间,确保页面加载完成

driver.implicitly_wait(10)

# 爬取登录后页面的内容

welcome_message = driver.find_element(By.XPATH, "//h1[contains(text(), 'Welcome')]").text

user_info = driver.find_element(By.XPATH, "//div[@class='user-info']").text

print("欢迎信息:", welcome_message)

print("用户信息:", user_info)

# 关闭 WebDriver

driver.quit()

代码解析

- 使用

getpass()函数安全地输入密码,这样密码不会在控制台中显示出来。 - 使用文件读取操作从外部文件中读取用户名和密码,这样可以将凭据信息存储在安全的地方,避免了硬编码的方式。

总结:

在本文中,我们介绍了如何使用 Python 中的 Requests 和 Beautiful Soup 库以及 Selenium 模块来创建网络爬虫,并展示了不同场景下的实际应用。

首先,我们使用 Requests 和 Beautiful Soup 演示了如何从静态网页中提取信息,包括文本内容、链接和图片链接。这使得我们能够快速、有效地从网页中获取所需的数据。

接着,我们展示了如何使用 Selenium 模拟登录认证并爬取登录后的内容。登录认证是访问某些网站或页面所必需的操作之一,而使用 Selenium 可以模拟用户的真实操作,从而实现登录认证并获取登录后页面的内容。

最后,我们介绍了如何安全地处理用户凭据,包括使用 getpass 模块安全输入密码以及从外部文件中读取用户名和密码。这样的做法使得我们的代码更加安全和灵活,有效地保护用户的隐私信息。文章来源:https://www.toymoban.com/news/detail-840712.html

通过本文的学习,读者可以掌握使用 Python 进行网络爬虫的基本原理和方法,并且了解如何处理一些常见的爬虫场景,如静态网页数据提取、动态加载内容和登录认证等。同时,我们也强调了在进行网络爬虫时需要遵守相关的法律法规和网站的使用规则,以避免侵犯他人的权益。文章来源地址https://www.toymoban.com/news/detail-840712.html

到了这里,关于利用Python进行网络爬虫:Beautiful Soup和Requests的应用【第131篇—Beautiful Soup】的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!