尽管基于点云的3D目标检测算法性能不断提升,在KITTI和Nuscenes等榜单上碾压视觉方案。但是激光雷达相对高昂的造价和对各种复杂天气情况的敏感性限制激光雷达的应用范围,使得研究人员更多的探索基于视觉的3D检测。

纯视觉的3D检测输入一般是单目图像或多目图像,只需要安装摄像头,标定相对简单,适合大规模的商业部署。而且,图像包含丰富的场景的颜色和纹理信息,有利于模型的检测和分类。目前量产方案中,像地平线,Mobileye和stradvision都是基于视觉的3D感知方案,而单目方案由于价格更具有优势,被广泛量产于各类车辆的L2~L4方案上。

纯视觉3D的学习路线

当前纯视觉3D方案主要包括多目BEV方案和单目3D/BEV方案。通常认为,视觉3D检测的发展路径是:2D车轮检测+地平假设->单目3D检测->BEV检测和occupancy检测。

如果想要更全面学习和理解纯视觉3D检测,需要认真将整个流程走一遍。

-

2D车轮检测+地平假设,需要了解成熟的2D检测器,faster rcnn和CenterNet等,以及图像坐标系到相机坐标系再到车身坐标系的转换。

-

单目3D检测,需要学习CenterNet3D,FCOS3D和DD3D等单目3D检测算法,单目3D的核心是如何通过相机的几何投影模型和3D投影点等先验,得到准确深度估计。另外,像DD3D等算法,借助lidar数据预训练使得模型具有深度感知能力。

-

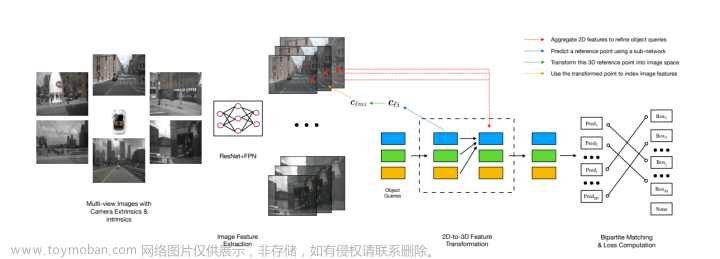

单目BEV检测,需要学习PETR,BEVDET和CaDNN等算法,学习如何把2D特征3D化,像CaDDN和BEVDET是借助深度估计网络。而PETR和BEVFormer是借助transformer来隐式做特征转换。

-

单目Occupancy检测。需要学习VoxFormer, FB-OCC和MonoNeRD等算法。Occupancy模型输出3D空间的每个网格是否被占用。由于是在3D空间做运算,计算量大,如何设计轻量化的Occupancy网络值得研究。另外,现在的occupancy的标签是通过高线速的激光雷达,通过多帧叠加生成的,难以大规模商用,如何生成Occupancy的监督信号也是值得研究,像利用NeRF的3D重建来给Occupancy提供监督信号也是很好的方法。

由于涉及的内容较多,时间线较长,即使是已经有工作年限的同学,也很少能够完整的走一遍,更别说未有工作经验的同学。

如何学习?

针对领域主流的单目3D,单目BEV和单目Occupancy算法,我们自研了一套同时面向工程界和学术界的教程,针对目前常用的大模型自动标注、点云模型蒸馏视觉3D模型、CaDDN+BEVDet单目BEV方案、PETR单目BEV方案、单目Occupancy方案OccupancyM3D等展开详细介绍。

重点关注应用上的难点,同时也介绍了目前大火的BEV自动标注方案,真正能够带大家从0到1梳理清楚视觉3D方案的路线及核心内容点,最适合工作上需要进阶的同学以及刚入门的小白,大纲如下:

主讲老师

Wind, 就职于某头部自动驾驶公司,6年感知算法经验,主要关注视觉3D检测相关研发工作,致力于纯视觉3D感知和NeRF的学习和研究。曾在KITTI和Nuscenes上获得3D检测任务第一名,并在AAAI和WACV等顶会上发表论文多篇。

需要具备的基础

-

具有一定的python和pyTorch基础,熟悉深度学习常用的一些基础算法;

-

对BEV感知和单目3D、Occupancy的应用和基础方案有一定了解;

-

一定的线性代数和矩阵论基础;

-

电脑需要自带GPU,能够通过CUDA加速(显存至少6GB);

学后收获

-

对量产级的单目3D方案有着深入理解,在数据标注、模型设计和优化上有较大提升;

-

熟悉自动驾驶感知算法与方案的发展路线,从更高的角度上看待整个行业;

-

能够精通自动驾驶通用算法,理论实践并重,无论是学术界抑或工业界都能直接复用;

-

学完本课程能够达到1年左右的视觉3D感知算法工程师的水平;

-

能够结识许多行业从业人员与学习合作伙伴!

开课时间与学习方式

历经两个月,离线视频授课。主讲老师在微信学习群内答疑,对课程中的算法、代码、环境配置等问题一一解惑!

课程咨询

扫码学习课程

扫码添加小助理咨询课程!文章来源:https://www.toymoban.com/news/detail-841546.html

(微信:AIDriver004)文章来源地址https://www.toymoban.com/news/detail-841546.html

到了这里,关于纯视觉都有哪些量产方案?单目3D感知在自动驾驶中的应用一览(3D检测/BEV/占用网络)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[工业3D] 主流的3D光学视觉方案及原理](https://imgs.yssmx.com/Uploads/2024/02/593202-1.png)