目录

前言

案例背景

案例实现

案例总结

结语

前言

作者简介: 懒大王敲代码,计算机专业应届生

今天给大家聊聊爬虫技术实战案例解析,希望大家能觉得实用!

欢迎大家点赞 👍 收藏 ⭐ 加关注哦!💖💖个人主页:

懒大王敲代码-CSDN博客https://blog.csdn.net/weixin_58070962?type=blog

其他专栏:

技术分享专栏java专栏ubantu与C语言学习专栏vue3项目实战专栏内网穿透专栏懒大王闲谈专栏

在当今信息化社会,网络爬虫技术以其强大的数据抓取能力,在各行各业得到了广泛应用。无论是商业智能分析、竞争对手监测,还是学术研究、数据挖掘,爬虫技术都发挥着不可或缺的作用。本文将通过一个具体的爬虫实战案例,深入剖析爬虫技术的实现过程,并结合代码案例进行详细讲解。

案例背景

假设我们是一家电商公司的数据分析团队,需要对竞争对手的商品价格、销量等信息进行持续监控。为了实现这一目标,我们决定采用爬虫技术,自动抓取竞争对手网站上的商品数据。

案例实现

- 目标网站分析

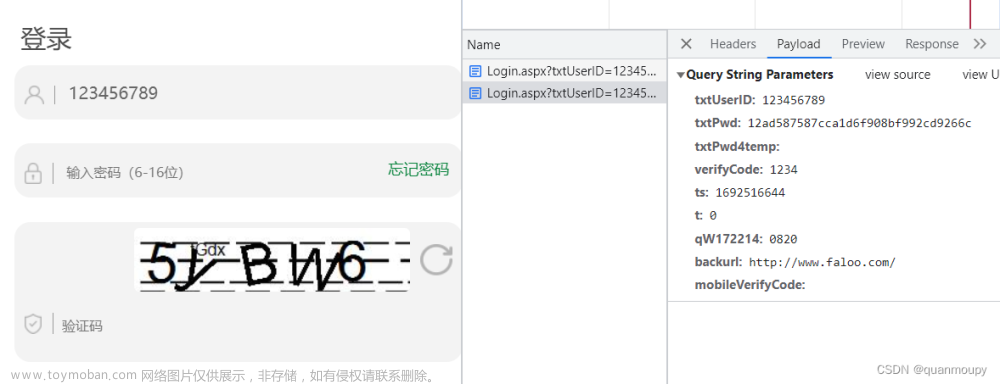

在开始编写爬虫之前,我们需要对目标网站进行分析,确定其网页结构、数据格式以及反爬虫机制等。通过浏览目标网站的商品页面,我们发现商品信息主要包含在HTML标签中,且页面采用了Ajax动态加载的方式。此外,网站还设置了访问频率限制和验证码验证等反爬虫机制。

- 爬虫框架选择

考虑到目标网站的复杂性和反爬虫机制,我们选择使用Scrapy框架来构建我们的爬虫。Scrapy是一个快速、高层次的屏幕抓取和web抓取框架,用于抓取web站点并从页面中提取结构化的数据。Scrapy用途广泛,可以用于数据挖掘、监测和自动化测试,信息处理和历史档案等大量应用。

- 编写爬虫代码

(1)创建Scrapy项目

首先,我们需要使用Scrapy命令行工具创建一个新的Scrapy项目。在终端中执行以下命令:

bash

scrapy startproject myspider

cd myspider(2)定义爬虫结构

在myspider项目的spiders目录下,创建一个新的Python文件,如competitor_spider.py,用于定义我们的爬虫。在该文件中,我们需要导入必要的模块,并定义一个继承自scrapy.Spider的爬虫类。

python

import scrapy

from scrapy.http import FormRequest

from myspider.items import CompetitorItem

class CompetitorSpider(scrapy.Spider):

name = 'competitor'

allowed_domains = ['competitor.com']

start_urls = ['http://competitor.com/products']

def parse(self, response):

# 解析商品列表页面,提取商品链接

product_links = response.css('a.product-link::attr(href)').getall()

for link in product_links:

yield scrapy.Request(url=response.urljoin(link), callback=self.parse_product)

def parse_product(self, response):

# 解析商品详情页面,提取商品信息

item = CompetitorItem()

item['name'] = response.css('h1.product-name::text').get()

item['price'] = response.css('span.product-price::text').get()

item['sales'] = response.css('span.product-sales::text').get()

yield item在上面的代码中,我们定义了一个名为CompetitorSpider的爬虫类。在parse方法中,我们解析商品列表页面,提取出每个商品的链接,并发送请求到这些链接对应的商品详情页面。在parse_product方法中,我们解析商品详情页面,提取出商品的名称、价格和销量等信息,并将其保存到一个CompetitorItem对象中。

(3)处理反爬虫机制

针对目标网站的反爬虫机制,我们需要采取一些措施来绕过这些限制。例如,我们可以设置合理的请求间隔,避免过于频繁的访问;对于验证码验证,我们可以使用图像识别技术来自动填写验证码;对于Ajax动态加载的内容,我们可以使用Scrapy的FormRequest或Selenium等工具来模拟浏览器行为,触发Ajax请求并获取数据。

在本案例中,我们假设目标网站设置了访问频率限制。为了遵守这一限制,我们可以在Scrapy的设置文件中设置DOWNLOAD_DELAY参数来控制请求间隔。此外,我们还可以使用Scrapy的AutoThrottle扩展来自动调整请求间隔,以适应目标网站的负载情况。

(4)运行爬虫并保存数据

完成爬虫代码编写后,我们可以使用Scrapy命令行工具来运行爬虫并保存数据。在终端中执行以下命令:

bash

scrapy crawl competitor -o output.csv上述命令将启动名为competitor的爬虫,并将抓取到的数据保存为CSV格式的文件output.csv。当然,Scrapy还支持将数据保存为其他格式,如JSON、XML等,具体可以根据需求进行设置。

案例总结

通过本案例的实战演练,我们深入了解了爬虫技术的实现过程,包括目标网站分析、爬虫框架选择、代码编写以及反爬虫。

结语

关于爬虫技术实战案例解析,懒大王就先分享到这里了,如果你认为这篇文章对你有帮助,请给懒大王点个赞点个关注吧,如果发现什么问题,欢迎评论区留言!!💕💕

个人主页:

懒大王敲代码-CSDN博客https://blog.csdn.net/weixin_58070962?type=blog

其他专栏

技术分享专栏java专栏ubantu与C语言学习专栏文章来源:https://www.toymoban.com/news/detail-841557.html

文章来源地址https://www.toymoban.com/news/detail-841557.html

文章来源地址https://www.toymoban.com/news/detail-841557.html

到了这里,关于爬虫技术实战案例解析的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!