一、论文概述

本文主要内容是关于在强化学习中应用扩散模型的综述。文章首先介绍了强化学习面临的挑战,以及扩散模型如何解决这些挑战。接着介绍了扩散模型的基础知识和在强化学习中的应用方法。然后讨论了扩散模型在强化学习中的不同角色,并对其在多个应用领域的贡献进行了探讨。最后总结了目前的研究方向和未来的发展趋势。

二、内容

绪论:这篇调查论文主要关注在强化学习(RL)中应用扩散模型的研究。这类模型具有较强的生成高质量样本和训练稳定性能,已在多个领域取得显著成功。

强化学习的挑战:本节列出了四个在RL算法中的挑战,并简要讨论了扩散模型如何解决这些挑战。

- 受限的表达能力:扩散模型具有强大的建模能力,可以表示任何可规范分布,从而有效地提高策略限制和RvS算法在复杂数据集上的性能。

- 数据稀缺性:扩散模型可以作为RL数据集的自然数据合成器,因为数据稀缺性是实际问题。通过从整个数据集D_real中学习数据分布ρ_θ(τ),扩散模型可以生成具有环境动态一致性的多样化和一致的合成数据。

- 累积误差:扩散模型在规划多个时间步长时具有更好的时间一致性,从而减少了累积误差。

- 多任务泛化:扩散模型可以处理多任务数据集中的多模态分布,并通过估计任务分布适应新任务。这使得扩散模型在多任务RL中具有更好的泛化能力。

扩散模型基础:这部分讨论了扩散模型的基础知识,以及在RL相关应用中特别重要的两类方法:引导采样和快速采样。

引导采样方法

引导采样方法主要有两种类型:分类器引导和分类器自由引导。

- 分类器引导:这种方法依赖于预先训练好的分类器来指导采样过程。在采样过程中,分类器的输出概率被用于计算条件分布,从而生成具有特定属性的样本。

- 分类器自由引导:这种方法不依赖于分类器,而是直接通过调整条件噪声模型来控制生成样本的属性。实践中,这种方法通过在训练时共享相同的参数集来实现条件和无条件模型。

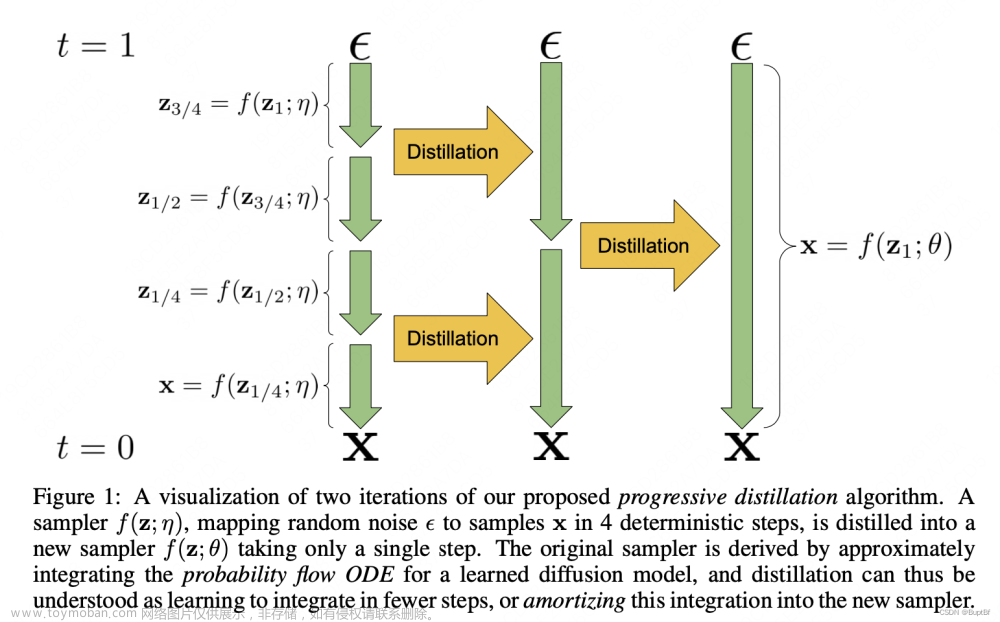

快速采样方法

快速采样方法主要可以分为两类:不涉及学习的方法和需要额外学习的方法。

- 不涉及学习的方法:这些方法通过改进扩散模型的采样过程,以加速迭代过程。一个典型的实例是DDIM(Denoising Diffusion Implicit Models),它通过学习另一个马尔可夫链来加速采样过程。

- 需要额外学习的方法:这些方法通过预先训练一个生成模型来加速采样过程。生成模型可以在训练过程中学习目标数据分布,从而在较短的时间内生成高质量的样本。

强化学习中的扩散模型角色:本节讨论了扩散模型在现有工作中的作用,主要分为计划器(规划器)、策略和数据合成器三类。

- 规划器:

规划器在强化学习中主要用于生成轨迹,通过引导采样技术在动作空间进行规划。在此过程中,扩散模型负责生成轨迹,而引导采样方法则确保这些轨迹符合期望的奖励。计划器可以用于模拟环境中的多步决策过程,以生成高质量的轨迹。

- 策略:

策略在强化学习中主要用于决策,即根据当前状态选择合适的动作。使用扩散模型作为策略的一种方法是通过将其与Q学习框架相结合。这种方法可以解决现有离线策略学习方法中的过度保守性和缺乏表达能力的问题。

- 数据合成器:

数据合成器用于生成合成数据,以增加训练集的规模和覆盖范围。在强化学习中,扩散模型可以用作数据合成器,通过从学习到的数据分布中生成合成数据,从而提高策略学习的效率和效果。这种方法可以有效地解决数据稀缺问题,特别是在高维状态空间和复杂交互模式的环境中。

应用:本节对现有研究进行了全面回顾,将它们分为五组,依据它们应用的任务:离线RL、在线RL、模仿学习、轨迹生成和数据增强。

- 离线RL:

离线强化学习(Offline RL)从预先收集的数据集中学习最优策略,而无需进行在线交互。这可以显著提高样本效率,但面临分布偏移问题。通过使用扩散模型,可以生成逼真的轨迹,从而改善离线RL中的策略限制。

- 在线RL:

在线强化学习(Online RL)通过与环境互动来学习最优策略。虽然在线RL可以实现实时优化,但它可能受到低样本效率的限制。一些研究表明,扩散模型可以加速在线RL训练,提高策略性能。

- 模仿学习:

模仿学习(Imitation Learning)通过观察专家的示范来学习策略。扩散模型可以在模仿学习中发挥作用,例如通过生成类似于专家行为的轨迹。

- 轨迹生成:

扩散模型可以用于生成逼真的轨迹,这对于规划和决策任务至关重要。通过引导采样技术,扩散模型可以生成高回报的轨迹,从而提高策略性能。

- 数据增强:

数据增强(Data Augmentation)通过对现有数据进行变换来生成新的样本,从而提高样本效率。在强化学习中,扩散模型可以用作数据合成器,生成与环境动态一致的合成数据,从而提高策略训练的效果。文章来源:https://www.toymoban.com/news/detail-841788.html

总结与未来展望:这部分概述了扩散模型在RL领域的研究现状,并提出了一些值得探索的未来研究方向,包括生成模拟、集成安全约束、检索增强生成和组合不同技能。文章来源地址https://www.toymoban.com/news/detail-841788.html

到了这里,关于论文阅读--Diffusion Models for Reinforcement Learning: A Survey的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!