1.安装 kube-state-metrics

1.1下载yaml文件 下载的文件统一放到目录 : /opt

curl -L -O https://raw.githubusercontent.com/gjeanmart/kauri-content/master/spring-boot-simple/k8s/kube-state-metrics.yml

1.2修改配置文件

修改namespace为dev(default也行,但是后面的metricbeat安装也需要修改namespace为default)。

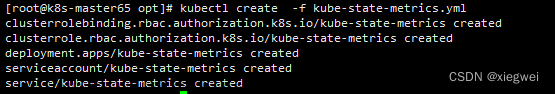

1.3 部署

kubectl create -f kube-state-metrics.yml

2.安装 metricbeat

2.1下载yaml文件

curl -L -O https://raw.githubusercontent.com/elastic/beats/7.6/deploy/kubernetes/metricbeat-kubernetes.yaml

2.2修改配置文件

- namspace修改为dev,跟kube-state-metrics的空间名称保持一致。

- 修改ELASTICSEARCH_HOST连接到es,建议搜索出来,有两处要改的。

当前es并不是cloud,所以cloud配置需要删掉,不然后台会报错。建议搜索出来,避免漏删。

当前es并不是cloud,所以cloud配置需要删掉,不然后台会报错。建议搜索出来,避免漏删。

修改索引的模版名称

文章来源:https://www.toymoban.com/news/detail-845496.html

文章来源:https://www.toymoban.com/news/detail-845496.html

2.3 部署metricbeat 部署完成后可以在仪表盘查看到数据

文章来源地址https://www.toymoban.com/news/detail-845496.html

文章来源地址https://www.toymoban.com/news/detail-845496.html

2.4根据相应的字段,编写Watcher脚本。

到了这里,关于k8s集群pod和node状态监控的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!