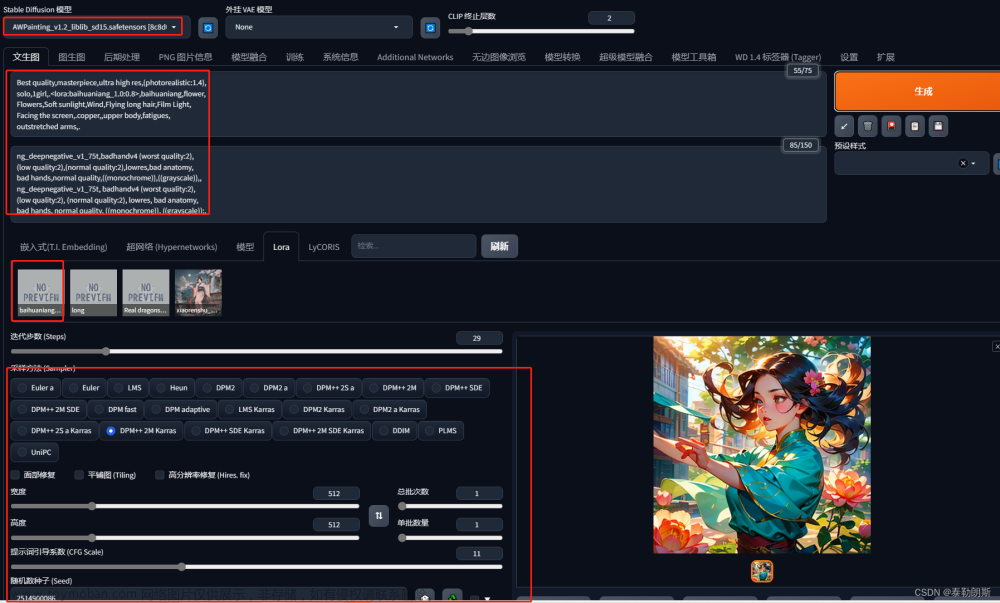

Stable Diffusion作为一款强大的文本到图像生成模型,其界面参数是用户与模型进行交互的重要桥梁。这些参数不仅影响着模型的生成效果,还能够帮助用户更加精准地控制生成图像的风格、内容等。本文将详细介绍Stable Diffusion的界面参数,帮助用户更好地理解和应用这一工具。

一、输入参数

-

文本描述:这是用户输入的主要参数,用于描述想要生成的图像内容。用户可以通过输入关键词、短语或句子来指定图像的主题、风格、色彩等。Stable Diffusion会根据这些描述来生成相应的图像。

-

分辨率:分辨率参数决定了生成图像的尺寸大小。用户可以根据需要选择合适的分辨率,以平衡生成速度和图像质量。较高的分辨率可以生成更精细的图像,但也会增加计算资源和时间成本。

-

随机种子:随机种子参数用于控制生成图像的随机性。每次输入相同的文本描述和分辨率,但使用不同的随机种子,都会得到不同的生成结果。这为用户提供了更多的创作可能性和探索空间。

二、输出参数

-

生成图像:Stable Diffusion根据用户输入的参数生成图像,并在界面上展示。用户可以直接查看和保存生成的图像,也可以进一步编辑和处理。

-

生成时间:界面上还会显示生成图像所需的时间,帮助用户了解模型的处理速度和性能。

三、高级参数

除了基本的输入和输出参数外,Stable Diffusion还提供了一些高级参数,供用户进行更精细的控制和调整。

-

采样步数:采样步数参数决定了模型在生成图像时的迭代次数。增加采样步数可以使生成的图像更加平滑和细腻,但也会增加计算时间和资源消耗。文章来源:https://www.toymoban.com/news/detail-846774.html

-

截断阈值:截断阈值文章来源地址https://www.toymoban.com/news/detail-846774.html

到了这里,关于Stable Diffusion的界面参数详解的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!