OpenAI 发布的人工智能文生视频大模型Sora在2024年2月15日亮相并引发热议,我们了解到 Sora 不仅完美继承了 DALL·E 3的卓越画质和遵循指令能力,更进一步利用 GPT 扩写技术,展现出超长生成时间(60s)、单视频多角度镜头以及理解物理世界三大突出优势。我们可以看到从 Runway、Pika 到 Sora,文生视频大模型的技术在不断进步。从最初的表情包长度3s、4s,到如今主流短视频长度的60s,模型的生成内容越来越丰富多样。网络上对Sora的解读文章非常多,本文会尝试对Sora做一份"浅显易懂"的科普解读分享。

一、灵活处理不同分辨率视频数据

Sora视频生成模型能够根据文字描述生成逼真视频,其核心在于从大量视频数据中"学习"生成视频的技能。然而,训练数据中的视频长短分辨率参差不齐,如何高效地处理这些多样化数据,是Sora面临的第一个技术难题。

传统的视频处理方式要求输入视频保持相同的分辨率和大小,这在很大程度上限制了训练数据的丰富度。而Sora则采用了一些巧妙的技术手段,可以灵活处理不同格式的视频数据:

(1)处理不同长度视频:

对较短视频,重复采样拉长画面长度

对较长视频,智能识别并丢弃相似冗余的画面块,缩短总长度

将所有视频特征压缩塞进固定大小的"数据包"中

(2)处理不同分辨率视频:

通过插值和缩放技术,统一所有画面至同一分辨率

在训练时,Sora还可根据每个视频的具体情况动态调整批处理大小,并引入"稀疏注意力机制",让模型集中关注视频中的关键区域和动作,从而提高了注意力资源的利用效率。通过上述方法,Sora可高效处理各种多样化的视频数据,为后续的训练和生成奠定基础。

二、生成高质量视频的核心机制

Sora视频生成模型的核心技术源自一种创新架构——Diffusion Transformers(DiT)。DiT融合了变分自动编码器(VAE)、视觉转换器(ViT)和扩散去噪概率模型(DDPM)三者的优势,实现了端到端的视频生成。

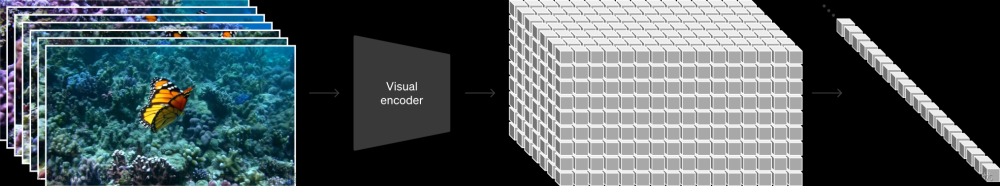

整个生成过程可以简单概括为:先让清晰视频变模糊,再让模型学会如何还原。具体来说,VAE编码器首先获取原始清晰视频的压缩表示,然后对这个表示进行"前向扩散",也就是人为添加噪声,让它变得模糊不清。

接下来就是模型需要"学习"的关键一步了。将加了噪声的模糊表示切分成一个个小块,输入到ViT模型中去。ViT的任务就是通过学习,掌握如何从这些小块的噪声信号中还原出干净的视频画面。推理时,则按相反过程操作。ViT模型逐步减少噪声,直到获得比较干净的视频压缩表示,最后由VAE解码器将其生成为最终视频输出。这个过程有点类似给孩子们出"反向"脑筋急转弯,先让他们了解"清晰视频是如何变模糊的",从而学会"如何从模糊中还原清晰"。

Sora并非是全新设计的,借鉴了谷歌Imagen Video模型的成果。Imagen Video可以把一段文字描述转化为机器可理解的语义表示,深入把握文字主题、情感和意图等要素。接下来,Sora应该参考了多伦多大学的Video LDM模型的做法。Video LDM先生成视频的关键帧,比如开始、结束和转折等重要时刻。然后引入"时间层"分析相邻帧之间的联系,插值生成新的中间帧,最终将所有关键帧和新生成帧串联成完整流畅的视频。通过上述创新技术,Sora实现了根据文字描述生成高质量视频的能力,而且处理能力更加通用灵活。

三、对Sora参数量和算力需求的猜测

尽管Sora能生成出高质量逼真的视频,但其模型参数量可能仅有30亿左右,远远低于公众的预期。这意味着相比其他大型人工智能模型,Sora的训练和推理过程将更加节省算力,未来的迭代升级也将更加便捷高效。

那么,Sora是如何在相对精简的参数量下实现卓越性能的呢?这与它所借鉴的DiT(Diffusion Transformers)架构息息相关。

DiT架构有两个主要规模版本,分别是中等的B/2版和大型的XL版,其中XL版参数量为10亿。根据OpenAI的技术报告,Sora模型的初级版本质量很差,推测当时采用的是B/2版本。而最终版的Sora质量则比初级版提升了16倍。

我们知道,一个模型的计算复杂度通常与其参数规模成正比。如果Sora最终版本的计算量也提升了16倍,而且考虑到DiT XL版本相比B/2版本的计算复杂度提升了12倍,那么我们可以粗略估计,Sora最终版本的计算复杂度约为DiT XL的16/12=1.33倍。

由于计算复杂度与参数规模正相关,我们可以进一步推测,Sora最终版本的参数量大约在10亿到20亿之间。当然,OpenAI团队肯定还对Sora做了其他改进,因此最终给出的参数量是30亿左右。

四、广泛多样的训练数据

除了创新的模型架构,Sora取得卓越表现的另一个重要原因,在于它使用了高质量且种类丰富多样的训练数据。据了解,Sora的训练数据包括:

(1)游戏引擎数据,这些数据通过建模模拟,能够较为真实地再现现实世界的物理规律。它们有助于提高Sora生成视频的逻辑性和一致性,避免出现违反常理的画面。

(2)合成数据和重构数据,合成数据是通过计算机渲染生成的,重构数据则是对现有视频进行加工处理而来。这两种数据的优点是可以按需定制,扩充训练集的多样性,提升视频生成的质量和多样性。

(3)纪录片、长镜头视频等,这类数据来源于真实拍摄,能够很好地捕捉场景和动作细节,有助于Sora更好地学习和理解真实世界中的运动规律和场景特征。

正是由于训练数据的特殊组合以及极高的质量,Sora才得以汲取生成逼真视频所需的各种"知识"。高质量的数据源是人工智能模型取得卓越表现的重要基础之一。

五、新型SiT模型有望带来突破

DiT架构的原作者团队最近发布了一种改进的SiT(Sequence Iterative Transformer)模型。SiT在保持DiT架构的同时,提供了更优的性能和收敛速度,值得关注。

Sora的出现,标志着基于扩散模型的视频生成技术迈入了一个新的里程碑。 借助创新的DiT架构、高质量多样的训练数据,以及强大的文本理解能力,Sora不仅能根据文字描述生成逼真视频,而且生成质量和处理能力都达到了一个全新的高度。 这一突破性进展,必将为视频生成AI在多媒体创作、虚拟现实等领域的应用铺平道路,催生更多革命性创新。 我们可以期待,在不久的将来,创作者无需复杂的拍摄制作,只需简单输入一段文字,就能"变戏法"般生成出栩栩如生的视频作品。 虚拟现实体验也将因此更加身临其境、无遮无拦。 甚至在VideoGame等游戏领域,玩家的任何随心所欲设想,都可能被实时渲染为超写实的影像场景。文章来源:https://www.toymoban.com/news/detail-849335.html

视频生成AI所带来的无限想象力和创造力,只有亲身体验才能体会。而Sora这一开路先锋,无疑为我们拨开了通往未来的新视野。让我们拭目以待,期待视频生成AI带来下一个"酷改变"。文章来源地址https://www.toymoban.com/news/detail-849335.html

到了这里,关于科普的理解 Sora 视频生成模型的核心技术的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!