目录

一、CART决策树算法简介

二、基尼系数

三、决策树的生成

一、CART决策树算法简介

CART(Classification And Regression Trees 分类回归树)算法是一种树构建算法,既可以用于分类任务,又可以用于回归。相比于 ID3 和 C4.5 只能用于离散型数据且只能用于分类任务,CART 算法的适用面要广得多,既可用于离散型数据,又可以处理连续型数据,并且分类和回归任务都能处理。

本文仅讨论基本的CART分类决策树构建,不讨论回归树和剪枝等问题

首先,我们要明确以下几点:

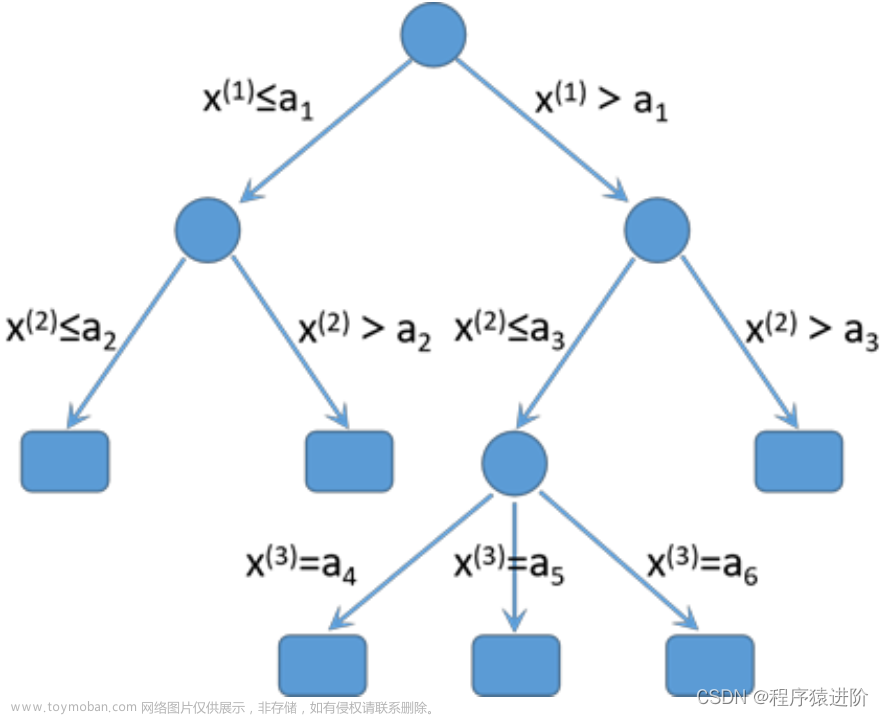

1. CART算法是二分类常用的方法,由CART算法生成的决策树是二叉树,而 ID3 以及 C4.5 算法生成的决策树是多叉树,从运行效率角度考虑,二叉树模型会比多叉树运算效率高。

2. CART算法通过基尼(Gini)指数来选择最优特征。

二、基尼系数

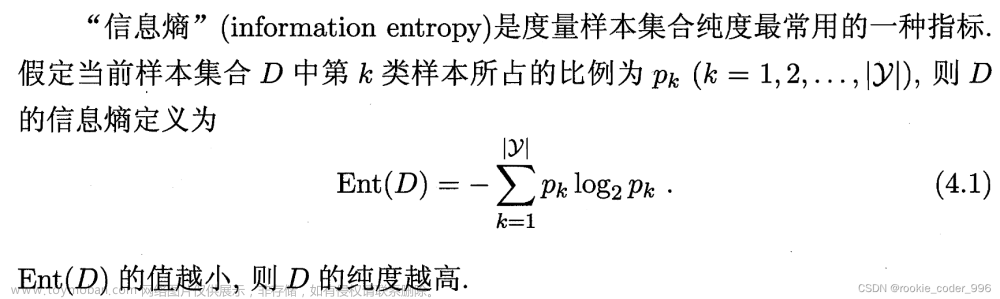

基尼系数代表模型的不纯度,基尼系数越小,则不纯度越低,注意这和 C4.5的信息增益比的定义恰好相反。

分类问题中,假设有K个类,样本点属于第k类的概率为pk,则概率分布的基尼系数定义为:

若CART用于二类分类问题(不是只能用于二分类),那么概率分布的基尼系数可简化为:

假设使用特征 A 将数据集 D 划分为两部分 D1 和 D2,此时按照特征 A 划分的数据集的基尼系为:

三、决策树的生成

实例:下表为数据集,应用CART算法生成决策树。

计算各特征对数据集D的信息增益,分别以A1,A2,A3,A4表示年龄、有工作、有自己的房子和信贷情况4个特征。以1,2,3表示年龄的值为青年、中年和老年,以1,2表示有工作和有自己的房子的值为是或否,以1,2,3表示信贷情况的值为非常好、好和一般。

- 青年(5 人,2 人贷款)的基尼系数:

- 如果类别是二分类,则基尼系数为:

- 在A1=1的条件下,D的基尼指数为:

- 在A1=2的条件下,D的基尼指数为:

- 在A1=3的条件下,D的基尼指数为:

文章来源:https://www.toymoban.com/news/detail-849591.html

文章来源:https://www.toymoban.com/news/detail-849591.html

总结:由于Gini(D,A1=1)和Gini(D,A1=3)相等,且最小,所以A1=1和A1=3都可以作为A1的最优切分点。文章来源地址https://www.toymoban.com/news/detail-849591.html

到了这里,关于机器学习之——CART决策树算法的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!