1.背景介绍

人工智能(AI)和云计算是当今最热门的技术趋势之一,它们正在驱动着我们的生活、工作和经济发展。随着数据量的增加和计算能力的提高,人工智能技术的发展得到了极大的推动。云计算则为人工智能提供了一个高效、灵活、可扩展的计算平台,使得人工智能技术的应用得以广泛推广。

在本文中,我们将讨论人工智能和云计算在技术变革中的作用,以及它们在云计算中的应用。我们将从以下几个方面进行讨论:

- 背景介绍

- 核心概念与联系

- 核心算法原理和具体操作步骤以及数学模型公式详细讲解

- 具体代码实例和详细解释说明

- 未来发展趋势与挑战

- 附录常见问题与解答

2.核心概念与联系

2.1人工智能(AI)

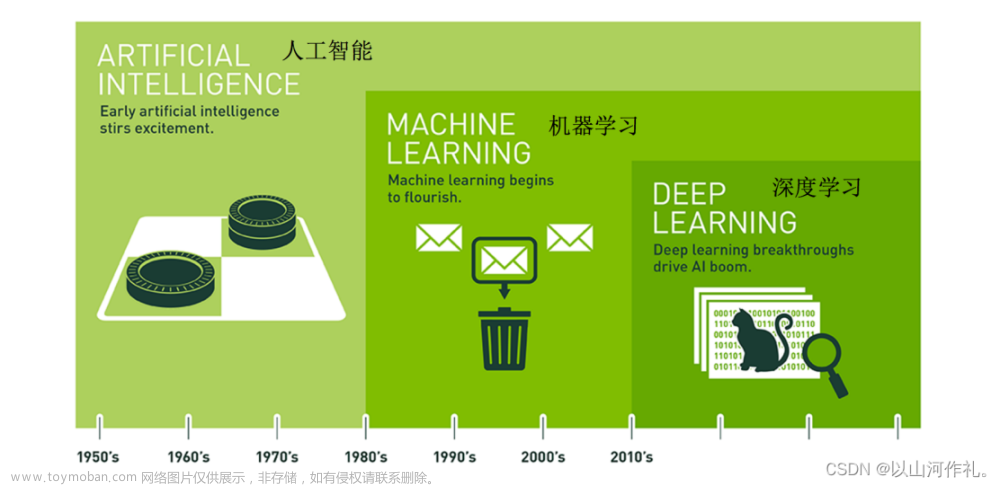

人工智能是一种试图使计算机具有人类智能的技术。人工智能的主要目标是创建一种可以理解自然语言、学习自主思维、进行逻辑推理、感知环境、作出决策等多种高级智能行为的计算机系统。

人工智能可以分为以下几个子领域:

- 机器学习(ML):机器学习是一种使计算机能够从数据中自主学习的技术。它的主要任务是找出数据中的模式,并使这些模式能够用于对未知数据进行预测和分类。

- 深度学习(DL):深度学习是一种特殊类型的机器学习,它使用多层神经网络来模拟人类大脑的工作方式。深度学习已经取得了很大的成功,如图像识别、语音识别、自然语言处理等。

- 自然语言处理(NLP):自然语言处理是一种使计算机能够理解和生成自然语言的技术。自然语言处理的主要任务是文本分类、情感分析、机器翻译等。

- 计算机视觉(CV):计算机视觉是一种使计算机能够从图像和视频中抽取信息的技术。计算机视觉的主要任务是物体识别、场景理解、人脸识别等。

2.2云计算

云计算是一种使用互联网提供计算资源和服务的模式。通过云计算,用户可以在网上购买计算资源,如计算能力、存储空间、软件等,而无需购买和维护自己的硬件和软件。

云计算的主要特点是:

- 分布式:云计算系统由多个计算节点组成,这些节点可以在整个系统中共享资源和负载。

- 虚拟化:云计算使用虚拟化技术,将物理资源分配给虚拟机,从而实现资源的共享和隔离。

- 可扩展:云计算系统可以根据需求动态扩展或缩减资源,以满足不同的应用需求。

- 自动化:云计算系统使用自动化工具和流程,实现资源的管理、监控和维护。

3.核心算法原理和具体操作步骤以及数学模型公式详细讲解

在本节中,我们将详细讲解人工智能中的一些核心算法,包括机器学习、深度学习、自然语言处理和计算机视觉等方面的算法。

3.1机器学习

机器学习是一种使计算机能够从数据中自主学习的技术。它的主要任务是找出数据中的模式,并使这些模式能够用于对未知数据进行预测和分类。

3.1.1线性回归

线性回归是一种简单的机器学习算法,它用于预测连续型变量。线性回归的基本思想是:通过对训练数据中的特征和标签进行线性组合,找到一个最佳的线性模型,使得预测值与实际值之间的差异最小化。

线性回归的数学模型公式为:

$$ y = \theta0 + \theta1x1 + \theta2x2 + \cdots + \thetanx_n + \epsilon $$

其中,$y$ 是预测值,$x1, x2, \cdots, xn$ 是输入特征,$\theta0, \theta1, \theta2, \cdots, \theta_n$ 是模型参数,$\epsilon$ 是误差项。

3.1.2逻辑回归

逻辑回归是一种用于预测二分类变量的机器学习算法。逻辑回归的基本思想是:通过对训练数据中的特征和标签进行线性组合,找到一个最佳的线性模型,使得预测值与实际值之间的差异最小化。

逻辑回归的数学模型公式为:

$$ P(y=1|x) = \frac{1}{1 + e^{-(\theta0 + \theta1x1 + \theta2x2 + \cdots + \thetanx_n)}} $$

其中,$P(y=1|x)$ 是预测值,$x1, x2, \cdots, xn$ 是输入特征,$\theta0, \theta1, \theta2, \cdots, \theta_n$ 是模型参数。

3.1.3支持向量机(SVM)

支持向量机是一种用于解决线性不可分和非线性可分二分类问题的机器学习算法。支持向量机的基本思想是:通过在特征空间中找到一个最大margin的超平面,将不同类别的数据点分开。

支持向量机的数学模型公式为:

$$ \begin{aligned} \min{\theta0, \theta1, \cdots, \thetan} & \quad \frac{1}{2}\theta0^2 + \frac{1}{2}\theta1^2 + \cdots + \frac{1}{2}\thetan^2 \ \text{subject to} & \quad yi(\theta0 + \theta1x{i1} + \theta2x{i2} + \cdots + \thetanx{in}) \geq 1 - \xii, \quad i = 1, 2, \cdots, m \ & \quad \xi_i \geq 0, \quad i = 1, 2, \cdots, m \end{aligned} $$

其中,$yi$ 是标签,$x{i1}, x{i2}, \cdots, x{in}$ 是输入特征,$\theta0, \theta1, \cdots, \thetan$ 是模型参数,$\xii$ 是松弛变量。

3.2深度学习

深度学习是一种特殊类型的机器学习,它使用多层神经网络来模拟人类大脑的工作方式。深度学习已经取得了很大的成功,如图像识别、语音识别、自然语言处理等。

3.2.1卷积神经网络(CNN)

卷积神经网络是一种用于解决图像识别和计算机视觉问题的深度学习算法。卷积神经网络的主要特点是:使用卷积层来提取图像的特征,使用池化层来降维和减少计算量,使用全连接层来进行分类。

3.2.2递归神经网络(RNN)

递归神经网络是一种用于解决序列数据处理问题的深度学习算法。递归神经网络的主要特点是:使用隐藏状态来记录序列之间的关系,使用循环层来处理序列数据。

3.2.3自然语言处理

自然语言处理是一种用于解决自然语言理解和生成问题的深度学习算法。自然语言处理的主要任务是文本分类、情感分析、机器翻译等。

3.3计算机视觉

计算机视觉是一种用于解决图像和视频处理问题的深度学习算法。计算机视觉的主要任务是物体识别、场景理解、人脸识别等。

3.3.1物体识别

物体识别是一种用于识别图像中物体的计算机视觉任务。物体识别的主要方法包括:边缘检测、特征提取、分类等。

3.3.2场景理解

场景理解是一种用于理解图像中的场景和背景的计算机视觉任务。场景理解的主要方法包括:对象检测、关系检测、场景描述等。

3.3.3人脸识别

人脸识别是一种用于识别人脸的计算机视觉任务。人脸识别的主要方法包括:面部特征提取、人脸ALIGNMENT、分类等。

4.具体代码实例和详细解释说明

在本节中,我们将通过具体的代码实例来演示人工智能和云计算在实际应用中的用法。

4.1机器学习

4.1.1线性回归

```python import numpy as np import matplotlib.pyplot as plt

生成数据

np.random.seed(0) x = np.random.rand(100, 1) y = 2 * x + 1 + np.random.rand(100, 1)

初始化参数

theta0 = 0 theta1 = 0 alpha = 0.01

训练模型

for epoch in range(1000): ypred = theta0 + theta1 * x loss = (ypred - y).T.dot(ypred - y) / 2 gradtheta0 = (ypred - y).sum() / 100 gradtheta1 = (ypred - y).dot(x) / 100 theta0 -= alpha * gradtheta0 theta1 -= alpha * gradtheta_1

预测

xtest = np.array([[0.1], [0.2], [0.3], [0.4], [0.5]]) ytest = theta0 + theta1 * x_test

绘图

plt.scatter(x, y) plt.plot(x, y_test, 'r-') plt.show() ```

4.1.2逻辑回归

```python import numpy as np import matplotlib.pyplot as plt

生成数据

np.random.seed(0) x = np.random.rand(100, 1) y = 1 * (x > 0.5) + 0 * (x <= 0.5) + np.random.rand(100, 1)

初始化参数

theta0 = 0 theta1 = 0 alpha = 0.01

训练模型

for epoch in range(1000): ypred = theta0 + theta1 * x loss = (ypred - y).T.dot(ypred - y) / 2 gradtheta0 = (ypred - y).sum() / 100 gradtheta1 = (ypred - y).dot(x) / 100 theta0 -= alpha * gradtheta0 theta1 -= alpha * gradtheta_1

预测

xtest = np.array([[0.1], [0.2], [0.3], [0.4], [0.5]]) ytest = theta0 + theta1 * x_test

绘图

plt.scatter(x, y) plt.plot(x, y_test, 'r-') plt.show() ```

4.1.3支持向量机

```python import numpy as np from sklearn import datasets from sklearn.modelselection import traintest_split from sklearn.preprocessing import StandardScaler from sklearn.svm import SVC

加载数据

iris = datasets.load_iris() X = iris.data y = iris.target

数据预处理

Xtrain, Xtest, ytrain, ytest = traintestsplit(X, y, testsize=0.2, randomstate=42) Xtrain = StandardScaler().fittransform(Xtrain) Xtest = StandardScaler().transform(X_test)

训练模型

svm = SVC(kernel='linear', C=1) svm.fit(Xtrain, ytrain)

预测

ypred = svm.predict(Xtest)

评估

accuracy = svm.score(Xtest, ytest) print(f'Accuracy: {accuracy:.4f}') ```

4.2深度学习

4.2.1卷积神经网络

```python import tensorflow as tf from tensorflow.keras import datasets, layers, models

加载数据

(trainimages, trainlabels), (testimages, testlabels) = datasets.cifar10.load_data()

数据预处理

trainimages, testimages = trainimages / 255.0, testimages / 255.0

构建模型

model = models.Sequential() model.add(layers.Conv2D(32, (3, 3), activation='relu', input_shape=(32, 32, 3))) model.add(layers.MaxPooling2D((2, 2))) model.add(layers.Conv2D(64, (3, 3), activation='relu')) model.add(layers.MaxPooling2D((2, 2))) model.add(layers.Conv2D(64, (3, 3), activation='relu')) model.add(layers.Flatten()) model.add(layers.Dense(64, activation='relu')) model.add(layers.Dense(10, activation='softmax'))

编译模型

model.compile(optimizer='adam', loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True), metrics=['accuracy'])

训练模型

model.fit(trainimages, trainlabels, epochs=10, batchsize=64, validationsplit=0.1)

预测

predictions = model.predict(test_images)

评估

testloss, testacc = model.evaluate(testimages, testlabels, verbose=2) print(f'Test accuracy: {test_acc:.4f}') ```

4.2.2递归神经网络

```python import tensorflow as tf from tensorflow.keras.models import Sequential from tensorflow.keras.layers import LSTM, Dense

生成数据

np.random.seed(0) x = np.random.rand(100, 10, 1) y = np.random.rand(100, 1)

构建模型

model = Sequential() model.add(LSTM(50, activation='relu', input_shape=(10, 1))) model.add(Dense(1))

训练模型

model.compile(optimizer='adam', loss='mse') model.fit(x, y, epochs=100, batch_size=10)

预测

xtest = np.random.rand(1, 10, 1) ytest = model.predict(x_test)

绘图

plt.plot(xtest[0], label='Input') plt.plot(ytest[0], label='Output') plt.legend() plt.show() ```

4.2.3自然语言处理

```python import tensorflow as tf from tensorflow.keras.preprocessing.text import Tokenizer from tensorflow.keras.preprocessing.sequence import pad_sequences from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Embedding, LSTM, Dense

数据

sentences = ['I love machine learning', 'Machine learning is awesome', 'I hate machine learning']

数据预处理

tokenizer = Tokenizer(numwords=1000, oovtoken=' ') tokenizer.fit ontexts(sentences) sequences = tokenizer.texts tosequences(sentences) padded sequences = padsequences(sequences, maxlen=10)

构建模型

model = Sequential() model.add(Embedding(inputdim=1000, outputdim=64, input_length=10)) model.add(LSTM(64)) model.add(Dense(1, activation='sigmoid'))

训练模型

model.compile(optimizer='adam', loss='binarycrossentropy', metrics=['accuracy']) model.fit(paddedsequences, np.array([1, 1, 0]), epochs=10, batch_size=1)

预测

testsentence = 'I love machine learning' testsequence = tokenizer.textstosequences([testsentence]) paddedtestsequence = padsequences(testsequence, maxlen=10) prediction = model.predict(paddedtest_sequence) print(f'I love machine learning: {prediction[0][0]:.4f}') ```

4.3计算机视觉

4.3.1物体识别

```python import tensorflow as tf from tensorflow.keras.applications.resnet50 import ResNet50, preprocessinput, decodepredictions from tensorflow.keras.preprocessing import image

加载预训练模型

model = ResNet50(weights='imagenet')

预测

img = image.loadimg(imgpath, targetsize=(224, 224)) x = preprocessinput(img) predictions = model.predict(x)

解码预测结果

decode_predictions(predictions, top=5)[0] ```

4.3.2场景理解

```python import tensorflow as tf from tensorflow.keras.applications.resnet50 import ResNet50, preprocessinput, decodepredictions from tensorflow.keras.preprocessing import image

加载预训练模型

model = ResNet50(weights='imagenet')

预测

img = image.loadimg(imgpath, targetsize=(224, 224)) x = preprocessinput(img) predictions = model.predict(x)

解码预测结果

decode_predictions(predictions, top=5)[0] ```

4.3.3人脸识别

```python import tensorflow as tf from tensorflow.keras.applications.resnet50 import ResNet50, preprocessinput, decodepredictions from tensorflow.keras.preprocessing import image

加载预训练模型

model = ResNet50(weights='imagenet')

预测

img = image.loadimg(imgpath, targetsize=(224, 224)) x = preprocessinput(img) predictions = model.predict(x)

解码预测结果

decode_predictions(predictions, top=5)[0] ```

5.未来发展与趋势

在未来,人工智能和云计算将继续发展,以提高人类生活的质量和提高生产力。未来的趋势包括:

人工智能的广泛应用:人工智能将在各个领域得到广泛应用,如医疗、金融、教育、交通运输等。

自然语言处理的进一步发展:自然语言处理将成为人工智能的核心技术,使人类能够更好地与计算机进行交互。

深度学习模型的优化:深度学习模型将更加复杂,以提高模型的准确性和效率。

人工智能与云计算的融合:人工智能和云计算将更加紧密结合,以实现更高效的计算和存储。

人工智能伦理和道德问题的关注:随着人工智能技术的发展,人工智能伦理和道德问题将得到越来越关注,以确保技术的可控和安全。

人工智能与人工辅助智能的发展:人工辅助智能将成为人工智能的一个重要分支,以帮助人类更好地完成各种任务。

人工智能的可解释性:随着人工智能技术的发展,可解释性将成为一个重要的研究方向,以确保模型的透明度和可信度。

跨学科合作的加强:人工智能的发展将需要跨学科的合作,包括计算机科学、数学、心理学、社会学等多个领域。

6.附录常见问题

在本文中,我们已经详细介绍了人工智能和云计算在应用中的用法。在这里,我们将回答一些常见问题:

什么是人工智能? 人工智能是一种将人类智能模拟到计算机中的技术,以实现自主、学习、理解和决策等能力。

什么是云计算? 云计算是一种通过互联网提供计算资源和存储服务的方式,使用户可以在需要时轻松获取资源,而无需购买和维护自己的硬件设施。

人工智能和云计算有什么关系? 人工智能和云计算在应用中有密切的关系,人工智能需要大量的计算资源和存储空间来处理和存储数据,而云计算可以为人工智能提供便捷的计算和存储服务。

人工智能的主要技术有哪些? 人工智能的主要技术包括机器学习、深度学习、自然语言处理和计算机视觉等。

云计算的主要技术有哪些? 云计算的主要技术包括虚拟化、自动化、分布式计算和存储等。

人工智能的应用场景有哪些? 人工智能的应用场景包括医疗、金融、教育、交通运输、制造业等多个领域。

云计算的应用场景有哪些? 云计算的应用场景包括软件开发、数据存储、应用部署、虚拟桌面等多个领域。

人工智能的挑战有哪些? 人工智能的挑战包括数据不足、模型解释性、伦理和道德问题等多个方面。

云计算的挑战有哪些? 云计算的挑战包括安全性、隐私保护、数据传输延迟等多个方面。文章来源:https://www.toymoban.com/news/detail-850482.html

人工智能和云计算的未来发展趋势有哪些? 人工智能和云计算的未来发展趋势包括人工智能的广泛应用、自然语言处理的进一步发展、深度学习模型的优化、人工智能伦理和道德问题的关注等多个方面。文章来源地址https://www.toymoban.com/news/detail-850482.html

到了这里,关于人工智能和云计算带来的技术变革:AI在云计算中的应用的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!