1.背景介绍

随着人工智能技术的发展,AI大模型在各个领域的应用不断拓展,如自然语言处理、计算机视觉、推荐系统等。这些大模型通常具有高度复杂性和大规模性,需要在云计算环境下进行训练和优化。然而,在云计算环境下训练和优化AI大模型面临着诸多挑战,如数据分布、计算资源分配、模型并行等。本文将从模型训练和优化的角度,深入探讨AI大模型在云计算环境下的挑战和解决方法。

2.核心概念与联系

2.1 AI大模型

AI大模型通常指具有大规模参数量、复杂结构和高泛化能力的机器学习模型。例如,GPT-3、BERT、ResNet等。这些模型通常需要在大规模数据集上进行训练,以实现高质量的预测性能。

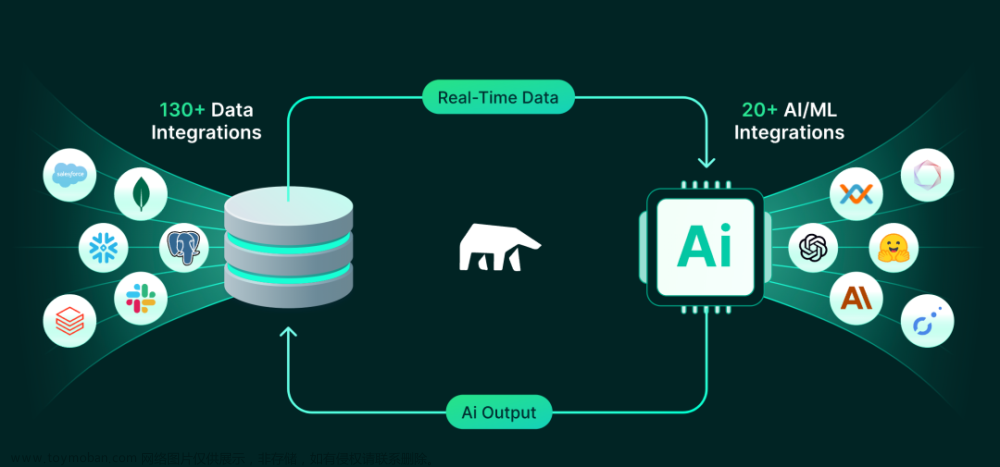

2.2 云计算环境

云计算环境是一种基于互联网的计算资源共享和分配模式,通过虚拟化技术实现对计算资源的抽象和集中管理。用户可以在云计算平台上购买计算资源,以实现模型训练和优化等任务。

2.3 模型训练与优化

模型训练是指通过学习算法和训练数据集,使模型在预定义的目标函数下达到最小化的过程。模型优化则是指在模型训练过程中,通过调整算法参数和计算资源分配,提高训练效率和预测性能的过程。

3.核心算法原理和具体操作步骤以及数学模型公式详细讲解

3.1 梯度下降算法

梯度下降算法是最基本的优化算法,通过迭代地更新模型参数,使目标函数达到最小值。具体步骤如下:

- 初始化模型参数$\theta$。

- 计算参数$\theta$对目标函数$J(\theta)$的梯度$\nabla J(\theta)$。

- 更新参数$\theta$:$\theta \leftarrow \theta - \alpha \nabla J(\theta)$,其中$\alpha$是学习率。

- 重复步骤2-3,直到收敛。

数学模型公式: $$ J(\theta) = \frac{1}{2m}\sum{i=1}^m (h\theta(xi) - yi)^2 $$ $$ \nabla J(\theta) = \frac{1}{m}\sum{i=1}^m (h\theta(xi) - yi) \nabla h\theta(xi) $$

3.2 随机梯度下降算法

随机梯度下降算法是梯度下降算法的一种变体,通过在每一次迭代中随机选择部分训练样本,减少计算量。具体步骤如下:

- 初始化模型参数$\theta$。

- 随机选择一个训练样本$(xi, yi)$。

- 计算参数$\theta$对该样本的梯度$\nabla J(\theta)$。

- 更新参数$\theta$:$\theta \leftarrow \theta - \alpha \nabla J(\theta)$。

- 重复步骤2-4,直到收敛。

数学模型公式与梯度下降算法相同。

3.3 分布式梯度下降算法

分布式梯度下降算法是随机梯度下降算法的一种扩展,通过将计算任务分布到多个工作节点上,实现并行计算。具体步骤如下:

- 初始化模型参数$\theta$。

- 将训练数据集划分为多个子集,分配给各个工作节点。

- 每个工作节点使用自己的子集计算参数$\theta$对目标函数的梯度$\nabla J(\theta)$。

- 将各个工作节点的梯度汇总到主节点。

- 主节点更新参数$\theta$:$\theta \leftarrow \theta - \alpha \nabla J(\theta)$。

- 重复步骤2-5,直到收敛。

数学模型公式与梯度下降算法相同。

4.具体代码实例和详细解释说明

4.1 使用Python实现梯度下降算法

```python import numpy as np

def train(X, y, alpha, numiterations): m = len(y) theta = np.zeros(X.shape[1]) for iteration in range(numiterations): gradient = (1 / m) * X.T.dot(X.dot(theta) - y) theta = theta - alpha * gradient return theta

X = np.array([[1, 2], [2, 3], [3, 4]]) y = np.array([1, 2, 3]) alpha = 0.01 numiterations = 1000 theta = train(X, y, alpha, numiterations) ```

4.2 使用Python实现随机梯度下降算法

```python import numpy as np

def train(X, y, alpha, numiterations): m = len(y) theta = np.zeros(X.shape[1]) for iteration in range(numiterations): index = np.random.randint(m) gradient = (2 / m) * X[index].dot(theta - y[index]) theta = theta - alpha * gradient return theta

X = np.array([[1, 2], [2, 3], [3, 4]]) y = np.array([1, 2, 3]) alpha = 0.01 numiterations = 1000 theta = train(X, y, alpha, numiterations) ```

4.3 使用Python实现分布式梯度下降算法

```python import numpy as np

def train(X, y, alpha, numiterations, numworkers): m = len(y) theta = np.zeros(X.shape[1]) for iteration in range(numiterations): workers = [np.random.randint(m) for _ in range(numworkers)] gradients = np.zeros(theta.shape) for worker in workers: gradient = (2 / m) * X[worker].dot(theta - y[worker]) gradients += gradient theta = theta - alpha * gradients / num_workers return theta

X = np.array([[1, 2], [2, 3], [3, 4]]) y = np.array([1, 2, 3]) alpha = 0.01 numiterations = 1000 numworkers = 2 theta = train(X, y, alpha, numiterations, numworkers) ```

5.未来发展趋势与挑战

未来,随着AI大模型的规模不断扩大,云计算环境的计算资源需求也将不断增加。同时,随着数据量和计算复杂性的增加,模型训练和优化的挑战也将更加巨大。因此,未来的研究方向包括:

- 提高模型训练和优化效率的算法研究。

- 提高云计算环境的计算资源分配和利用效率。

- 研究如何在有限的计算资源和时间内实现高质量的模型训练和优化。

- 研究如何在云计算环境下实现模型的并行和分布式训练。

- 研究如何在云计算环境下实现模型的安全和隐私保护。

6.附录常见问题与解答

Q: 为什么需要分布式梯度下降算法? A: 随着数据量和模型规模的增加,单机训练已经无法满足需求。分布式梯度下降算法可以将计算任务分布到多个工作节点上,实现并行计算,从而提高训练效率。

Q: 如何选择合适的学习率? A: 学习率是影响模型训练效果的关键参数。通常可以通过交叉验证或者网格搜索的方式选择合适的学习率。文章来源:https://www.toymoban.com/news/detail-856132.html

Q: 如何保证模型的安全和隐私? A: 在云计算环境下,模型的安全和隐私保护是一个重要问题。可以通过加密算法、模型脱敏、 federated learning 等方法来保护模型的安全和隐私。文章来源地址https://www.toymoban.com/news/detail-856132.html

到了这里,关于模型训练与优化:AI大模型在云计算环境下的挑战的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!