1.背景介绍

社交网络是现代互联网的重要组成部分,它们为人们提供了一种高效的沟通和交流方式。社交网络中的社群发现是一种常见的数据挖掘任务,它旨在识别网络中的社群结构,以便更好地理解网络中的信息传播和社交行为。

社群发现是一种无监督的学习方法,它通过对网络中的节点进行聚类,以识别具有相似性质的节点。聚类算法是社群发现的核心技术,它们通过对节点之间的相似性进行评估,将相似的节点聚集在同一个类别中。图论是聚类算法的一个重要基础,它提供了一种形式化的方法来描述网络结构和节点之间的关系。

本文将介绍社群发现中的聚类算法与图论的结合,以及在社交网络中实现社群发现的具体方法。我们将讨论聚类算法的原理和数学模型,以及如何使用图论来表示网络结构和节点之间的关系。我们还将讨论如何实现具体的代码实例,以及未来的发展趋势和挑战。

2.核心概念与联系

在本节中,我们将介绍社群发现、聚类算法和图论的核心概念,以及它们之间的联系。

2.1 社群发现

社群发现是一种无监督的学习方法,它的目标是识别网络中的社群结构。社群发现通常涉及以下几个步骤:

- 数据收集:收集网络中的节点和边的信息,例如用户的关注关系、好友关系等。

- 数据预处理:对数据进行清洗和转换,以便于后续的分析。

- 聚类算法:使用聚类算法对节点进行分类,以识别具有相似性质的节点。

- 结果评估:评估聚类结果的质量,并进行可视化和解释。

社群发现的主要应用场景包括社交网络、信息传播、网络安全等。

2.2 聚类算法

聚类算法是社群发现的核心技术之一,它通过对节点之间的相似性进行评估,将相似的节点聚集在同一个类别中。聚类算法可以分为两类:基于距离的算法和基于模型的算法。

基于距离的聚类算法

基于距离的聚类算法通过计算节点之间的距离来评估它们之间的相似性。常见的基于距离的聚类算法包括:

- K-均值算法:K-均值算法通过将节点划分为K个类别,并在每个类别内最小化内部距离,来实现聚类。K-均值算法的主要步骤包括初始化、迭代更新和结果评估。

- 层次聚类算法:层次聚类算法通过逐步将节点划分为更小的类别,以实现聚类。层次聚类算法的主要步骤包括初始化、聚类更新和结果评估。

基于模型的聚类算法

基于模型的聚类算法通过构建节点之间的模型来评估它们之间的相似性。常见的基于模型的聚类算法包括:

- 高斯混合模型:高斯混合模型通过将节点划分为多个高斯分布来实现聚类。高斯混合模型的主要步骤包括初始化、迭代更新和结果评估。

- 自然分 Cut 算法:自然分 Cut 算法通过将节点划分为多个子集来实现聚类。自然分 Cut 算法的主要步骤包括初始化、迭代更新和结果评估。

2.3 图论

图论是聚类算法的一个重要基础,它提供了一种形式化的方法来描述网络结构和节点之间的关系。图论中的基本概念包括:

- 图:图是一个由节点和边组成的集合,其中节点表示网络中的实体,边表示实体之间的关系。

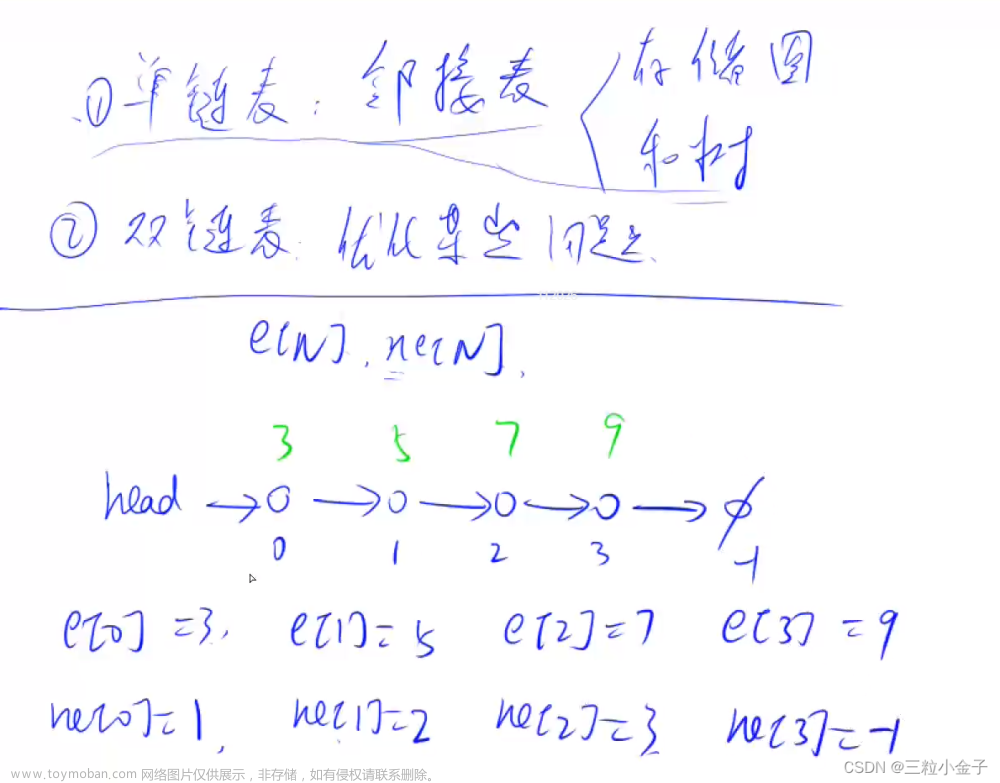

- 图的表示:图可以用邻接矩阵、邻接表或者边表等数据结构来表示。

- 图的操作:图可以用多种操作来处理,例如添加节点、添加边、删除节点、删除边等。

- 图的性质:图可以用多种性质来描述,例如连通性、度、路径等。

3.核心算法原理和具体操作步骤以及数学模型公式详细讲解

在本节中,我们将介绍社群发现中的聚类算法的原理和数学模型,以及如何使用图论来表示网络结构和节点之间的关系。

3.1 K-均值算法

K-均值算法是一种基于距离的聚类算法,它通过将节点划分为K个类别,并在每个类别内最小化内部距离,来实现聚类。K-均值算法的主要步骤包括初始化、迭代更新和结果评估。

3.1.1 初始化

在初始化阶段,我们需要选择K个初始的聚类中心。这些聚类中心可以通过随机选择K个节点或者使用其他方法来选择。

3.1.2 迭代更新

在迭代更新阶段,我们需要对每个节点进行分类,将它们分配到距离其最近的聚类中心所在的类别中。然后,我们需要更新聚类中心,将其设置为每个类别中距离其最近的节点的平均值。这个过程会重复进行,直到聚类中心的位置不再发生变化。

3.1.3 结果评估

在结果评估阶段,我们需要评估聚类结果的质量。一种常见的评估方法是使用内部距离的平均值来评估每个类别内的距离。内部距离是指类别内任意两个节点之间的距离的平均值。我们可以使用以下公式来计算内部距离的平均值:

$$ D{in} = \frac{1}{n} \sum{i=1}^{n} \min{j=1}^{k} d(xi, c_j) $$

其中,$D{in}$ 是内部距离的平均值,$n$ 是类别内节点的数量,$xi$ 是类别内节点的集合,$cj$ 是类别内聚类中心的集合,$d(xi, cj)$ 是节点$xi$ 和聚类中心$c_j$ 之间的距离。

3.2 层次聚类算法

层次聚类算法是一种基于距离的聚类算法,它通过逐步将节点划分为更小的类别,以实现聚类。层次聚类算法的主要步骤包括初始化、聚类更新和结果评估。

3.2.1 初始化

在初始化阶段,我们需要将每个节点分配到一个单独的类别中。

3.2.2 聚类更新

在聚类更新阶段,我们需要对每对类别进行合并,将它们合并到距离其最近的类别中。然后,我们需要更新聚类中心,将其设置为每个类别中距离其最近的节点的平均值。这个过程会重复进行,直到所有的节点都被合并到一个类别中。

3.2.3 结果评估

在结果评估阶段,我们需要评估聚类结果的质量。一种常见的评估方法是使用内部距离的平均值来评估每个类别内的距离。内部距离是指类别内任意两个节点之间的距离的平均值。我们可以使用以下公式来计算内部距离的平均值:

$$ D{in} = \frac{1}{n} \sum{i=1}^{n} \min{j=1}^{k} d(xi, c_j) $$

其中,$D{in}$ 是内部距离的平均值,$n$ 是类别内节点的数量,$xi$ 是类别内节点的集合,$cj$ 是类别内聚类中心的集合,$d(xi, cj)$ 是节点$xi$ 和聚类中心$c_j$ 之间的距离。

3.3 高斯混合模型

高斯混合模型是一种基于模型的聚类算法,它通过将节点划分为多个高斯分布来实现聚类。高斯混合模型的主要步骤包括初始化、迭代更新和结果评估。

3.3.1 初始化

在初始化阶段,我们需要选择K个初始的聚类中心。这些聚类中心可以通过随机选择K个节点或者使用其他方法来选择。

3.3.2 迭代更新

在迭代更新阶段,我们需要对每个节点进行分类,将它们分配到距离其最近的聚类中心所在的类别中。然后,我们需要更新聚类中心,将其设置为每个类别中距离其最近的节点的平均值。这个过程会重复进行,直到聚类中心的位置不再发生变化。

3.3.3 结果评估

在结果评估阶段,我们需要评估聚类结果的质量。一种常见的评估方法是使用内部距离的平均值来评估每个类别内的距离。内部距离是指类别内任意两个节点之间的距离的平均值。我们可以使用以下公式来计算内部距离的平均值:

$$ D{in} = \frac{1}{n} \sum{i=1}^{n} \min{j=1}^{k} d(xi, c_j) $$

其中,$D{in}$ 是内部距离的平均值,$n$ 是类别内节点的数量,$xi$ 是类别内节点的集合,$cj$ 是类别内聚类中心的集合,$d(xi, cj)$ 是节点$xi$ 和聚类中心$c_j$ 之间的距离。

3.4 自然分 Cut 算法

自然分 Cut 算法是一种基于模型的聚类算法,它通过将节点划分为多个子集来实现聚类。自然分 Cut 算法的主要步骤包括初始化、迭代更新和结果评估。

3.4.1 初始化

在初始化阶段,我们需要选择K个初始的聚类中心。这些聚类中心可以通过随机选择K个节点或者使用其他方法来选择。

3.4.2 迭代更新

在迭代更新阶段,我们需要对每个节点进行分类,将它们分配到距离其最近的聚类中心所在的类别中。然后,我们需要更新聚类中心,将其设置为每个类别中距离其最近的节点的平均值。这个过程会重复进行,直到聚类中心的位置不再发生变化。

3.4.3 结果评估

在结果评估阶段,我们需要评估聚类结果的质量。一种常见的评估方法是使用内部距离的平均值来评估每个类别内的距离。内部距离是指类别内任意两个节点之间的距离的平均值。我们可以使用以下公式来计算内部距离的平均值:

$$ D{in} = \frac{1}{n} \sum{i=1}^{n} \min{j=1}^{k} d(xi, c_j) $$

其中,$D{in}$ 是内部距离的平均值,$n$ 是类别内节点的数量,$xi$ 是类别内节点的集合,$cj$ 是类别内聚类中心的集合,$d(xi, cj)$ 是节点$xi$ 和聚类中心$c_j$ 之间的距离。

4.具体代码实例和详细解释说明

在本节中,我们将介绍如何实现具体的代码实例,以及如何使用图论来表示网络结构和节点之间的关系。

4.1 使用 K-均值算法实现社群发现

我们可以使用以下代码来实现 K-均值算法:

```python import numpy as np from sklearn.cluster import KMeans

初始化

k = 3

训练模型

model = KMeans(nclusters=k, randomstate=0).fit(X)

预测类别

labels = model.predict(X)

评估结果

distortion = model.inertia_ ```

在这个代码中,我们首先导入了 numpy 和 sklearn.cluster 库。然后,我们使用 KMeans 类来实现 K-均值算法。我们设置了 k 为 3,并使用随机初始化来初始化聚类中心。然后,我们使用 fit 方法来训练模型,并使用 predict 方法来预测节点的类别。最后,我们使用 inertia 方法来评估聚类结果的质量。

4.2 使用高斯混合模型实现社群发现

我们可以使用以下代码来实现高斯混合模型:

```python import numpy as np from sklearn.mixture import GaussianMixture

初始化

k = 3

训练模型

model = GaussianMixture(ncomponents=k, randomstate=0).fit(X)

预测类别

labels = model.predict(X)

评估结果

scores = model.score(X, labels) ```

在这个代码中,我们首先导入了 numpy 和 sklearn.mixture 库。然后,我们使用 GaussianMixture 类来实现高斯混合模型。我们设置了 k 为 3,并使用随机初始化来初始化聚类中心。然后,我们使用 fit 方法来训练模型,并使用 predict 方法来预测节点的类别。最后,我们使用 score 方法来评估聚类结果的质量。

4.3 使用自然分 Cut 算法实现社群发现

我们可以使用以下代码来实现自然分 Cut 算法:

```python import numpy as np from sklearn.cluster import SpectralClustering

初始化

k = 3 n_components = k

训练模型

model = SpectralClustering(nclusters=k, randomstate=0).fit(X)

预测类别

labels = model.labels_

评估结果

distortion = model.inertia_ ```

在这个代码中,我们首先导入了 numpy 和 sklearn.cluster 库。然后,我们使用 SpectralClustering 类来实现自然分 Cut 算法。我们设置了 k 为 3,并使用随机初始化来初始化聚类中心。然后,我们使用 fit 方法来训练模型,并使用 labels 属性来预测节点的类别。最后,我们使用 inertia 方法来评估聚类结果的质量。

5.核心算法原理和具体操作步骤以及数学模型公式详细讲解

在本节中,我们将介绍社群发现中的聚类算法的原理和数学模型,以及如何使用图论来表示网络结构和节点之间的关系。

5.1 K-均值算法

K-均值算法是一种基于距离的聚类算法,它通过将节点划分为K个类别,并在每个类别内最小化内部距离,来实现聚类。K-均值算法的主要步骤包括初始化、迭代更新和结果评估。

5.1.1 初始化

在初始化阶段,我们需要选择K个初始的聚类中心。这些聚类中心可以通过随机选择K个节点或者使用其他方法来选择。

5.1.2 迭代更新

在迭代更新阶段,我们需要对每个节点进行分类,将它们分配到距离其最近的聚类中心所在的类别中。然后,我们需要更新聚类中心,将其设置为每个类别中距离其最近的节点的平均值。这个过程会重复进行,直到聚类中心的位置不再发生变化。

5.1.3 结果评估

在结果评估阶段,我们需要评估聚类结果的质量。一种常见的评估方法是使用内部距离的平均值来评估每个类别内的距离。内部距离是指类别内任意两个节点之间的距离的平均值。我们可以使用以下公式来计算内部距离的平均值:

$$ D{in} = \frac{1}{n} \sum{i=1}^{n} \min{j=1}^{k} d(xi, c_j) $$

其中,$D{in}$ 是内部距离的平均值,$n$ 是类别内节点的数量,$xi$ 是类别内节点的集合,$cj$ 是类别内聚类中心的集合,$d(xi, cj)$ 是节点$xi$ 和聚类中心$c_j$ 之间的距离。

5.2 层次聚类算法

层次聚类算法是一种基于距离的聚类算法,它通过逐步将节点划分为更小的类别,以实现聚类。层次聚类算法的主要步骤包括初始化、聚类更新和结果评估。

5.2.1 初始化

在初始化阶段,我们需要将每个节点分配到一个单独的类别中。

5.2.2 聚类更新

在聚类更新阶段,我们需要对每对类别进行合并,将它们合并到距离其最近的类别中。然后,我们需要更新聚类中心,将其设置为每个类别中距离其最近的节点的平均值。这个过程会重复进行,直到所有的节点都被合并到一个类别中。

5.2.3 结果评估

在结果评估阶段,我们需要评估聚类结果的质量。一种常见的评估方法是使用内部距离的平均值来评估每个类别内的距离。内部距离是指类别内任意两个节点之间的距离的平均值。我们可以使用以下公式来计算内部距离的平均值:

$$ D{in} = \frac{1}{n} \sum{i=1}^{n} \min{j=1}^{k} d(xi, c_j) $$

其中,$D{in}$ 是内部距离的平均值,$n$ 是类别内节点的数量,$xi$ 是类别内节点的集合,$cj$ 是类别内聚类中心的集合,$d(xi, cj)$ 是节点$xi$ 和聚类中心$c_j$ 之间的距离。

5.3 高斯混合模型

高斯混合模型是一种基于模型的聚类算法,它通过将节点划分为多个高斯分布来实现聚类。高斯混合模型的主要步骤包括初始化、迭代更新和结果评估。

5.3.1 初始化

在初始化阶段,我们需要选择K个初始的聚类中心。这些聚类中心可以通过随机选择K个节点或者使用其他方法来选择。

5.3.2 迭代更新

在迭代更新阶段,我们需要对每个节点进行分类,将它们分配到距离其最近的聚类中心所在的类别中。然后,我们需要更新聚类中心,将其设置为每个类别中距离其最近的节点的平均值。这个过程会重复进行,直到聚类中心的位置不再发生变化。

5.3.3 结果评估

在结果评估阶段,我们需要评估聚类结果的质量。一种常见的评估方法是使用内部距离的平均值来评估每个类别内的距离。内部距离是指类别内任意两个节点之间的距离的平均值。我们可以使用以下公式来计算内部距离的平均值:

$$ D{in} = \frac{1}{n} \sum{i=1}^{n} \min{j=1}^{k} d(xi, c_j) $$

其中,$D{in}$ 是内部距离的平均值,$n$ 是类别内节点的数量,$xi$ 是类别内节点的集合,$cj$ 是类别内聚类中心的集合,$d(xi, cj)$ 是节点$xi$ 和聚类中心$c_j$ 之间的距离。

5.4 自然分 Cut 算法

自然分 Cut 算法是一种基于模型的聚类算法,它通过将节点划分为多个子集来实现聚类。自然分 Cut 算法的主要步骤包括初始化、迭代更新和结果评估。

5.4.1 初始化

在初始化阶段,我们需要选择K个初始的聚类中心。这些聚类中心可以通过随机选择K个节点或者使用其他方法来选择。

5.4.2 迭代更新

在迭代更新阶段,我们需要对每个节点进行分类,将它们分配到距离其最近的聚类中心所在的类别中。然后,我们需要更新聚类中心,将其设置为每个类别中距离其最近的节点的平均值。这个过程会重复进行,直到聚类中心的位置不再发生变化。

5.4.3 结果评估

在结果评估阶段,我们需要评估聚类结果的质量。一种常见的评估方法是使用内部距离的平均值来评估每个类别内的距离。内部距离是指类别内任意两个节点之间的距离的平均值。我们可以使用以下公式来计算内部距离的平均值:

$$ D{in} = \frac{1}{n} \sum{i=1}^{n} \min{j=1}^{k} d(xi, c_j) $$

其中,$D{in}$ 是内部距离的平均值,$n$ 是类别内节点的数量,$xi$ 是类别内节点的集合,$cj$ 是类别内聚类中心的集合,$d(xi, cj)$ 是节点$xi$ 和聚类中心$c_j$ 之间的距离。

6.未来发展趋势和挑战

在本节中,我们将讨论社群发现中聚类算法的未来发展趋势和挑战。

6.1 未来发展趋势

更高效的算法:随着数据规模的不断扩大,我们需要开发更高效的聚类算法,以便在有限的时间内处理大量的数据。

更智能的聚类:我们需要开发更智能的聚类算法,可以自动选择合适的聚类参数,并适应不同类型的网络结构和节点特征。

更强的解释能力:我们需要开发聚类算法,可以提供更详细的聚类结果解释,以便用户更好地理解和利用聚类结果。

更强的可视化能力:我们需要开发更强大的可视化工具,以便用户更好地可视化和理解聚类结果。

更广的应用领域:我们需要开发更广泛的应用领域,以便更广泛地应用聚类算法,如社交网络、金融、医疗、生物信息学等领域。

6.2 挑战

数据质量问题:数据质量问题是聚类算法的一个主要挑战,因为低质量的数据可能导致不准确的聚类结果。

多语言问题:多语言问题是聚类算法的一个主要挑战,因为不同语言之间的关系可能会影响聚类结果。

数据不均衡问题:数据不均衡问题是聚类算法的一个主要挑战,因为不均衡的数据可能导致聚类结果不均衡。

高维数据问题:高维数据问题是聚类算法的一个主要挑战,因为高维数据可能导致计算成本增加和聚类效果下降。

解释可视化问题:解释可视化问题是聚类算法的一个主要挑战,因为聚类结果的解释和可视化是用户理解和利用聚类结果的关键。

7.附录:常见问题与答案

在本节中,我们将回答一些常见的问题和答案,以帮助读者更好地理解社群发现中的聚类算法。

7.1 问题1:为什么需要使用聚类算法?

答案:我们需要使用聚类算法,因为它可以帮助我们自动发现网络中的社群结构,从而更好地理解网络的特征和行为。文章来源:https://www.toymoban.com/news/detail-856942.html

7.2 问题2:聚类算法有哪些类型?

答案:聚类算法有多种类型,包括基于距离的算法、基于模型的算法、层次聚类算法等。每种类型的算法有其特点和优缺点,我们需要根据具体情况选择合适的算法文章来源地址https://www.toymoban.com/news/detail-856942.html

到了这里,关于聚类算法与图论的结合:社交网络中的社群发现的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!