0. 小小说明

由于一些前后概念是嵌套在一起,密切相关的,但是它们的认知深度的层次又有先后差异,所以为循序渐进,这里在讲解时会存在部分的后面的概念往前提以帮助当前概念的理解以确保大家每一步都能看得懂,并为后续概念作铺垫,文中所有存在这种概念嵌套的情况都有说明,只要大家认真看的话,绝对保证大家看得清楚明白。

1. 基本概念

1.1 矢量的图形化引入

大家应该都知道矢量是可以分解的,而大家知不知道矢量分解的真实含义和思想出发点呢?首先我们从图形化的矢量入手。我们知道,一维矢量就是可以表示为某一点

A

A

A到过该点的某一条直线上的任意点

B

B

B的一条有向线段,图形化可以表示为一个有向线段

a

{\bf{a}}

a![信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础,线性代数,矩阵,信号处理](https://imgs.yssmx.com/Uploads/2024/04/858588-1.png)

图1 有向线段

a

\text{图1 有向线段\bf{a}}

图1 有向线段a

不难知道,对于直线

A

B

AB

AB上任意一条向量

α

{\boldsymbol{\alpha}}

α,都可以通过对向量

a

\bf{a}

a与一个数

λ

\lambda

λ,即向量

a

\bf{a}

a的数乘相乘得到,即

α

=

λ

a

{\boldsymbol{\alpha}}=\lambda\bf{a}

α=λa。但是,当在直线外出现一点

C

C

C,那么如果对于有向线段

b

=

A

C

→

\bf{b}=\overrightarrow {AC}

b=AC,就发现力不从心了![信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础,线性代数,矩阵,信号处理](https://imgs.yssmx.com/Uploads/2024/04/858588-2.png)

图2 有向线段

a

表示有向线段

b

\text{图2 有向线段{\bf{a}}表示有向线段{\bf{b}}}

图2 有向线段a表示有向线段b

可以发现,无论给向量

a

\bf{a}

a进行任何数乘,都无法完全表示向量

b

\bf{b}

b。那么怎么办呢?虽然大家都知道应该如何解决这个问题(就是找到另一条与

a

\bf{a}

a不在同一直线上的向量对吧),但是先别急,因为这是为了更深层次理解向量空间与信号分解的原理,需要引入更深层次的内容,但是绝对讲得浅显易懂。为定量描述用向量

a

\bf{a}

a表示

b

\bf{b}

b的误差,这里引入一个误差向量

ε

\boldsymbol{\varepsilon}

ε![信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础,线性代数,矩阵,信号处理](https://imgs.yssmx.com/Uploads/2024/04/858588-3.png)

图3 表示误差

\text{图3 表示误差}

图3 表示误差

即令

b

=

λ

a

+

ε

\begin{equation} {\bf{b}}=\lambda{\bf{a}}+\boldsymbol{\varepsilon} \end{equation}

b=λa+ε

那么如果要使得向量

a

{\bf{a}}

a表示

b

{\bf{b}}

b的误差最小,就要求

∣

ε

∣

\left| {\boldsymbol{\varepsilon }} \right|

∣ε∣最小,也即

∣

ε

∣

2

=

ε

2

\left| {\boldsymbol{\varepsilon }} \right|^2=\boldsymbol{\varepsilon }^2

∣ε∣2=ε2最小。因此,我们得到了一个问题:找到一个

λ

\lambda

λ,使得

ε

2

\boldsymbol{\varepsilon }^2

ε2最小,用数学语言可以表述该问题为

min

λ

ε

2

=

min

λ

(

b

−

λ

a

)

2

\begin{equation} \mathop {\min }\limits_\lambda\boldsymbol{\varepsilon }^2=\mathop {\min }\limits_\lambda\left({\bf{b}}-\lambda{\bf{a}}\right)^2 \end{equation}

λminε2=λmin(b−λa)2

对于该问题,我们有两种求解思路:

方法1: 直接从图中分析,在给定了标准向量

a

\bf{a}

a所在的直线和向量

b

\bf{b}

b的大小和方向的情况下,要令误差

∣

ε

∣

\left| {\boldsymbol{\varepsilon }} \right|

∣ε∣最小,那么也就是当

ε

⊥

a

{\boldsymbol{\varepsilon }} \bot {\bf{a}}

ε⊥a时,才有

∣

ε

∣

\left| {\boldsymbol{\varepsilon }} \right|

∣ε∣最小,图示如下![信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础,线性代数,矩阵,信号处理](https://imgs.yssmx.com/Uploads/2024/04/858588-4.png)

图4 表示误差最小情况

\text{图4 表示误差最小情况}

图4 表示误差最小情况

那么根据直角三角形的三边关系,有

∣

λ

a

∣

=

λ

∣

a

∣

=

∣

b

∣

cos

θ

↓

λ

=

∣

b

∣

cos

θ

∣

a

∣

=

∣

a

∣

∣

b

∣

cos

θ

∣

a

∣

2

=

a

⋅

b

a

⋅

a

\begin{array}{c} \left| {\lambda {\bf{a}}} \right| = \lambda \left| {\bf{a}} \right| = \left| {\bf{b}} \right|\cos \theta \\ \downarrow \\ {\lambda = \frac{{\left| {\bf{b}} \right|\cos \theta }}{{\left| {\bf{a}} \right|}} = \frac{{\left| {\bf{a}} \right|\left| {\bf{b}} \right|\cos \theta }}{{{{\left| {\bf{a}} \right|}^2}}} = \frac{{{\bf{a}} \cdot {\bf{b}}}}{{{\bf{a}} \cdot {\bf{a}}}}} \end{array}

∣λa∣=λ∣a∣=∣b∣cosθ↓λ=∣a∣∣b∣cosθ=∣a∣2∣a∣∣b∣cosθ=a⋅aa⋅b

方法2: 从数学严格推导的角度考虑,对于上述的式(2)中问题的表达式,不难发现该问题是一个关于

λ

\lambda

λ的一元二次函数,并且平方项前的系数为正,那就表明该函数的最小值就是出现在使得倒数等于

0

0

0的那一个极值点处,那么就将该式对

λ

\lambda

λ求导,就可以得到

d

d

λ

(

b

−

λ

a

)

2

=

−

2

a

(

b

−

λ

a

)

=

−

2

a

ε

=

0

\begin{equation} \frac{d}{{d\lambda }}{\left( {{\bf{b}} - \lambda {\bf{a}}} \right)^2} = - 2{\bf{a}}\left( {{\bf{b}} - \lambda {\bf{a}}} \right) =- 2{\bf{a}}{\boldsymbol{\varepsilon }}= 0 \end{equation}

dλd(b−λa)2=−2a(b−λa)=−2aε=0

要令上面的等式成立,对于含有向量内积运算的左式,其结果又三种可能性:

- a = 0 {\bf{a}}={\bf{0}} a=0,但显然标准向量不可能为零向量,不成立;

- b − λ a = ε = 0 {{\bf{b}} - \lambda {\bf{a}}}={\boldsymbol{\varepsilon }}={\bf{0}} b−λa=ε=0,则此时只有 b \bf{b} b与 a \bf{a} a时才成立,对于这里讨论的不在同一直线上的情况,这种情况也不成立;

- a ⊥ ε {\bf{a}}\bot{\boldsymbol{\varepsilon }} a⊥ε,因而这种情况与方法1所得到的关系一致,只有这种情况成立。

基于

∣

a

∣

≠

0

\left|{\bf{a}}\right|\ne 0

∣a∣=0的前提,按照一元一次方程的求解方法可以非常直接地求解出式(3)中的

λ

\lambda

λ,可以得到

λ

=

a

⋅

b

a

⋅

a

\begin{equation} {\lambda = \frac{{{\bf{a}} \cdot {\bf{b}}}}{{{\bf{a}} \cdot {\bf{a}}}}} \end{equation}

λ=a⋅aa⋅b

可以看到该求解结果与方法1中的结果一致,同时注意这个结果是在上述可能性3成立而可能性1不可能成立的情况下才能得到的。

1.2 最佳系数(相似系数)

从而对于式(3)和式(4)引入一个概念:对于两个已知方向和大小的向量

U

1

{\bf{U}}_1

U1和

A

\bf{A}

A,定义了一个该表示中的最佳系数

λ

\lambda

λ(有些地方也称为两向量的相似系数)

λ

=

A

⋅

U

1

U

1

⋅

U

1

\begin{equation} {\lambda = \frac{{{\bf{A}} \cdot {{\bf{U}}_1}}}{{{{\bf{U}}_1} \cdot {{\bf{U}}_1}}}} \end{equation}

λ=U1⋅U1A⋅U1

(另外,可能有些认真的盆友们还会发现为什么这里只是对两个向量进行比较,为什么向量

U

1

{\bf{U}}_1

U1还要加一个下标1呢,这是为了兼容后续引入多个已知的向量基底

U

1

,

U

2

,

⋯

,

U

m

{\bf{U}}_1,{\bf{U}}_2,\cdots,{\bf{U}}_m

U1,U2,⋯,Um来表示一个一般向量

A

\bf{A}

A时的表述方法,具体会到后面再阐述,这里只是先给大家做一个铺垫)

特别地,

λ

=

0

\lambda=0

λ=0时,就称两个向量是正交的,即

A

⊥

U

1

{\bf{A}}\bot{\bf{U}}_1

A⊥U1,相信这不难理解,同时这也是为之后对信号分解时的基底选择需要满足正交性的一个铺垫。(另外做一个对正交性的初步理解,就是向量与自身的内积非零,与同组其它向量的内积为零,先有印象,之后细说)

1.3 向量的维数

向量的维数其实很简单,相信大家也都知道,这里就是简单提一下:向量的维数其实就可以理解为坐标轴的维数的拓展,即一维坐标轴上的一个坐标可以用一个数值(即标量) x x x来表示,这个数值同时表达了从原点到该点有向线段的长度大小和方向,该有向线段就对应了一个一维向量(一维向量就是一个数,即一个标量);同理,平面坐标系下的二维坐标则也表达了原点到该点的向量,即二维向量,立体空间坐标系下的坐标也就表达了一个三维向量。之所以说向量的维数是坐标系维数的拓展,就是因为当维数 n > 3 n>3 n>3时,无法再用坐标轴表示,但可以用类似的思想理解 n > 3 n>3 n>3时的高维向量。

1.4 向量基的图形化初步理解

1.4.1 一维向量基

如图1所示,当标准向量为

a

\bf{a}

a,而当需要被表示的向量

b

\bf{b}

b与

a

\bf{a}

a共线(在直线

A

B

AB

AB上),则该向量可以被向量

a

\bf{a}

a完全地无误差地表示(

ε

=

0

\boldsymbol{\varepsilon}={\bf{0}}

ε=0)

b

=

λ

a

\begin{equation} \bf{b}=\lambda\bf{a} \end{equation}

b=λa

从而对于一条直线上的任意向量,可以使用该直线上的一个给定的非零向量

a

\bf{a}

a唯一地完全无误差的表示,因而向量

a

\bf{a}

a就是这条直线上的一个(组)1维向量基。这是满足了向量表示的

- 唯一性: 这里根据1.3节中的一维向量描述,如果只考虑一条直线(数轴)上的向量,那么只需要知道将该向量的起始点平移到原点时其终点对应的值即可,即一个值即可确定。从而对于任意确定的向量 b \bf{b} b,只需要用一个(相当于已知的)标量 x b x_b xb即可确定,同样对于标准向量 a \bf{a} a可以使用一个(已知的)标量 x a x_a xa即可确定,从而要求式(6)中的 λ \lambda λ(待求自变量),只需要求一元一次方程 x b = x a λ x_b=x_a\lambda xb=xaλ就可以了。显然,解是唯一的;

-

完备性: 完备性是指一组向量基必须满足的,即该组向量基必须能够完全无误差地描述对应维度的向量空间。另外,向量空间在本文第2节会进一步解释,且只需要大致理解概念即可,不用深究中的任意向量。

首先我们知道非零向量 a \bf{a} a与自身的内积一定非零,那么这里我们还可以这样理解:该向量组中只有 a \bf{a} a一个向量,所以就认为 a \bf{a} a与组中其它向量的内积就是 0 0 0。

1.4.2 二维向量基

进一步地,如上面图3所示,当只使用一个标准矢量

a

{\bf{a}}

a,无法在无误差的情况下描述一个与其不在同一直线上的向量

b

{\bf{b}}

b。将图3中的标准向量

a

{\bf{a}}

a写为

U

1

{\bf{U}}_1

U1,向量

b

{\bf{b}}

b写为

A

{\bf{A}}

A(按照1.2节中的表述方法),并再取一个已知标准向量

U

2

{\bf{U}}_2

U2与

U

1

{\bf{U}}_1

U1共同表示向量

A

{\bf{A}}

A,数学表达为

A

=

λ

1

U

1

+

λ

2

U

2

+

ε

{\bf{A}}=\lambda_1{\bf{U}}_1+\lambda_2{\bf{U}}_2+\boldsymbol{\varepsilon}

A=λ1U1+λ2U2+ε

当

U

2

{\bf{U}}_2

U2与

U

1

{\bf{U}}_1

U1不共线并且

A

\bf{A}

A在

U

1

{\bf{U}}_1

U1与

U

2

{\bf{U}}_2

U2所确定的平面上时(相交两直线确定一平面),可以根据平行四边形法则,有![信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础,线性代数,矩阵,信号处理](https://imgs.yssmx.com/Uploads/2024/04/858588-5.png)

图5 不共线的

U

1

和

U

2

表示与之共面的向量

A

\text{图5 不共线的}{\bf{U}}_1\text{和}{\bf{U}}_2\text{表示与之共面的向量\bf{A}}

图5 不共线的U1和U2表示与之共面的向量A

即

ε

=

0

\boldsymbol{\varepsilon}=\bf{0}

ε=0,

A

=

λ

1

U

1

+

λ

2

U

2

{\bf{A}}=\lambda_1{\bf{U}}_1+\lambda_2{\bf{U}}_2

A=λ1U1+λ2U2

表明不共线的两个向量

U

1

{\bf{U}}_1

U1和

U

2

{\bf{U}}_2

U2可以完全无误差地表达向量

A

\bf{A}

A。前面对向量

A

\bf{A}

A的限制只有在

U

1

{\bf{U}}_1

U1与

U

2

{\bf{U}}_2

U2所确定的平面上,所以不难理解两个不共线的向量可以表示这两个向量所在平面内的所有向量(严格证明可以通过建立直角坐标系,通过坐标运算证明,这里就不做多余推导了)。同时,根据1.1节的内容同理,当

U

1

{\bf{U}}_1

U1与

U

2

{\bf{U}}_2

U2不共线时,

U

1

{\bf{U}}_1

U1和

U

2

{\bf{U}}_2

U2之间无法无误差地互相单独表示出对方,这是从矢量图形的角度理解的线性无关的向量,即不共线的两个向量

U

1

{\bf{U}}_1

U1和

U

2

{\bf{U}}_2

U2是线性无关的。对于两个互为线性无关的向量,就是互相不能表示对方的两个向量(关于线性无关,后面会再次提到,这里先仅基于两个向量建立一个概念)。

综上,给出**平面直角坐标系(2维向量空间)**下的一组概念:使用2个线性无关的向量可以无误差地表示出这2个向量所确定平面上的任意向量,并将这两个向量称为2维向量空间中的一组基底(也简称作基)。

同样,要求得待定参数

λ

1

\lambda_1

λ1和

λ

2

\lambda_2

λ2,我们也可以根据类似1.3节中的二维向量的平面坐标系下的描述以及1.4.1节中的带入方法,令任意确定的平面向量

A

=

[

x

A

,

y

A

]

T

{\bf{A}}=\left[x_A,y_A\right]^T

A=[xA,yA]T,以及平面内不在同一直线上的两个已知向量

U

1

=

[

x

1

,

y

1

]

T

,

U

2

=

[

x

2

,

y

2

]

T

{\bf{U}}_1=\left[x_1,y_1\right]^T,{\bf{U}}_2=\left[x_2,y_2\right]^T

U1=[x1,y1]T,U2=[x2,y2]T(这些都是已知参数),求解

λ

1

\lambda_1

λ1和

λ

2

\lambda_2

λ2

[

x

A

y

A

]

=

[

x

1

x

2

y

1

y

2

]

[

λ

1

λ

2

]

\left[ {\begin{matrix} {{x_A}}\\ {{y_A}} \end{matrix}} \right]= \left[ {\begin{matrix} {{x_1}}&{{x_2}}\\ {{y_1}}&{{y_2}} \end{matrix}} \right]\left[ {\begin{matrix} {{\lambda _1}}\\ {{\lambda _2}} \end{matrix}} \right]

[xAyA]=[x1y1x2y2][λ1λ2]

直接可以看到的是该矩阵方程的系数矩阵

[

x

1

x

2

y

1

y

2

]

\left[ {\begin{matrix} {{x_1}}&{{x_2}}\\ {{y_1}}&{{y_2}} \end{matrix}} \right]

[x1y1x2y2]中由两个线性无关的二维向量组成,所以秩

r

(

[

x

1

x

2

y

1

y

2

]

)

=

n

=

2

r\left(\left[ {\begin{matrix} {{x_1}}&{{x_2}}\\ {{y_1}}&{{y_2}} \end{matrix}} \right]\right)=n=2

r([x1y1x2y2])=n=2,其增广矩阵

[

x

1

x

2

x

A

y

1

y

2

y

A

]

\left[ {\begin{matrix} {{x_1}}&{{x_2}}&{{x_A}}\\ {{y_1}}&{{y_2}}&{{y_A}} \end{matrix}} \right]

[x1y1x2y2xAyA]为

2

×

3

2\times 3

2×3矩阵,且根据秩的性质,该增广矩阵的秩必定不小于其子矩阵的秩,即不小于2,所以该增广矩阵的秩

r

(

[

x

1

x

2

x

A

y

1

y

2

y

A

]

)

=

2

=

r

(

[

x

1

x

2

y

1

y

2

]

)

r\left(\left[ {\begin{matrix} {{x_1}}&{{x_2}}&{{x_A}}\\ {{y_1}}&{{y_2}}&{{y_A}} \end{matrix}} \right]\right)=2=r\left(\left[ {\begin{matrix} {{x_1}}&{{x_2}}\\ {{y_1}}&{{y_2}} \end{matrix}} \right]\right)

r([x1y1x2y2xAyA])=2=r([x1y1x2y2]),所以该矩阵方程有唯一解,即满足1.4.1节中描述的向量基的唯一性。(当然,如果觉得这种判断太过复杂,那么也可以用大家最喜欢的判断方法:二元一次方程组,两个方程两个未知数,且两个方程线性无关,有唯一解)

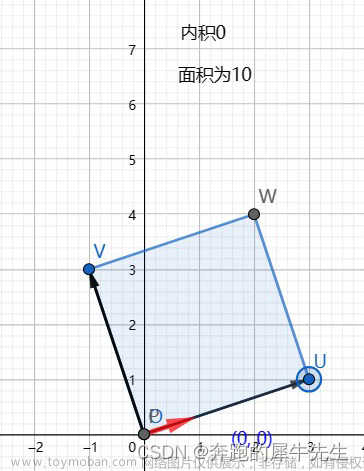

再者,假设向量

U

1

{\bf{U}}_1

U1和

U

2

{\bf{U}}_2

U2为正交的,则

U

1

U

2

=

0

{\bf{U}}_1{\bf{U}}_2=0

U1U2=0(对后面求偏导的计算意义重大),图示如下![信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础,线性代数,矩阵,信号处理](https://imgs.yssmx.com/Uploads/2024/04/858588-6.png)

图6 正交的

U

1

和

U

2

表示与之共面的向量

A

\text{图6 正交的}{\bf{U}}_1\text{和}{\bf{U}}_2\text{表示与之共面的向量\bf{A}}

图6 正交的U1和U2表示与之共面的向量A

同时由于证明上面证明了表示的唯一性,即表明只有一组

λ

1

\lambda_1

λ1和

λ

2

\lambda_2

λ2的取值使得误差绝对值取到最小值

0

0

0,也是极小值点,所以这里采用类似1.1节中的办法,对函数

ε

2

=

(

λ

1

U

1

+

λ

2

U

2

−

A

)

2

\boldsymbol{\varepsilon}^2=\left(\lambda_1{\bf{U}}_1+\lambda_2{\bf{U}}_2-{\bf{A}}\right)^2

ε2=(λ1U1+λ2U2−A)2,分别对

λ

1

\lambda_1

λ1和

λ

2

\lambda_2

λ2求偏导

{

∂

∂

λ

1

(

λ

1

U

1

+

λ

2

U

2

−

A

)

2

=

2

(

λ

1

U

1

2

−

U

1

A

)

=

0

∂

∂

λ

2

(

λ

1

U

1

+

λ

2

U

2

−

A

)

2

=

2

(

λ

2

U

2

2

−

U

2

A

)

=

0

\left\{ \begin{array}{l} \frac{\partial }{{\partial {\lambda _1}}}{\left( {{\lambda _1}{{\bf{U}}_1} + {\lambda _2}{{\bf{U}}_2} - {\bf{A}}} \right)^2} = 2\left( {{\lambda _1}{\bf{U}}_1^2 - {{\bf{U}}_1}{\bf{A}}} \right) = 0\\ \frac{\partial }{{\partial {\lambda _2}}}{\left( {{\lambda _1}{{\bf{U}}_1} + {\lambda _2}{{\bf{U}}_2} - {\bf{A}}} \right)^2} = 2\left( {{\lambda _2}{\bf{U}}_2^2 - {{\bf{U}}_2}{\bf{A}}} \right) = 0 \end{array} \right.

{∂λ1∂(λ1U1+λ2U2−A)2=2(λ1U12−U1A)=0∂λ2∂(λ1U1+λ2U2−A)2=2(λ2U22−U2A)=0

从而有

λ

1

\lambda_1

λ1和

λ

2

\lambda_2

λ2的解

λ

1

=

A

⋅

U

1

U

1

⋅

U

1

,

λ

2

=

A

⋅

U

2

U

2

⋅

U

2

\lambda_1={\frac{{{\bf{A}} \cdot {{\bf{U}}_1}}}{{{{\bf{U}}_1} \cdot {{\bf{U}}_1}}}},\lambda_2={\frac{{{\bf{A}} \cdot {{\bf{U}}_2}}}{{{{\bf{U}}_2} \cdot {{\bf{U}}_2}}}}

λ1=U1⋅U1A⋅U1,λ2=U2⋅U2A⋅U2

关于上面为什么要假设正交,还要通过求导来求解,相信有很多人有疑问,觉得直接求解前面的矩阵方程不也一样吗,弄这么麻烦不是没事找事吗?关于这个问题,在后面的内容中会马上进一步描述,到时候大家就很清楚了,这里只是对正交性的进一步的铺垫,大家先建立这个求解过程的思路就好。

1.4.3 三维向量基

结论:一个三维的空间向量

A

\bf{A}

A可以通过三个不在同一平面的向量

U

1

,

U

2

,

U

3

{\bf{U}}_1,{\bf{U}}_2,{\bf{U}}_3

U1,U2,U3唯一地完全无误差地表示(

ε

=

0

\boldsymbol{\varepsilon={\bf{0}}}

ε=0)

A

=

λ

1

U

1

+

λ

2

U

2

+

λ

3

U

3

\bf{A}=\lambda_1{\bf{U}}_1+\lambda_2{\bf{U}}_2+\lambda_3{\bf{U}}_3

A=λ1U1+λ2U2+λ3U3

则

U

1

,

U

2

,

U

3

{\bf{U}}_1,{\bf{U}}_2,{\bf{U}}_3

U1,U2,U3这一组向量线性无关(任何两个都无法完全表示出第三个),它们构成了一组3维向量基。当该组向量基中的向量互为正交向量时,对应的待定系数的解为

λ

1

=

A

⋅

U

1

U

1

⋅

U

1

,

λ

2

=

A

⋅

U

2

U

2

⋅

U

2

,

λ

3

=

A

⋅

U

3

U

3

⋅

U

3

\lambda_1={\frac{{{\bf{A}} \cdot {{\bf{U}}_1}}}{{{{\bf{U}}_1} \cdot {{\bf{U}}_1}}}},\lambda_2={\frac{{{\bf{A}} \cdot {{\bf{U}}_2}}}{{{{\bf{U}}_2} \cdot {{\bf{U}}_2}}}},\lambda_3={\frac{{{\bf{A}} \cdot {{\bf{U}}_3}}}{{{{\bf{U}}_3} \cdot {{\bf{U}}_3}}}}

λ1=U1⋅U1A⋅U1,λ2=U2⋅U2A⋅U2,λ3=U3⋅U3A⋅U3

(如果完全理解了三维向量基这一结论的盆友可以跳过本1.3.3节后续的推导,下面的推导原则与前面1.1节的推导的思路基本一致,不需要看的可以直接跳到第2节) \text{\bf(如果完全理解了三维向量基这一结论的盆友可以跳过本1.3.3节后续的推导,下面的推导原则与前面1.1节的推导的思路基本一致,不需要看的可以直接跳到第2节)} (如果完全理解了三维向量基这一结论的盆友可以跳过本1.3.3节后续的推导,下面的推导原则与前面1.1节的推导的思路基本一致,不需要看的可以直接跳到第2节)

进一步地,若对于一个不在由向量

U

1

{\bf{U}}_1

U1和

U

2

{\bf{U}}_2

U2所确定的平面上的向量

A

\bf{A}

A,并仍要使用

U

1

{\bf{U}}_1

U1和

U

2

{\bf{U}}_2

U2来表示

A

=

λ

1

U

1

+

λ

2

U

2

+

ε

\bf{A}=\lambda_1{\bf{U}}_1+\lambda_2{\bf{U}}_2+\boldsymbol{\varepsilon}

A=λ1U1+λ2U2+ε

图形化表示如下图![信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础,线性代数,矩阵,信号处理](https://imgs.yssmx.com/Uploads/2024/04/858588-7.png)

图7 不共线的

U

1

和

U

2

表示不在该平面内的向量

A

\text{图7 不共线的}{\bf{U}}_1\text{和}{\bf{U}}_2\text{表示不在该平面内的向量\bf{A}}

图7 不共线的U1和U2表示不在该平面内的向量A

不难看出不存在

λ

1

\lambda_1

λ1和

λ

2

\lambda_2

λ2使得在

ε

≠

0

\boldsymbol{\varepsilon}\ne {\bf{0}}

ε=0的情况下使上面等式成立。因此,考虑继续增加一个标准向量

U

3

{\bf{U}}_3

U3,通过3个标准向量来表示向量

A

\bf{A}

A

A

=

λ

1

U

1

+

λ

2

U

2

+

λ

3

U

3

+

ε

\bf{A}=\lambda_1{\bf{U}}_1+\lambda_2{\bf{U}}_2+\lambda_3{\bf{U}}_3+\boldsymbol{\varepsilon}

A=λ1U1+λ2U2+λ3U3+ε

当3个标准向量不在同一平面上时,![信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础,线性代数,矩阵,信号处理](https://imgs.yssmx.com/Uploads/2024/04/858588-8.png)

图8 不共面的 U 1 , U 2 和 U 3 表示空间向量 A \text{图8 不共面的}{\bf{U}}_1\text{,}{\bf{U}}_2\text{和}{\bf{U}}_3\text{表示空间向量\bf{A}} 图8 不共面的U1,U2和U3表示空间向量A

关于这里表示的唯一性与完备性,有两种理解方式:

方式1: 根据1.3节中的空间坐标与三维向量之间的对应关系的表述,为探究是否存在

λ

1

,

λ

2

,

λ

3

\lambda_1,\lambda_2,\lambda_3

λ1,λ2,λ3,使得在

ε

=

0

\boldsymbol{\varepsilon}= {\bf{0}}

ε=0,类似1.4.1节和1.4.2节中的坐标假设,令向量

A

=

[

x

A

,

y

A

,

z

A

]

T

,

U

1

=

[

x

1

,

y

1

,

z

1

]

T

,

U

2

=

[

x

2

,

y

2

,

z

2

]

T

,

U

3

=

[

x

3

,

y

3

,

z

3

]

T

{\bf{A}}=\left[x_A,y_A,z_A\right]^T,{\bf{U}}_1=\left[x_1,y_1,z_1\right]^T,{\bf{U}}_2=\left[x_2,y_2,z_2\right]^T,{\bf{U}}_3=\left[x_3,y_3,z_3\right]^T

A=[xA,yA,zA]T,U1=[x1,y1,z1]T,U2=[x2,y2,z2]T,U3=[x3,y3,z3]T,可以列写方程

[

x

A

y

A

z

A

]

=

[

x

1

x

2

x

3

y

1

y

2

y

3

z

1

z

2

z

3

]

[

λ

1

λ

2

λ

3

]

\left[ {\begin{matrix} {{x_A}}\\ {{y_A}}\\ {{z_A}} \end{matrix}} \right]= \left[ {\begin{matrix} {{x_1}}&{{x_2}}&{{x_3}}\\ {{y_1}}&{{y_2}}&{{y_3}}\\ {{z_1}}&{{z_2}}&{{z_3}} \end{matrix}} \right]\left[ {\begin{matrix} {{\lambda _1}}\\ {{\lambda _2}}\\ {{\lambda _3}} \end{matrix}} \right]

xAyAzA

=

x1y1z1x2y2z2x3y3z3

λ1λ2λ3

同样的道理,由于

U

1

,

U

2

,

U

3

{\bf{U}}_1,{\bf{U}}_2,{\bf{U}}_3

U1,U2,U3中的任意一个向量均不在另外两个向量所确定的平面内,因而根据图6所示的结果,显然无法用其中的任意两个向量表示另一个向量,即3个向量为线性无关的,从而类似前述的矩阵的秩的判定方式可以得到该矩阵方程的系数矩阵的秩与增广矩阵的秩相等,且等于方程的个数(向量的维数)

n

=

3

n=3

n=3,因而上述方程有唯一解,即同时验证了唯一性和完备性。

方式2: 从图形化的层面理解,先分析不在同一直线上的

U

1

{\bf{U}}_1

U1和

U

2

{\bf{U}}_2

U2这两个向量,可以分析得出这两个向量的任意不同数乘之和的结果可以唯一表示其所确定平面上的任意不同的向量,即这两个向量直接的数乘之和可以直接看成(或可以直接替换为)该平面中的一个向量

U

p

=

λ

1

′

U

1

+

λ

2

′

U

2

{\bf{U}}_p=\lambda_1^{'}{\bf{U}}_1+\lambda_2^{'}{\bf{U}}_2

Up=λ1′U1+λ2′U2,那么当

U

3

{\bf{U}}_3

U3不在该平面上时,

U

p

{\bf{U}}_p

Up和

U

3

{\bf{U}}_3

U3可以确定新的平面,而由于

U

p

{\bf{U}}_p

Up在

U

1

{\bf{U_1}}

U1和

U

2

{\bf{U}}_2

U2所确定的平面上的任意性,所以必然存在

U

p

{\bf{U}}_p

Up使得

U

p

{\bf{U}}_p

Up和

U

3

{\bf{U}}_3

U3确定的新平面包含向量

A

\bf{A}

A,那么再一次根据1.4.2节中的平面向量基的唯一性和完备性,此时

U

p

{\bf{U}}_p

Up和

U

3

{\bf{U}}_3

U3必然能唯一无误差地确定

A

\bf{A}

A

A

=

λ

p

U

p

+

λ

3

U

3

=

λ

1

′

λ

p

U

1

+

λ

2

′

λ

p

U

2

+

λ

3

U

3

\bf{A}=\lambda_p{\bf{U}}_p+\lambda_3{\bf{U}}_3=\lambda_1^{'}\lambda_p{\bf{U}}_1+\lambda_2^{'}\lambda_p{\bf{U}}_2+\lambda_3{\bf{U}}_3

A=λpUp+λ3U3=λ1′λpU1+λ2′λpU2+λ3U3

则

λ

1

=

λ

1

′

λ

p

,

λ

2

=

λ

2

′

λ

p

\lambda_1=\lambda_1^{'}\lambda_p,\lambda_2=\lambda_2^{'}\lambda_p

λ1=λ1′λp,λ2=λ2′λp。

再者,假设向量

U

1

{\bf{U}}_1

U1,

U

2

{\bf{U}}_2

U2和

U

3

{\bf{U}}_3

U3为正交的,则

U

1

U

2

=

U

2

U

3

=

U

1

U

3

=

0

{\bf{U}}_1{\bf{U}}_2={\bf{U}}_2{\bf{U}}_3={\bf{U}}_1{\bf{U}}_3=0

U1U2=U2U3=U1U3=0(对后面求偏导的计算意义重大),图示如下![信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础,线性代数,矩阵,信号处理](https://imgs.yssmx.com/Uploads/2024/04/858588-9.png)

图9 正交的

U

1

,

U

2

和

U

3

表示空间向量

A

\text{图9 正交的}{\bf{U}}_1\text{,}{\bf{U}}_2\text{和}{\bf{U}}_3\text{表示空间向量\bf{A}}

图9 正交的U1,U2和U3表示空间向量A

同时由于证明上面证明了表示的唯一性,即表明只有一组

λ

1

,

λ

2

,

λ

3

\lambda_1,\lambda_2,\lambda_3

λ1,λ2,λ3的取值使得误差绝对值取到最小值

0

0

0,也是极小值点,所以这里采用类似1.1节中的办法,对函数

ε

2

=

(

λ

1

U

1

+

λ

2

U

2

+

λ

3

U

3

−

A

)

2

\boldsymbol{\varepsilon}^2=\left(\lambda_1{\bf{U}}_1+\lambda_2{\bf{U}}_2+\lambda_3{\bf{U}}_3-{\bf{A}}\right)^2

ε2=(λ1U1+λ2U2+λ3U3−A)2,分别对

λ

1

\lambda_1

λ1和

λ

2

\lambda_2

λ2求偏导

{

∂

∂

λ

1

(

λ

1

U

1

+

λ

2

U

2

+

λ

3

U

3

−

A

)

2

=

2

(

λ

1

U

1

2

−

U

1

A

)

=

0

∂

∂

λ

2

(

λ

1

U

1

+

λ

2

U

2

+

λ

3

U

3

−

A

)

2

=

2

(

λ

2

U

2

2

−

U

2

A

)

=

0

∂

∂

λ

3

(

λ

1

U

1

+

λ

2

U

2

+

λ

3

U

3

−

A

)

2

=

2

(

λ

3

U

3

2

−

U

3

A

)

=

0

\left\{ \begin{array}{l} \frac{\partial }{{\partial {\lambda _1}}}{\left( {{\lambda _1}{{\bf{U}}_1} + {\lambda _2}{{\bf{U}}_2} + {\lambda _3}{{\bf{U}}_3}- {\bf{A}}} \right)^2} = 2\left( {{\lambda _1}{\bf{U}}_1^2 - {{\bf{U}}_1}{\bf{A}}} \right) = 0\\ \frac{\partial }{{\partial {\lambda _2}}}{\left( {{\lambda _1}{{\bf{U}}_1} + {\lambda _2}{{\bf{U}}_2} + {\lambda _3}{{\bf{U}}_3}- {\bf{A}}} \right)^2} = 2\left( {{\lambda _2}{\bf{U}}_2^2 - {{\bf{U}}_2}{\bf{A}}} \right) = 0\\ \frac{\partial }{{\partial {\lambda _3}}}{\left( {{\lambda _1}{{\bf{U}}_1} + {\lambda _2}{{\bf{U}}_2} + {\lambda _3}{{\bf{U}}_3}-{\bf{A}}} \right)^2} = 2\left( {{\lambda _3}{\bf{U}}_3^2 - {{\bf{U}}_3}{\bf{A}}} \right) = 0 \end{array} \right.

⎩

⎨

⎧∂λ1∂(λ1U1+λ2U2+λ3U3−A)2=2(λ1U12−U1A)=0∂λ2∂(λ1U1+λ2U2+λ3U3−A)2=2(λ2U22−U2A)=0∂λ3∂(λ1U1+λ2U2+λ3U3−A)2=2(λ3U32−U3A)=0

从而有

λ

1

\lambda_1

λ1和

λ

2

\lambda_2

λ2的解

λ

1

=

A

⋅

U

1

U

1

⋅

U

1

,

λ

2

=

A

⋅

U

2

U

2

⋅

U

2

,

λ

3

=

A

⋅

U

3

U

3

⋅

U

3

\lambda_1={\frac{{{\bf{A}} \cdot {{\bf{U}}_1}}}{{{{\bf{U}}_1} \cdot {{\bf{U}}_1}}}},\lambda_2={\frac{{{\bf{A}} \cdot {{\bf{U}}_2}}}{{{{\bf{U}}_2} \cdot {{\bf{U}}_2}}}},\lambda_3={\frac{{{\bf{A}} \cdot {{\bf{U}}_3}}}{{{{\bf{U}}_3} \cdot {{\bf{U}}_3}}}}

λ1=U1⋅U1A⋅U1,λ2=U2⋅U2A⋅U2,λ3=U3⋅U3A⋅U3

关于正交性,在后面的内容中会进一步描述,这里还是对正交性的进一步的铺垫。

1.4.4 n n n维向量初步引入

将1.3节中的坐标系与向量的对应进行拓展,可以定义一个 n n n维向量 A = [ a 1 , a 2 , ⋯ , a n ] T {\bf{A}}=\left[a_1,a_2,\cdots,a_n\right]^T A=[a1,a2,⋯,an]T。

2. 向量空间与向量基

2.1 向量空间

官方定义: 设

V

V

V为

n

n

n维向量的集合,如果集合

V

V

V非空,且集合

V

V

V对于向量的加法及数乘两种运算封闭,那么就称集合

V

V

V为向量空间。

数学表达: 若

a

∈

V

,

b

∈

V

,

λ

∈

R

{\bf{a}}\in V,{\bf{b}}\in V,\lambda\in R

a∈V,b∈V,λ∈R,则

a

+

b

∈

V

,

λ

a

∈

V

a+b\in V,\lambda{\bf{a}}\in V

a+b∈V,λa∈V。

2.2 线性无关

对于一组含有

r

r

r个

n

n

n维向量

a

1

,

a

2

,

⋯

,

a

r

{\bf{a}}_1,{\bf{a}}_2,\cdots,{\bf{a}}_r

a1,a2,⋯,ar的向量组,若找不到一组不是全零的参数

λ

1

,

λ

2

,

⋯

,

λ

r

\lambda_1,\lambda_2,\cdots,\lambda_r

λ1,λ2,⋯,λr使得

∑

j

=

1

r

λ

j

a

j

=

0

\begin{equation} \sum\limits_{j = 1}^r {{\lambda _j}{{\bf{a}}_j}} = 0 \end{equation}

j=1∑rλjaj=0

或者也可以根据1.4.4节中的

n

n

n维向量的表达方式,令

a

j

=

[

a

1

j

,

a

2

j

,

⋯

,

a

n

j

]

T

{\bf{a}}_j=\left[a_{1j},a_{2j},\cdots,a_{nj}\right]^T

aj=[a1j,a2j,⋯,anj]T,列写齐次矩阵方程的表达形式

[

a

11

a

12

⋯

a

1

r

a

21

a

22

⋯

a

2

r

⋮

⋮

⋱

⋮

a

n

1

a

n

2

⋯

a

n

r

]

[

λ

1

λ

2

⋮

λ

r

]

=

[

0

0

⋮

0

]

\begin{equation} \left[ {\begin{matrix} {{a_{11}}}&{{a_{12}}}& \cdots &{{a_{1r}}}\\ {{a_{21}}}&{{a_{22}}}& \cdots &{{a_{2r}}}\\ \vdots & \vdots & \ddots & \vdots \\ {{a_{n1}}}&{{a_{n2}}}& \cdots &{{a_{nr}}} \end{matrix}} \right]\left[ {\begin{matrix} {{\lambda _1}}\\ {{\lambda _2}}\\ \vdots \\ {{\lambda _r}} \end{matrix}} \right] = \left[ {\begin{matrix} 0\\ 0\\ \vdots \\ 0 \end{matrix}} \right] \end{equation}

a11a21⋮an1a12a22⋮an2⋯⋯⋱⋯a1ra2r⋮anr

λ1λ2⋮λr

=

00⋮0

则称这个向量组中的所有向量都是线性无关的。

还有一种理解是,若对其中的任意一个向量

a

k

{\bf{a}}_k

ak,都无法找到一组参数

λ

1

,

λ

2

,

⋯

,

λ

k

−

1

,

λ

k

+

1

,

⋯

,

λ

r

\lambda_1,\lambda_2,\cdots,\lambda_{k-1},\lambda_{k+1},\cdots,\lambda_r

λ1,λ2,⋯,λk−1,λk+1,⋯,λr使得其它

r

−

1

r-1

r−1个向量能够线性表示该向量,即下式

a

k

=

∑

j

=

1

,

j

≠

k

r

λ

j

a

j

{{\bf{a}}_k} = \sum\limits_{j = 1,j \ne k}^r {{\lambda _j}{{\bf{a}}_j}}

ak=j=1,j=k∑rλjaj

对 ∀ k ∈ [ 1 , r ] \forall k \in \left[ {1,r} \right] ∀k∈[1,r]都不成立,则也称这一个向量组中的向量线性无关。

2.3 向量基

官方定义: 设 V V V为向量空间,若有 r r r个向量 U 1 , U 2 , ⋯ , U r {\bf{U}}_1,{\bf{U}}_2,\cdots,{\bf{U}}_r U1,U2,⋯,Ur满足:

- U 1 , U 2 , ⋯ , U r {\bf{U}}_1,{\bf{U}}_2,\cdots,{\bf{U}}_r U1,U2,⋯,Ur线性无关;

- V V V中任一向量都可由 U 1 , U 2 , ⋯ , U r {\bf{U}}_1,{\bf{U}}_2,\cdots,{\bf{U}}_r U1,U2,⋯,Ur线性表示。

那么就称 V V V是 r r r维向量空间,向量组 U 1 , U 2 , ⋯ , U r {\bf{U}}_1,{\bf{U}}_2,\cdots,{\bf{U}}_r U1,U2,⋯,Ur为向量空间 V V V的一个基。

2.4 矢量分解的正交性要求

前面已经多次提到正交性的概念,从1,2,3维向量举例说明了正交性情况下时,求各个标准向量对应的待定参数的方法。可能有人认为直接求方程组就可以了,为什么非要按照求导的方式来做呢。事实上,如果对于一般的,不满足正交关系的一组向量基,如果使用这样的一组向量基表示一个该向量空间下的任意一个向量,确实是只能通过求方程组的方法来求得参数。但是大家可以想一想,上面给出的求解方程组的方法的例子是基于2维和3维向量空间的,假如维数

n

=

10

,

100

,

1000

,

10000

n=10,100,1000,10000

n=10,100,1000,10000呢?首先

n

n

n维向量空间的向量基中必须包含有

n

n

n个线性无关的至少

n

n

n维的向量(线性方程组求解的相关性质,这里不多做阐述,当然相信大家也能够理解),需要

n

n

n个,那么对矩阵方程的求解

[

u

11

u

12

⋯

u

1

n

u

21

u

22

⋯

u

2

n

⋮

⋮

⋱

⋮

u

n

1

u

n

2

⋯

u

n

n

]

[

λ

1

λ

2

⋮

λ

n

]

=

[

a

1

a

2

⋮

a

n

]

→

[

λ

1

λ

2

⋮

λ

n

]

=

[

u

11

u

12

⋯

u

1

n

u

21

u

22

⋯

u

2

n

⋮

⋮

⋱

⋮

u

n

1

u

n

2

⋯

u

n

n

]

−

1

[

a

1

a

2

⋮

a

n

]

\begin{equation} \left[ {\begin{matrix} {{u_{11}}}&{{u_{12}}}& \cdots &{{u_{1n}}}\\ {{u_{21}}}&{{u_{22}}}& \cdots &{{u_{2n}}}\\ \vdots & \vdots & \ddots & \vdots \\ {{u_{n1}}}&{{u_{n2}}}& \cdots &{{u_{nn}}} \end{matrix}} \right]\left[ {\begin{matrix} {{\lambda _1}}\\ {{\lambda _2}}\\ \vdots \\ {{\lambda _n}} \end{matrix}} \right] = \left[ {\begin{matrix} {{a_1}}\\ {{a_2}}\\ \vdots \\ {{a_n}} \end{matrix}} \right] \to \left[ {\begin{matrix} {{\lambda _1}}\\ {{\lambda _2}}\\ \vdots \\ {{\lambda _n}} \end{matrix}} \right] = {\left[ {\begin{matrix} {{u_{11}}}&{{u_{12}}}& \cdots &{{u_{1n}}}\\ {{u_{21}}}&{{u_{22}}}& \cdots &{{u_{2n}}}\\ \vdots & \vdots & \ddots & \vdots \\ {{u_{n1}}}&{{u_{n2}}}& \cdots &{{u_{nn}}} \end{matrix}} \right]^{ - 1}}\left[ {\begin{matrix} {{a_1}}\\ {{a_2}}\\ \vdots \\ {{a_n}} \end{matrix}} \right] \end{equation}

u11u21⋮un1u12u22⋮un2⋯⋯⋱⋯u1nu2n⋮unn

λ1λ2⋮λn

=

a1a2⋮an

→

λ1λ2⋮λn

=

u11u21⋮un1u12u22⋮un2⋯⋯⋱⋯u1nu2n⋮unn

−1

a1a2⋮an

但是大家想一想,如果在

n

n

n非常大的时候,上式中的逆矩阵将如何求解?那将是一个非常困难的事情。而如果向量基中的所有向量都是正交的,即

U

i

U

j

=

0

,

i

≠

j

{\bf{U}}_i{\bf{U}}_j=0,i\ne j

UiUj=0,i=j且

U

i

U

i

≠

0

,

i

=

1

,

2

,

⋯

,

n

{\bf{U}}_i{\bf{U}}_i\ne 0,i=1,2,\cdots,n

UiUi=0,i=1,2,⋯,n,那么参照前面的求解思路,对待定参数的求解可以写为

{

∂

∂

λ

1

(

∑

j

=

1

n

λ

j

U

j

−

A

)

2

=

2

(

λ

1

U

1

2

−

U

1

A

)

=

0

∂

∂

λ

2

(

∑

j

=

1

n

λ

j

U

j

−

A

)

2

=

2

(

λ

2

U

2

2

−

U

2

A

)

=

0

⋮

∂

∂

λ

n

(

∑

j

=

1

n

λ

j

U

j

−

A

)

2

=

2

(

λ

n

U

n

2

−

U

n

A

)

=

0

→

λ

j

=

A

⋅

U

j

U

j

⋅

U

j

,

j

=

1

,

2

,

⋯

,

n

\begin{equation} \left\{ {\begin{matrix} {\frac{\partial }{{\partial {\lambda _1}}}{{\left( {\sum\limits_{j = 1}^n {{\lambda _j}{{\bf{U}}_j}} - {\bf{A}}} \right)}^2} = 2\left( {{\lambda _1}{\bf{U}}_1^2 - {{\bf{U}}_1}{\bf{A}}} \right) = 0}\\ {\frac{\partial }{{\partial {\lambda _2}}}{{\left( {\sum\limits_{j = 1}^n {{\lambda _j}{{\bf{U}}_j}} - {\bf{A}}} \right)}^2} = 2\left( {{\lambda _2}{\bf{U}}_2^2 - {{\bf{U}}_2}{\bf{A}}} \right) = 0}\\ \vdots \\ {\frac{\partial }{{\partial {\lambda _n}}}{{\left( {\sum\limits_{j = 1}^n {{\lambda _j}{{\bf{U}}_j}} - {\bf{A}}} \right)}^2} = 2\left( {{\lambda _n}{\bf{U}}_n^2 - {{\bf{U}}_n}{\bf{A}}} \right) = 0} \end{matrix}} \right.\to {\lambda _j} = \frac{{{\bf{A}} \cdot {{\bf{U}}_j}}}{{{{\bf{U}}_j} \cdot {{\bf{U}}_j}}},j = 1,2, \cdots ,n \end{equation}

⎩

⎨

⎧∂λ1∂(j=1∑nλjUj−A)2=2(λ1U12−U1A)=0∂λ2∂(j=1∑nλjUj−A)2=2(λ2U22−U2A)=0⋮∂λn∂(j=1∑nλjUj−A)2=2(λnUn2−UnA)=0→λj=Uj⋅UjA⋅Uj,j=1,2,⋯,n

很多时候在问题中遇到的向量(在信号处理中对应信号的函数表达式)问题都是高维,甚至是无限维度的,所以如果在选择的向量基不满足正交性,那么求解问题将变得非常复杂,而如果将向量基限定为正交基,那么参数的求解的结果将变得非常容易。因此,通常在分析问题时,都选择正交向量基作为分解标准。

2.5 单位正交基

为进一步简化计算,可以将使用单位长度的向量基对矢量进行分解分析,这样最终求得的每一个参数的值就直接表示了该矢量在该标准向量的方向上的分量大小。因此,通常使用单位正交基可以最大程度上简化计算,并且使求解的结果的数学和物理意义更加显著。

2.6 向量基的要求

综上所述,通常在使用向量基时,向量基需要满足的性质条件包括:

- 完备性(包含唯一性);

- 正交性( U i U j = 0 , i ≠ j {\bf{U}}_i{\bf{U}}_j=0,i\ne j UiUj=0,i=j且 U i U i ≠ 0 , i = 1 , 2 , ⋯ , n {\bf{U}}_i{\bf{U}}_i\ne 0,i=1,2,\cdots,n UiUi=0,i=1,2,⋯,n);

- 单位化( U i U i = 1 , i = 1 , 2 , ⋯ , n {\bf{U}}_i{\bf{U}}_i = 1,i=1,2,\cdots,n UiUi=1,i=1,2,⋯,n)。

例如:单位矩阵 E n × n {\bf{E}}_{n\times n} En×n中的所有列向量所构成的向量组就是一组 n n n维向量空间的单位正交向量基。文章来源:https://www.toymoban.com/news/detail-858588.html

3.结语

以上就是本文从向量层面阐述的向量分解与向量基的基本问题,这是作为后续将向量引申为函数,以进一步解释信号分解的基底。文章来源地址https://www.toymoban.com/news/detail-858588.html

4. 参考资料

- 管致中, 夏恭恪, 孟桥. 信号与线性系统.上册[M]. 第6版. 北京: 高等教育出版社, 2015: 83-85.

- 同济大学. 工程数学与线性代数[M]. 第六版. 北京: 高等教育出版社, 2014: 104-119.

- 东南大学的《信号与线性系统》网课(孟桥老师yyds,b站和慕课上都有,本文对应的是该套视频的第三章的第一个视频《矢量的正交分解》)

到了这里,关于信号与系统的一些基本问题之信号分解完备正交基[1]—线性代数向量空间与向量基的基础的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!