先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

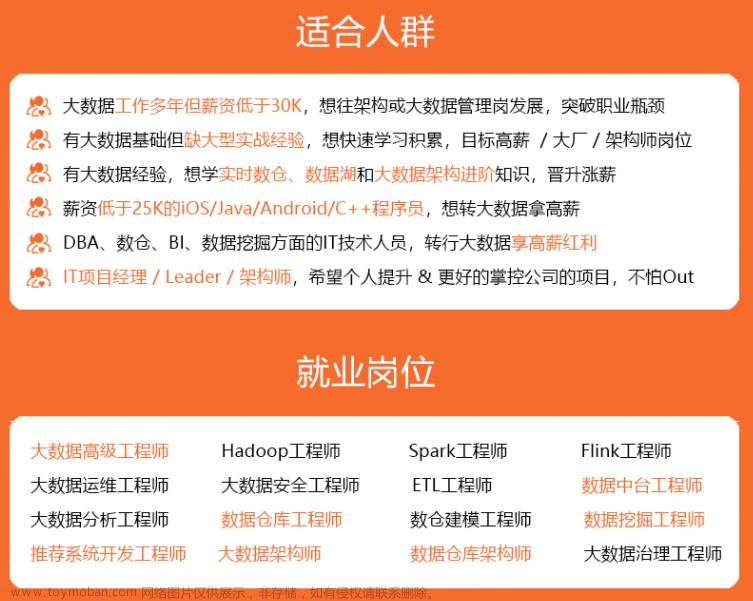

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

- ES索引结构

- MySQL表结构

mysql原始数据

恭喜你🎉🎉🎉,到这你已经成功2/4啦,接下来我们要去配置Logstash啦,加油⛽️

三. 配置Logstash

- 进入到 /logstash-7.10.2/bin目录下,创建 testlogstash.conf 文件,这是具体的配置

input {

stdin {}

jdbc {

#===================这是你需要修改的第1个地方===============#

#数据库连接地址

jdbc\_connection\_string => "jdbc:mysql://localhost:3306/user\_center?characterEncoding=UTF-8&autoReconnect=true"

jdbc\_user => "root"

jdbc\_password => "root"

# MySQL依赖包路径;

jdbc\_driver\_library => "/Users/chencunyou/Desktop/java/mysql/mysql-connector-java-8.0.27.jar"

#查询数据库语句(查询出的字段名要和es索引的字段名相同)

statement => "SELECT id,nick_name AS nickName,sex,birth_date AS birthDate,create_time AS createTime,update_time AS updateTime

FROM sys_user"

# 需要记录的字段,用于增量同步,需是数据库字段

tracking\_column => "updateTime"

# record_last_run上次数据存放位置;

last\_run\_metadata\_path => "/Users/chencunyou/Desktop/java/logstash-8.9.2/data/last\_time.txt"

#====================第1个地方修改结束=====================#

type => "jdbc"

# the name of the driver class for mysql

jdbc\_driver\_class => "com.mysql.cj.jdbc.Driver"

# 数据库重连尝试次数

connection\_retry\_attempts => "3"

# 判断数据库连接是否可用,默认false不开启

jdbc\_validate\_connection => "true"

# 数据库连接可用校验超时时间,默认3600S

jdbc\_validation\_timeout => "3600"

# 开启分页查询(默认false不开启);

jdbc\_paging\_enabled => "true"

# 单次分页查询条数(默认100000,若字段较多且更新频率较高,建议调低此值);

jdbc\_page\_size => "500"

# statement为查询数据sql,如果sql较复杂,建议配通过statement_filepath配置sql文件的存放路径;

# sql_last_value为内置的变量,存放上次查询结果中最后一条数据tracking_column的值,此处即为ModifyTime;

# statement\_filepath => "mysql/jdbc.sql"

# 是否将字段名转换为小写,默认true(如果有数据序列化、反序列化需求,建议改为false);

lowercase\_column\_names => false

# Value can be any of: fatal,error,warn,info,debug,默认info;

sql\_log\_level => warn

#

# 是否记录上次执行结果,true表示会将上次执行结果的tracking_column字段的值保存到last_run_metadata_path指定的文件中;

record\_last\_run => true

# 需要记录查询结果某字段的值时,此字段为true,否则默认tracking_column为timestamp的值;

use\_column\_value => true

# Value can be any of: numeric,timestamp,Default value is "numeric"

tracking\_column\_type => timestamp

# 是否清除last_run_metadata_path的记录,需要增量同步时此字段必须为false;

clean\_run => false

#

# 同步频率(分 时 天 月 年),默认每分钟同步一次;

schedule => "\* \* \* \* \*"

}

}

output {

elasticsearch {

#===================这是你需要修改的第2个地方===============#

# host => "localhost"

# port => "9200"

# 配置ES集群地址

hosts => ["127.0.0.1:9200"]

user => "admin"

password => "admin"

# 启用SSL/TLS加密(前提是开启了HTTPS访问)

ssl => true

# 禁用证书验证(前提是开启了HTTPS访问)

ssl\_certificate\_verification => false

# 证书地址(如果启用SSL/TLS加密的话,即使禁用证书验证,也需要配置否则会报错)

#cacert => "/Users/chencunyou/Desktop/java/logstash-7.10.2/CloudSearchService.cer"

# 你的索引名字,必须小写

index => "sys\_user\_dev"

# 数据唯一索引(建议使用数据库表唯一索引id)

document\_id => "%{id}"

#====================第2个地方修改结束=====================#

}

stdout {

codec => json_lines

}

}

- SSL证书下载

如果你是买的云服务器厂商的ES服务,去实例基本信息下载即可。我们公司用的华为云,我以华为云为例,进到"云搜索服务CSS",找到ES实例,然后下载证书

恭喜你🎉🎉🎉,到这你已经成功3/4啦,接下来进入到最重要,同时99%会报错的最后一步,加油⛽️

四. 同步数据

- 进入到 bin 目录

- 执行脚本同步数据

./logstash -f testlogstash.conf

- 执行结果(⚠️恭喜你,同步失败,当然幸运的你也可能不会碰到此问题)

Could not index event to Elasticsearch. {:status=>400, :action=>["index", {:\_id=>"369539918421758535", :\_index=>"sys\_user\_dev", :routing=>nil, :\_type=>"\_doc"}, #<LogStash::Event:0x41528007>], :response=>{"index"=>{"\_index"=>"sys\_user\_dev", "\_type"=>"\_doc", "\_id"=>"369539918421758535", "status"=>400, "error"=>{"type"=>"mapper\_parsing\_exception", "reason"=>"failed to parse field [sex] of type [integer] in document with id '369539918421758535'. Preview of field's value: 'false'", "caused\_by"=>{"type"=>"json\_parse\_exception", "reason"=>"Current token (VALUE\_FALSE) not numeric, can not use numeric value accessors\n at [Source: (byte[])\"{\"type\":\"jdbc\",\"createTime\":\"2023-09-15 20:22:47\",\"id\":369539918421758535,\"nickName\":\"易烊千玺\",\"@timestamp\":\"2023-09-15T14:23:01.583Z\",\"updateTime\":\"2023-09-15 20:23:03\",\"@version\":\"1\",\"sex\":false,\"birthDate\":\"2000-09-15\"}\"; line: 1, column: 202]"}}}}}

⚠️原因:数据库表中的sex字段,字段类型为tinyint,Logstash会转成boolean,但是ES中设置的也是int类型,所以你懂的

解决方案: 修改 testlogstash.conf 文件中的mysql连接地址,指定 tinyInt1isBit=false

jdbc\_connection\_string => "jdbc:mysql://localhost:3306/user\_center?characterEncoding=UTF-8&autoReconnect=true&tinyInt1isBit=false"

- 再次执行命令(发现还是报错🤬,当然幸运的你也可能不会碰到此问题)

Could not index event to Elasticsearch. {:status=>400, :action=>["index", {:\_id=>"369539918421758535", :\_index=>"sys\_user\_dev", :routing=>nil, :\_type=>"\_doc"}, #<LogStash::Event:0x4f58d64c>], :response=>{"index"=>{"\_index"=>"sys\_user\_dev", "\_type"=>"\_doc", "\_id"=>"369539918421758535", "status"=>400, "error"=>{"type"=>"mapper\_parsing\_exception", "reason"=>"failed to parse field [birthDate] of type [date] in document with id '369539918421758535'. Preview of field's value: '2000-09-14T16:00:00.000Z'", "caused\_by"=>{"type"=>"illegal\_argument\_exception", "reason"=>"failed to parse date field [2000-09-14T16:00:00.000Z] with format [yyyy-MM-dd HH:mm:ss||yyyy-MM-dd||epoch\_millis]", "caused\_by"=>{"type"=>"date\_time\_parse\_exception", "reason"=>"Failed to parse with all enclosed parsers"}}}}}}

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!文章来源地址https://www.toymoban.com/news/detail-860504.html

,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-QLCFUi1e-1713173968809)]文章来源:https://www.toymoban.com/news/detail-860504.html

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

到了这里,关于使用Logstash同步mysql数据到Elasticsearch(亲自踩坑)_将mysql中的数据导入es搜索引擎利用logstash(1)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!